如今,AI 幻觉(AI Hallucinations)已成为 AI 行业普遍存在的问题。无论是国内的文心一言、Kimi、混元,还是海外的 ChatGPT、Gemini,都时常出现答非所问、前后矛盾,甚至胡编乱造的情况。为了解决这一问题,作为业界领头羊的 OpenAI 推出了新的武器–CriticGPT。

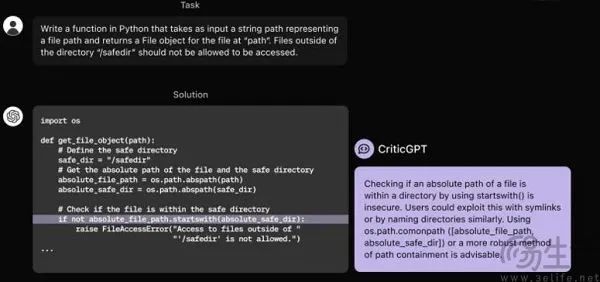

OpenAI 近期宣布,基于 GPT-4 推出了新的模型 CriticGPT,主要用于捕捉 ChatGPT 代码输出中的错误。据 OpenAI 透露,在基于人类反馈的强化学习(RLHF)领域里,借助 CriticGPT 的帮助,人类训练师的审查效果比没有获得帮助的人员提升了 60%。

OpenAI 表示,他们正在着手将类似 CriticGPT 的模型集成到旗下的 RLHF 标注流水线中,为训练师提供明确的 AI 协助。虽然 OpenAI 也承认 CriticGPT 的建议并非完全正确,但它的存在无疑可以大幅提升人类训练师的工作效率。

众所周知,OpenAI 旗下的 ChatGPT 比以往的 AI 产品更智能,其中一个关键原因在于 RLHF。RLHF 能够利用人类反馈信号直接优化语言模型,数据标注人员通过给大模型输出的结果打分,判断生成文本是否符合人类偏好。因此,RLHF 训练中负责挑错的 CriticGPT,实际上是让 OpenAI 通过人工智能来修正人工智能,如同“左脚踩右脚上天”一般。

实际上,CriticGPT 可以被视为 OpenAI 去年推出的 AI 文本检测器(AI Text Classifier)的升级版。检测互联网内容是否由 AI 生成已成为当前的热门项目,当时 OpenAI 推出的 AI 文本检测器效果并不理想。根据 OpenAI 公布的数据,该检测器识别 AI 生成文本的准确率仅为 26%,而将人类所写内容误识别为 AI 生成的错误率高达 9%。

虽然 AI 文本检测器也采用了监督学习方法,但其最大的问题在于数据集有限。要让一款 AI 检测工具的性能在线,就需要接近训练 ChatGPT 所需的数据集。如今,基于 GPT-4 庞大的数据集,CriticGPT 诞生了。

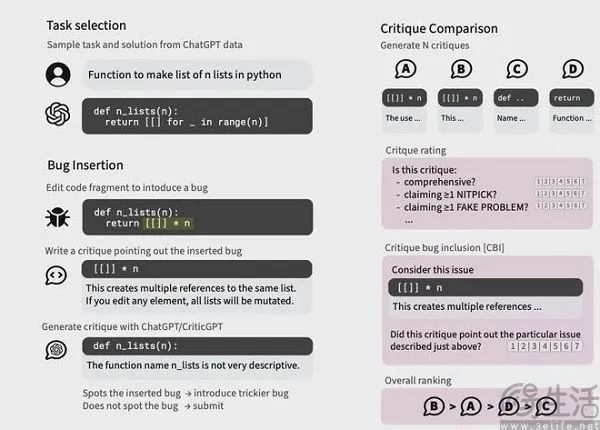

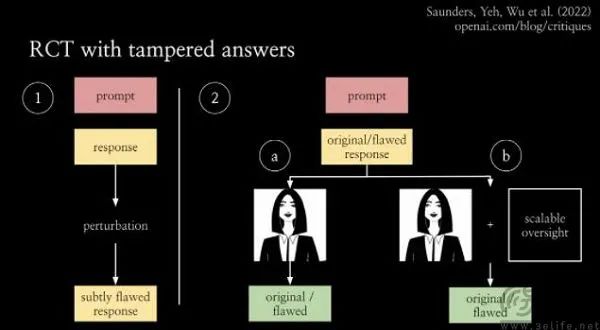

CriticGPT 与常规 GPT 一样,也使用了 RLHF,但其训练数据中包含大量有意为之的错误输入,OpenAI 将其称为通过篡改答案实现的随机对照实验。

OpenAI 的做法是让人类标注员在 ChatGPT 生成的回答中故意植入错误,然后指出问题,最后将所有数据交给 CriticGPT。但他们也承认 CriticGPT 会出现幻觉,如果仅用 AI 检测 AI,考虑到幻觉的存在,两个会产生幻觉的 AI 大模型碰撞在一起只会诞生更大的错误。为此,OpenAI 还开发了名为强制采样束搜索(FSBS)的技术,该技术会强制 CriticGPT 生成多个不同的评论片段,并用奖励模型(Reward model)对这些片段进行评分,最后根据评分和一个长度修正因子选择最佳的反馈组合。

通过这种方式,CriticGPT 可以在输出的全面性和准确性之间找到最佳解决方案。以当下最热门的代码生成为例,OpenAI 给出的成果令人欣喜。在发现人为有意插入的 BUG 上,人类审核员平均只能找到 25%,而 CriticGPT 的识别率则达到了 75% 以上;在评估自然出现的 BUG 时,有 63% 的情况下,人类训练师更倾向于选择 CriticGPT 的结果,而非人类程序员的结果。

即使在评估非代码任务时,CriticGPT 也成功识别出数百个在 ChatGPT 训练数据中被人类标注员认为是“完美”但实际错误的结果。至于 CriticGPT 为何能实现如此表现,用 OpenAI 开发者的话来说,对于很多任务而言,评价任务其实比把任务做好要容易得多。相比于 ChatGPT,CriticGPT 没有创造力,它只能根据已有的输出进行评价。

CriticGPT 的成功不仅仅在于它是一个可用的 AI 检测工具,更重要的是为后续大模型的训练提供了帮助。

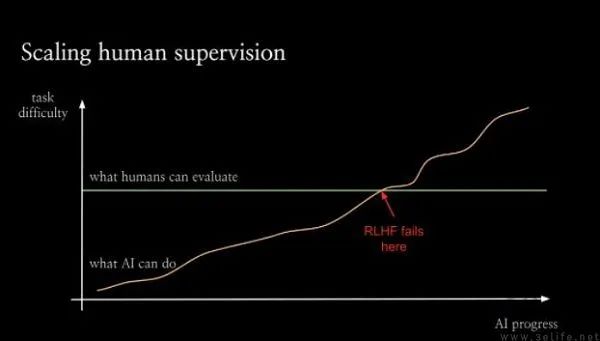

我们知道,RLHF 是 ChatGPT 等大型语言模型以及多模态大型模型的理论基础,但它并非万能。RLHF 的上限就是人类智能的上限。没有 CriticGPT 的成功,大模型的边界就是人类认知的边界,从某个临界点开始,人类将无法再可靠地评估人工智能系统,这也是为什么 OpenAI 去年一直避谈 GPT-5。

CriticGPT 的出现表明了 OpenAI 提出的可扩展监督(Scalable Oversight)并非空想。可扩展监督是指即使模型的能力超越人类水平,它仍然能够与人类的期望保持一致,持续地进行改进和学习。也许只有用大模型来监督大模型,才能出现超越人类智能的人工智能。