Rain科技10月26日消息,近日,美国马里兰州巴尔的摩县发生了一起引人关注的事件:当地一套人工智能(AI)枪支侦测系统,竟将一名16岁学生的玉米片包装袋误判为枪械,导致了武装警察的紧急出动。

事件发生在10月20日,肯伍德高中的学生艾伦(Taki Allen)在结束足球训练后,与朋友们在校外停留。然而,平静的午后瞬间被打破,多辆警车呼啸而至,警察荷枪实弹地将他们包围。

艾伦回忆当时的情景,依然心有余悸:“大约有8辆警车朝我们驶来。警察们持枪走向我,大声命令‘趴到地上’。我当时完全懵了,不明白发生了什么。”他描述了当时感受到的极度恐惧:“他们让我跪下,双手反绑在身后并戴上手铐。随后他们对我进行了搜查,但一无所获。”

在强大的武力威慑下,艾伦被制服。事后,警方向他展示了触发警报的AI截图。画面中,他口袋里那个被揉皱的多力多滋玉米片包装袋,竟然被AI系统误识别成了一把微型枪械。

艾伦至今仍对那一刻心有余悸:“我当时脑子里想的只有,‘我会死吗?他们会杀了我吗?’他们给我看了那张照片,告诉我那看起来像一把枪。” 这种体验无疑给一个青少年带来了巨大的精神创伤。

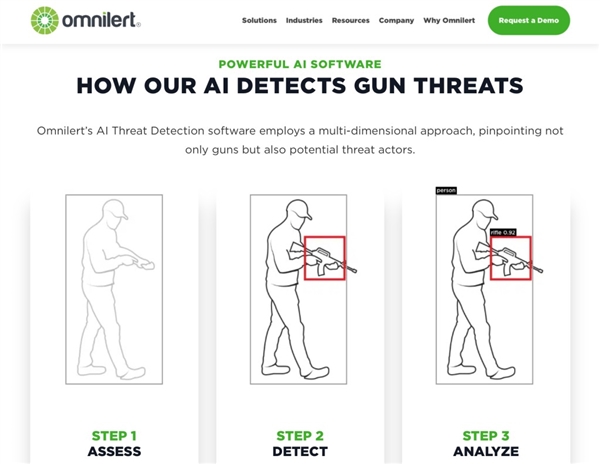

引发此次误报的AI系统由Omnilert公司提供。该技术于前一年被巴尔的摩县公立学校系统引入,旨在通过实时扫描监控录像,一旦侦测到疑似武器的物体,便立即向执法部门发出警报,以期迅速提升校园安全。然而,在实际应用中,这套系统的辨识能力显然存在严重漏洞。

根据Omnilert公司的说法,当时艾伦手中拿着玉米片,其露在外的两只手和一个手指的握持姿势,可能在AI的算法判断中,“形似”握持一把枪。尽管Omnilert承认这是一次误报,但该公司辩称,系统是“按预期运作”的,其主要目的是“通过快速的人工验证来优先保障安全”。然而,这种“预期运作”的表现,无疑引发了人们对AI在敏感领域应用的可靠性和潜在风险的担忧。

客观分析:

这起事件并非孤例,它凸显了当前AI技术在复杂、动态环境中识别和判断能力的局限性。AI系统,尤其是基于图像识别的技术,很大程度上依赖于其训练数据和算法的设计。当遇到非典型、但与训练数据中“异常”模式相似的场景时,就容易产生误判。

在这起事件中,AI系统可能将玉米片包装袋的形状、阴影以及学生的手部姿势,错误地关联到了“枪支”的特征模式。而“8辆警车”、“荷枪实弹”的介入,也反映了AI触发警报后,系统与人工干预之间“联动”流程的潜在问题——即AI的警报被高度信任,并且在尚需人工核实的情况下,立即触发了高强度的警务响应。这种“宁可错杀,不可放过”的模式,虽然在理论上旨在提升安全性,但在实际应用中,却可能因为技术的不足而造成严重的社会成本和个人伤害。

AI在安防领域的应用,尤其是在学校等需要保护青少年安全的场所,理应更加谨慎。提高AI系统的准确性,减少误报,建立更完善、更人性化的风险评估和人工复核机制至关重要。在这一点上,Omnilert公司所说的“但辩称系统是‘按预期运作’”,或许是一种技术上的辩护,但在解决社会问题上,还需要更具前瞻性和责任感的考量。如何平衡技术进步与人身安全,如何避免技术“自动化”带来的潜在负面影响,是所有AI开发者和使用者需要共同思考的课题。