在当下大模型浪潮此起彼伏之际,微软方面近日悄然放出了其在开源领域的最新力作——Phi-4-reasoning-vision-15B。此举无疑再次为广阔的AI生态注入了新的活力。相较于许多同类型开源模型,Phi-4-reasoning-vision-15B所展现出的核心技术突破,集中体现在其“自主判断何时启动深度思考”的能力上。这意味着,模型能够智能地评估任务的复杂程度,从而自主决策是需要即刻给予响应,还是应当启动一系列详尽的逻辑推理过程。这种智能化的决策机制,在当前开源轻量级模型中实属少见,为用户体验和性能优化带来了新的可能性。

作为Phi-4系列的新晋成员,这款模型拥有150亿参数,并针对诸如图像描述、用户界面元素精确定位以及复杂数学推理等高难度场景进行了深度优化。微软通过在其架构中引入一套“思考模式”控制机制,巧妙地解决了传统模型需要在用户手动干预下才能切换不同处理模式的痛点。简单任务能够得到迅捷的回应,而遇上复杂问题时,模型则会自动延伸其思考链条,在处理效率与输出质量之间找到了一个巧妙的平衡点。

在训练策略上,Phi-4-reasoning-vision-15B剑走偏锋,采取了“精量训练而非海量堆砌”的路径。值得注意的是,该模型仅使用了大约2000亿高质量的Token进行训练,这一数字与行业内同类模型通常消耗的数万亿Token相比,显得尤为精炼。尽管微软引入了GPT-4o的辅助训练以确保逻辑的严谨性,但开发团队也坦承,其在真实多变的应用场景中的实际表现,仍有待进一步的全面验证。这种对数据质量的极致追求,预示着模型训练效率和成本控制的新方向。

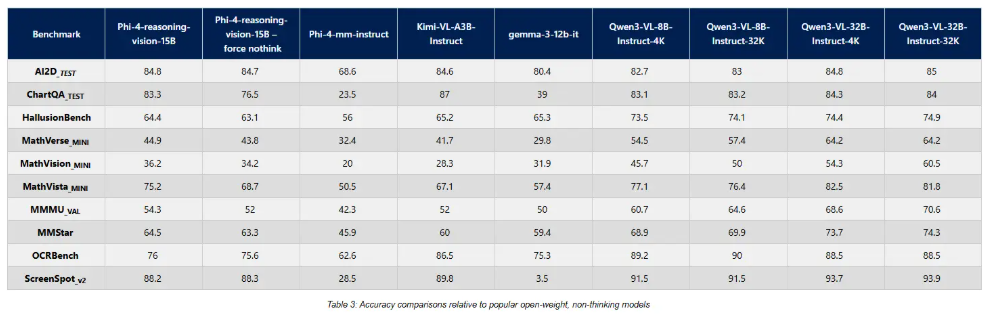

目前,微软已通过Hugging Face和Microsoft Foundry等平台,正式对外开放了模型的权重及相关配套资源。行业观察家普遍认为,尽管当前开源社群的目光更多聚焦于Qwen3.5等明星模型,但Phi-4-reasoning-vision-15B凭借其多模态集成能力和独特的“自适应思考”机制,对于那些高度重视本地化部署和追求低成本推理的开发者而言,无疑是一个不容忽视的选择。它的出现,有望进一步拓展轻量级大模型的应用边界,尤其是在边缘计算和移动设备等对资源受限的领域。

核心亮点解析

-

🧠 自适应思考机制:模型据称能够自主判断何时启动深度推理,无需用户手动激活“思考模式”,从而在效率与深度之间取得动态平衡。

-

🖼️ 增强的多模态能力:在15B参数规模下,该模型在图像理解、界面元素精确定位及数学逻辑推演等任务上表现出显著优势。

-

📉 高效的训练范式:仅用2000亿高质量Token便完成了训练,这充分展现了微软在数据甄选和模型开发方面的深厚技术功力。