在日新月异的大模型领域,我们正见证着一家欧洲新兴力量以前所未有的速度崛起。这股力量,正是由其一系列高效且强大的模型所引领。

当地时间3月16日,这家备受瞩目的机构正式推出了其最新的旗舰级模型——Mistral Small4。这款模型被定位为该实验室首款真正意义上的“全能型”大模型,它将业界领先的逻辑推理能力、精密的视觉信息理解以及强大的代码生成与处理能力,首次巧妙地融为一体。这意味着,对于广大开发者而言,在面对不同垂直领域的模型时,那种“鱼与熊掌不可兼得”的困境将有望成为历史。全新的 Small4 模型,真正做到了“我全都要”。

Mistral Small4 采用了先进的 MoE(Mixture of Experts,混合专家)架构,这一设计堪称其高效能的关键:

-

核心参数部署: 模型总参数量达到 119B,但每次推理仅激活 6B 参数,如此精妙的设计极大地优化了运算效率,在保证高性能输出的同时,显著降低了资源消耗。

-

超长上下文理解: 拥有长达 256k 的超长上下文窗口,这使得它能够轻松处理整本技术文档或庞大的代码库,有效提升了信息整合与分析的深度。

-

灵活多样的工作模式: 该模型能够根据需求,在快速响应模式与深度推理模式之间灵活切换,并且正式以 Apache 2.0 协议开源,其开放姿态可见一斑。

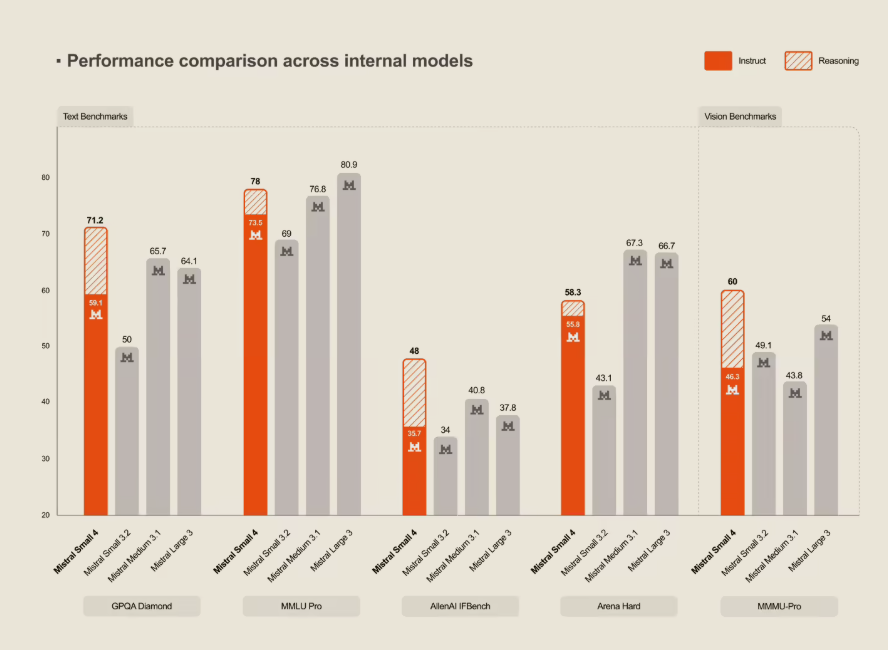

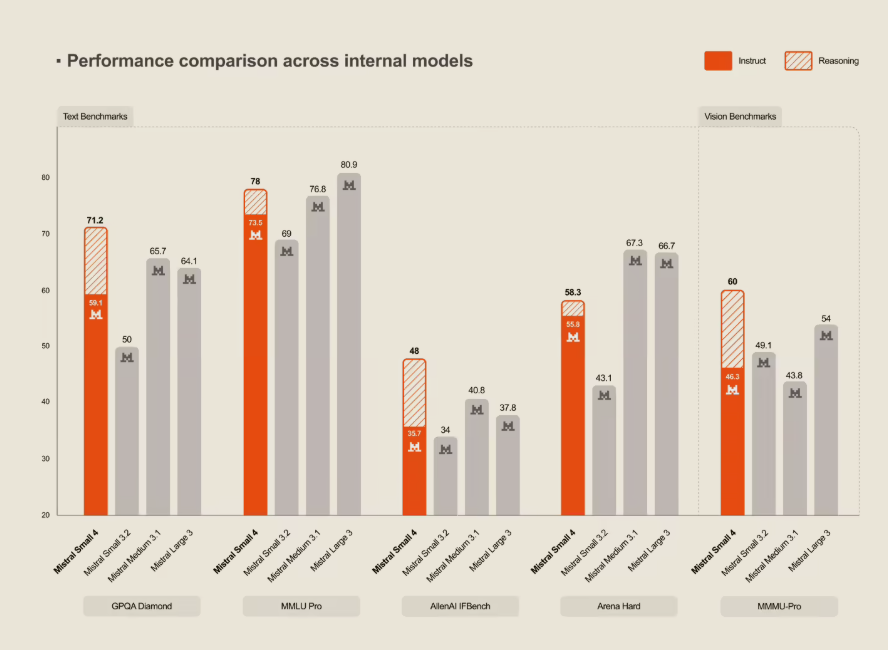

在性能表现上,Mistral Small4 较其前代产品而言,实现了质的飞跃。官方数据显示,在侧重延迟优化的模式下,其端到端生成速度提升了 40%;而在吞吐量优化模式下,每秒处理的请求数量更是达到了 Small3 的三倍。在与外部主流大模型进行横向对比的基准测试中,其在三项核心测试环节的得分均与 OpenAI 的 GPT-OSS120B 不相上下,展现出强大的竞争力。

在部署与硬件配置建议上:

为了让用户能够充分发挥 Mistral Small4 的全部潜力,Mistral AI 提供了清晰的硬件配置指引。其最低配置要求为 4 块 HGX H100 或 1 块 DGX B200;而为了获得最佳的用户体验,官方推荐使用 4 块 HGX H200 或 2 块 DGX B200 的组合。

随着 Mistral Small4 的问世,Mistral AI 再次巩固了其在开放且充满活力的全球大模型生态系统中的地位。这一举措不仅是对模型技术的一次重要突破,更是对开发者社区的一次有力赋能,预示着更多创新应用和技术集成将因此成为可能。

免责声明:本网站内容主要来自原创、合作伙伴供稿和第三方自媒体作者投稿,凡在本网站出现的信息,均仅供参考。本网站将尽力确保所提供信息的准确性及可靠性,但不保证有关资料的准确性及可靠性,读者在使用前请进一步核实,并对任何自主决定的行为负责。本网站对有关资料所引致的错误、不确或遗漏,概不负任何法律责任。任何单位或个人认为本网站中的网页或链接内容可能涉嫌侵犯其知识产权或存在不实内容时,可联系本站进行审核删除。