生成式视频技术正加速从“娱乐尝鲜”向“生产力工具”转型,企业级应用场景成为各大科技巨头争夺的新高地。在这一演进过程中,工作流的完整性与可控性,已成为衡量工具成熟度的关键指标。

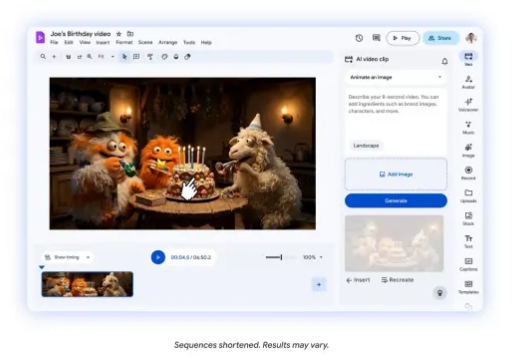

谷歌于 4 月 2 日宣布对企业级视频创作应用 Vids 进行重大升级,现已集成 Veo 3.1 视频生成模型及自然语言交互技术,标志着从静态生成向动态“指令控制”的转变。此次更新的核心在于增强 AI 虚拟角色的交互能力。用户现在可以通过简单的文本提示,引导角色在场景中与产品、道具或设备进行特定交互,同时保持动态输出中角色的视觉一致性。

此外,Vids 进一步整合了多模态能力。基于近期加入的 Lyria 3 系列音频模型,结合 Veo 3.1 支持生成 8 秒视频片段,为普通用户和企业高级账户提供每月 10 至 1000 次不等的生成配额。

为了闭环工作流,Google Vids 现在包含直接导出到 YouTube 的功能,并配合新的 Chrome 屏幕录制扩展程序,构建从内容捕捉到最终分发的完整工作流。

与此同时,AI 领域的竞争格局持续加剧。微软同日发布了 MAI 系列的三个基础模型,涵盖 25 种语言的语音转录、音频生成和视频生成,旨在以更低的成本壁垒挑战谷歌和 OpenAI 的市场地位。

自 2024 年 Vids 推出以来,谷歌迅速迭代了 3D 卡通角色和多语言支持。这种基于提示词的细粒度控制,标志着 AI 视频工具从简单的内容生成转向更专业和自动化的导演阶段,进一步重塑企业内容生产的成本结构和创意边界。

纵观此次更新,谷歌显然希望在企业级视频生产领域建立更深的护城河。随着模型可控性的提升和生态链路的打通,AI 视频生成正在摆脱“随机抽奖”的属性,向标准化生产力工具演进。对于内容创作者而言,这意味着效率的飞跃,但也对提示词工程和创意策划能力提出了新的要求。