在大模型技术迭代日益加速的今天,版本号的每一次跃迁都牵动着整个技术社区的神经。尤其是当头部模型展现出显著的性价比优势后,市场对于其下一代产品的性能边界有了更具体的想象空间。从工程化落地的角度来看,模型版本更新往往伴随着架构优化、上下文窗口的扩展以及多模态能力的深化,而这些技术指标的进步,直接关乎应用场景的拓宽。

DeepSeek V4 真的要来了?

不更新则已,一更新便是大动作,DeepSeek V4可能真的近在咫尺!

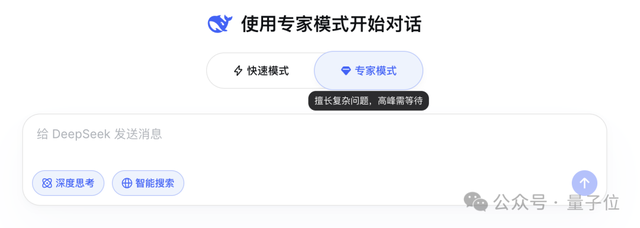

就在近日,DeepSeek 网页端经历了一次显著的功能升级,正式推出了「快速模式」和「专家模式」两大核心功能。

除此之外,一个带有图片图标的「视觉模型」入口也已悄然开启灰度测试。(好家伙.jpg)

尽管官方尚未对这两个模式背后的具体模型版本进行详细说明,但网友们通过细节挖掘,还真发现了一些蛛丝马迹:

是的,模型自己在对话中承认了版本是「V4」(doge)。

虽说单凭对话内容的可信度有待考证,不过结合种种迹象来看,大众的推测并非空穴来风——

V4 可能真的离我们不远了???

(最好不要再是虚晃一枪!)

常言道,DeepSeek 一更新,关于 V4 模型的揣测必定少不了。(笑)

我们先来拆解一下刚刚上线的「快速模式」和「专家模式」到底有何不同!

从名称字面意思和模式介绍上不难看出,两种模式主要还是生成速度和任务处理范围的差异~

这里帮助大家简要总结了一下这两种模式能力的侧重点:

- 快速模式:适合日常对话、即时响应、处理日常比较简单快速的问答,支持上传图片和文件。

- 专家模式:更偏向复杂任务处理,更擅长内容生成、代码、网页等任务,不支持多模态和文件上传,而且目前还是限量供应。

直接来一道超超超超经典的「鹈鹕骑自行车」的 SVG 实测题,看看两种模式的生成效果具体有啥差异!

(左图为快速模式、右图为专家模式)

从生成效果来看,虽然两种模式在鹈鹕和自行车的融合度上都还有一定提升空间,但整体比较下来,专家模式的完成度还是要更胜一筹~

接着我们再把难度往上抬一下子,让两种模式分别生成俄罗斯方块小游戏,be like:

(左图为快速模式、右图为专家模式)

从页面布局和视觉效果来看,两种模式在游戏设定和整体页面结构上的差别其实并不算大,而且二者运行都没有明显问题,基础操作按键也都可以正常使用。

比较明显的区别,可能更多体现在一些细节处理上——

比如专家模式生成出来的 icon 图标,看上去会更精细一点???(大家觉得呢)

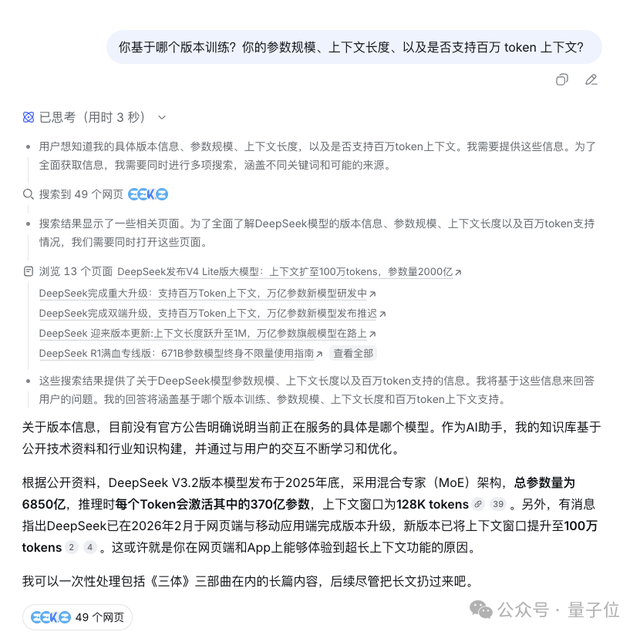

除了实测效果之外,为了进一步摸清专家模式背后的模型真面目,我也继续刨根问底了一下——

结果,当专家模式被追问模型参数、上下文长度等关键信息时,模型选择了:不予正面回答。

(主打一个,遇到难回答的问题就《跑题》)

跑题归跑题,但架不住网友们从专家模式中察觉到 V4 模型的一些蛛丝马迹。

比如下面这位网友,用专家模式做了一个网页游戏,得出的结论和我们刚才实测「鹈鹕骑自行车」的感受差不多:

专家模式和快速模式之间,效果差距并没有拉得特别大。

因此这位网友的推测是,专家模式目前很可能调用的还是某个版本的 V4 Lite,完整版 V4 或许已经不远了。

不止如此,还有网友在直接询问专家模式自己的模型名称时,模型甚至大大方方地表示:自己就是「V4」。

(真的假的,咱也不好说…)

当然,围绕专家模式到底是不是 V4,网上大家伙也有不少不同声音。

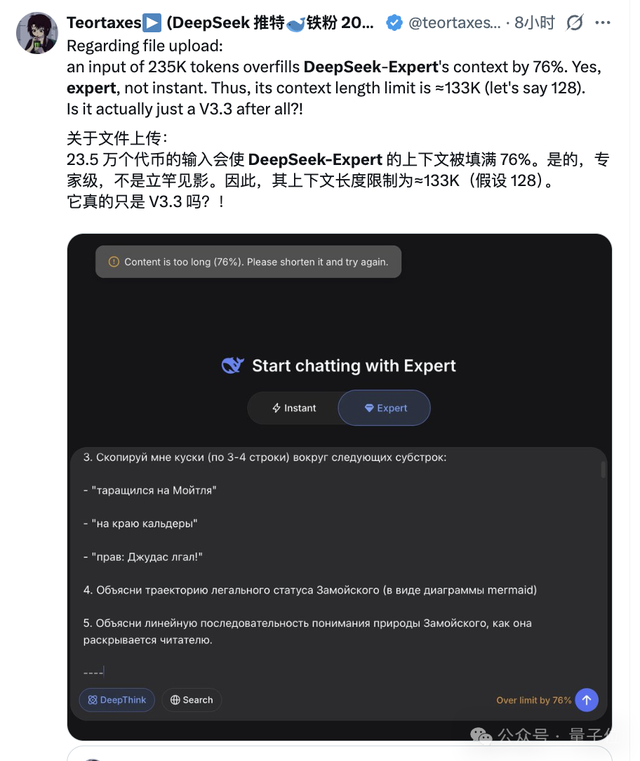

例如下面这位网友就在使用专家模式时发现,当输入 token 数量达到约 133K 时,就会触发长度限制。

而根据目前社区流传的 V4 模型参数信息,完整的 DeepSeek V4 预计将支持 1M token 的超长上下文。

这么一看,专家模式当前表现出来的上下文长度,又和大家预期中的 V4 不太对得上,没准也可能是 V3.3 的模型版本:

至于专家模式到底是不是 V4、完整版 V4 何时上线,目前 DeepSeek 官方嘛——还没有给出任何明确说明。

所有线索,都还停留在网友的实测和猜测阶段。(doge)

哦对了,除了这次上线的快速和专家两种模式外,还有一个「vision」模式也已经开始灰度测试。

(有被灰度到的小伙伴,欢迎来评论区聊聊实际效果~)

咋说呢,关于 DeepSeek V4 的发布传闻,从年初到现在就像一场持续上演的大型的《狼来了》。(doge)

其实早在去年底 V3.2 版本正式落地后,各大技术社区就已经开始热议下一代 V4 模型的迭代方向,毕竟——

从版本更新节奏和技术布局来看,DeepSeek 的模型迭代本就有清晰的进阶逻辑,V4 的研发筹备本就是意料之中的事…

关于 V4 版本的各种详细地不能再详细模型参数,可以说是全网《遍地开花》。

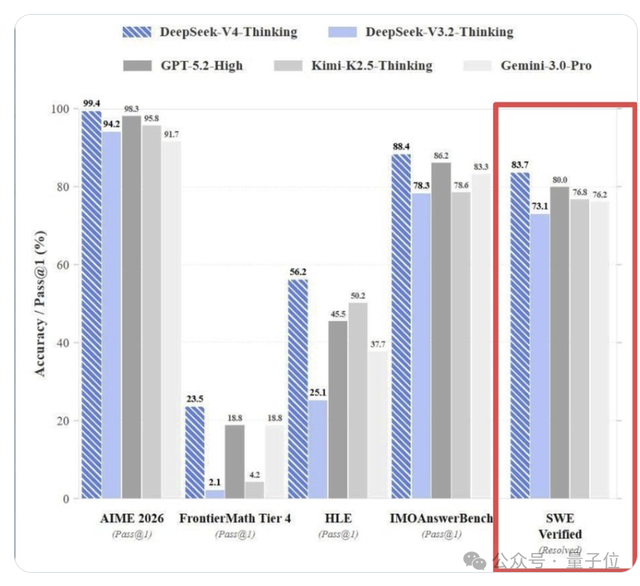

此外,关于 V4 模型的各种基准测试结果也开始疯狂流出,在不少基准测试中 V4 的表现都碾压 GPT5.2、Gemini3 等模型。

强,真·强啊。

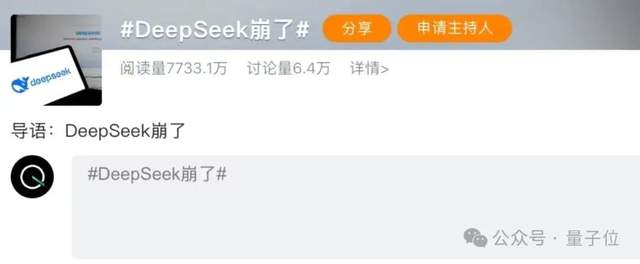

再就是上个月,DeepSeek 一次普通的服务器崩溃事件,由被网友直接送上热搜。

(V4 传闻的新素材这不就来了吗!!!)

原本只是一次常规的技术故障,却被大家脑洞大开地解读 V4 模型即将发布,服务器正在做上线前的压力测试,各种猜测和分析又又又又刷屏社区:

emm…隔三差五就被拎出来热议,却始终没等来官方实锤(doge)。

(真·《狼来了》)

当然了,这次 DeepSeek 突然上线「专家模式」,无疑给持续发酵的 V4 传闻又添了一把火…

哪怕只是网传的轻量化 V4 Lite 版本,也意味着完整版 V4 的研发已经进入收尾阶段,正式落地或许真的不远了。

没招了,大家只能安心蹲蹲吧~

从行业发展的宏观视角来看,大模型版本的迭代不仅仅是参数的堆叠,更是推理效率与成本控制的平衡艺术。若 V4 确实如传闻般在长上下文与复杂逻辑推理上取得突破,将标志着国产大模型在通用人工智能(AGI)的探索上迈入新的台阶。对于开发者而言,关注模型更新的同時,更应关注其 API 稳定性及实际落地场景的兼容性。

未来,随着模型能力的增强,如何确保技术红利转化为实际生产力,将是整个产业链需要共同面对的课题。无论 V4 何时正式发布,技术的演进趋势已不可逆转,保持关注与理性期待,或许是应对这波技术浪潮的最佳姿态。