当前,AIGC 视频生成领域正处于技术爆发与落地应用的关键十字路口。尽管生成质量不断提升,但推理速度慢、算力成本高依然是制约大规模商用化的核心瓶颈。如何在保证生成质量的前提下实现极致加速,成为了各家大厂与技术团队竞相攻关的重点方向。

视频生成速度慢、成本高,长期以来都是 AIGC 领域的痛点。这一次,腾讯混元团队给出了一套全新的解决方案。

腾讯混元团队正式开源了一款名为 DisCa 的视频生成加速方案,代码与模型权重均已公开。这项工作已被计算机视觉顶会 CVPR 2026 接收,也是学术界与工业界首次在蒸馏后的少步数模型上探索可学习的特征缓存加速技术。

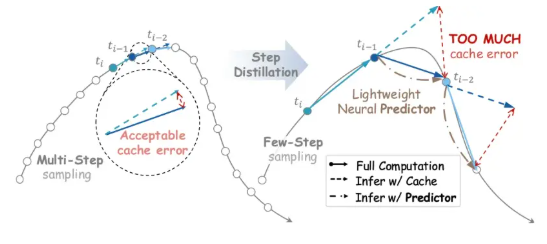

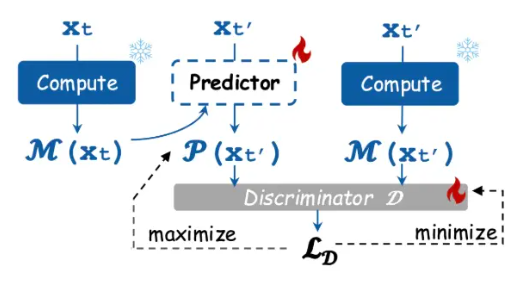

DisCa 的核心理念,是在已经完成蒸馏且推理步数极少的模型上,进一步降低推理成本。传统的特征缓存方案在多步生成模型上表现良好,但直接应用于少步数蒸馏模型会导致较大的缓存误差,致使生成结果崩坏。DisCa 通过引入一个轻量级的神经网络预测器来解决这一问题,该预测器通过对抗学习训练,能够基于缓存特征准确预测后续特征的演变轨迹。这使得加速边界在保持生成质量的同时延伸至 11.8 倍。

另一个值得关注的方向是 R-MeanFlow。由何恺明带领的 MIT 团队提出的 MeanFlow 方法在图像生成上表现优异,但腾讯混元团队发现,将其直接应用于更复杂的视频生成任务会导致过于激进的“一步生成”目标,进而负面影响模型训练。他们的改进思路简单直接:既然一步生成尚不可行,便在训练过程中移除激进场景,将步数范围约束在合理区间内。这一结论与 MIT 和谷歌团队的并发研究一致,相关成果已应用于当前最佳开源视频生成模型 HunyuanVideo-1.5 的实际训练中。

从技术演进的角度来看,特征缓存与蒸馏技术的结合,标志着视频生成模型正在从“可用”向“好用”迈进。随着推理成本的显著降低,实时视频生成及端侧部署的可能性将进一步增加。对于行业而言,这不仅意味着算力资源的节约,更为互动娱乐、实时内容创作等场景打开了新的想象空间。腾讯混元此次的开源举措,无疑将为整个生态的技术迭代注入新的动力。