具身智能正处于从“感知智能”向“认知与行动智能”跨越的关键节点。随着大模型技术向物理世界延伸,行业对于“世界模型”的定义与评价标准正在经历一次深刻的重构。过去单纯追求视觉生成质量的路线,正逐渐让位于能够真正指导机器人完成复杂任务的系统级能力。在这一背景下,如何建立符合具身场景的评价体系,以及如何解决长时记忆、推理延迟与数据供给等工程化难题,成为了衡量技术落地价值的核心标尺。

重塑具身世界模型评价方式

行业观察 | 具身智能前沿

今年 4 月,具身智能领域发生了一件看起来不大、但意味深长的事。

Generalist AI——也就是 PaLM-E、RT-2 背后那批人创办的明星公司——发布了 GEN-1,并在三个核心维度上做出了跨越式提升:

成功率超过 99%,速度提升 2–3 倍,数据量和微调成本只需上一代的 1/10。

几乎就在同一周,其 CEO Pete Florence 发表了一篇博客文章,明确表示:他们不再把自己的模型归类为 VLA。

这件事之所以值得被认真对待,是因为 Pete Florence 本人就是VLA 概念的共同开创者之一。

Florence 在文中把理由说得很直白:

“世界模型”正在迎来属于它的高光时刻;而在 2023 到 2025 年间,风头正劲的是 VLA。

更关键的是,他点破了一个行业长期回避的事实:把“视觉 – 语言”训练引入机器人,很大程度上是因为机器人自己的交互数据还不够多,所以 VLM 只是一根过渡期的“拐杖”。

一旦物理交互数据规模起来,这根拐杖就该被拿掉,而不是继续围着它做架构设计。

我们需要围绕一个更朴素的问题做系统级回答:

当超越 VLA 之后,下一代具身模型应该长什么样,才能真正支撑机器人在真实世界中持续、稳定、可扩展地跑起来?

这是一个很重要的立场区分,也是所有从业者需要以“返璞归真”的思维方式,重新思考的问题。

当下,在具身智能领域,VLA 和世界模型都是非常主流的技术路线。

今天不少被冠以“世界模型”之名的工作,其实属于视频生成范式——在 RGB 像素或低层视觉隐空间里拟合未来帧,本质上还是在回答“下一帧是否符合真实视频的视觉逻辑”,而不是“世界进入了什么对行动有意义的状态”。

这类模型在视频 benchmarks 上的指标也许很好看,但一旦接入真实机器人任务,立刻暴露出四类系统性瓶颈:

- 表示瓶颈:在像素空间建模,模型被迫把容量消耗在纹理、光照、背景这些与任务弱相关的信息上;

- 记忆瓶颈:因果自回归 + KV Cache 的组合,空间复杂度随轨迹长度线性增长,长时任务越跑越重,难以稳定落地;

- 推理瓶颈:感知→推理→执行严格串行,部署端延迟高,闭环频率就天然上不去,机器人“走走停停”;

- 数据瓶颈:模型依赖固定的离线数据集训练,缺少持续、新鲜、物理可信的信息流,难以飞速进化。

这四件事如果不被一起解决,“世界模型”这个词在机器人的世界里很难落地。

范式切换之后,下一个更隐蔽、但同样关键的问题是:

世界模型到底该怎么评价?

今天被频繁引用的,大多是面向视频生成的那一类榜单——考察未来帧的画质、FVD、时序一致性、文本 – 视频对齐。

这些指标对“生成式视频模型”是合理的,但放到具身语境下,评价对象就开始和目标错位。

这出自同行论文的实证结论。2026 年 2 月,清华等机构联合发布的WorldArena基准,在 14 个代表性世界模型(涵盖 Veo 3.1、Wan 2.6、CogVideoX、Cosmos-Predict、Genie Envisioner、CtrlWorld 等)上,系统测量了视觉质量与下游具身任务能力的关系,给出的结论相当直接:

High visual quality does not necessarily translate into strong embodied task capability.(高视觉质量并不一定能转化为强大的具身任务能力。)

支撑这一结论的,是一组很硬的数字。

论文构造的综合视觉质量指标 EWMScore,与人类主观打分的相关性高达 Pearson r =0.825,但与作为动作规划器的任务成功率之间,相关性只有 r =0.360——典型的弱相关区间。

更耐人寻味的是,这一论文还观察到:视觉和美学分最高的Veo 3.1,在具身任务指标上反而”improvements are limited”(提升有限),并伴随明显的 semantic drift(语义偏移)。

画得最像真的,恰恰最不懂交互。

这件事的本质,是评价对象错位了:

- 生成式世界模型问的是:“未来画面是否看着像一个合理的视频?”

- 具身世界模型更应该追问的是:“这个未来,能不能被机器人执行,并最终把任务做成?”

这两件事之间的差距,比表面上看起来大得多。

一个模型完全可能生成极其逼真的未来视频,却在真实机器人上因为几何不准、动力学不稳、时序漂移而直接失败;反过来,一个视觉上并不惊艳的模型,却可能在真机上拿到更高的成功率。

所以跨维智能的立场很明确:

具身世界模型的唯一合理指标,是下游机器人任务的成功率。

在这个意义上,RoboTwin 这类以机器人任务成功率为核心评价维度的榜单,才是具身世界模型真正应该被打分的地方。

它考察的不是“你生成得好不好看”,而是“你能不能让机器人在一系列多样化任务中稳定跑通“。

DexWorldModel 的所有设计选择、所有评估方式,都是围绕这一点展开的。

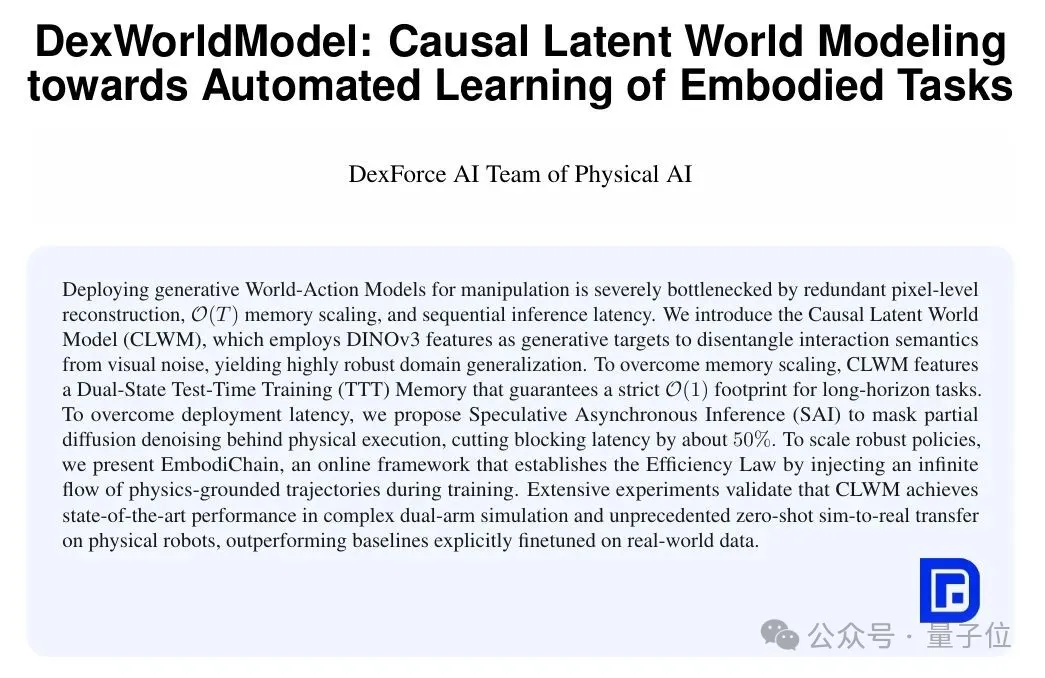

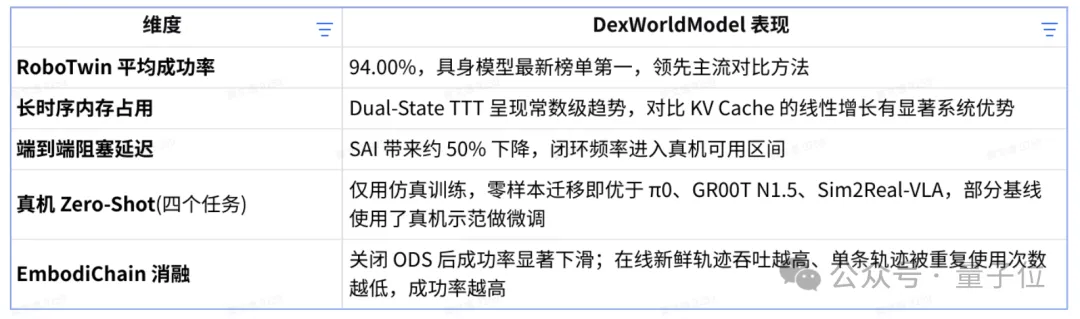

DexWorldModel 在系统上做的事情,可以简化成一条总线:

因果潜空间世界模型 (CLWM)+ 双状态测试时记忆 (Dual-State TTT Memory)+ 推测式异步推理 (SAI)+ 具身数据链与在线数据流 (EmbodiChain / ODS)

这四块不是四个独立模块,而是围绕“真机闭环部署”这一条主线,从表示、记忆、推理到数据供给做出的协同升级,分别回应前面提到的四类瓶颈。

很多世界模型会直接在像素空间、或偏低层的视觉隐空间里预测未来。

这种路径在研究上是成立的,但在真实机器人任务里,模型会被大量与任务无关的纹理、光照、背景细节拖走容量。

对机器人来说,真正关键的不是下一帧画面看起来是否逼真,而是世界是否进入了一个可操作、可交互、可执行下一步动作的状态。

CLWM 把生成目标切换到语义特征:

同时在两阶段 Flow Matching 框架下,把“预测未来语义”和“生成动作”显式拆开:

- 先预测未来潜语义

- 再在条件下生成动作块

视频分支与动作分支共享 MoT(Mixture-of-Transformers) 主干,只在输入输出投影和 Flow Matching 时步嵌入上独立参数化,使“世界未来推演”与“动作生成”在同一套时序动力学上对齐。

这一步从根本上改变了世界模型回答的问题:

不再是“下一帧好不好看”,而是“世界是否进入了一个对下一步行动有意义的状态”。

它也让模型更容易跨越背景、材质与视觉噪声带来的干扰,是后续鲁棒泛化与 sim-to-real 的基础之一(当模型用大量仿真数据训练)。

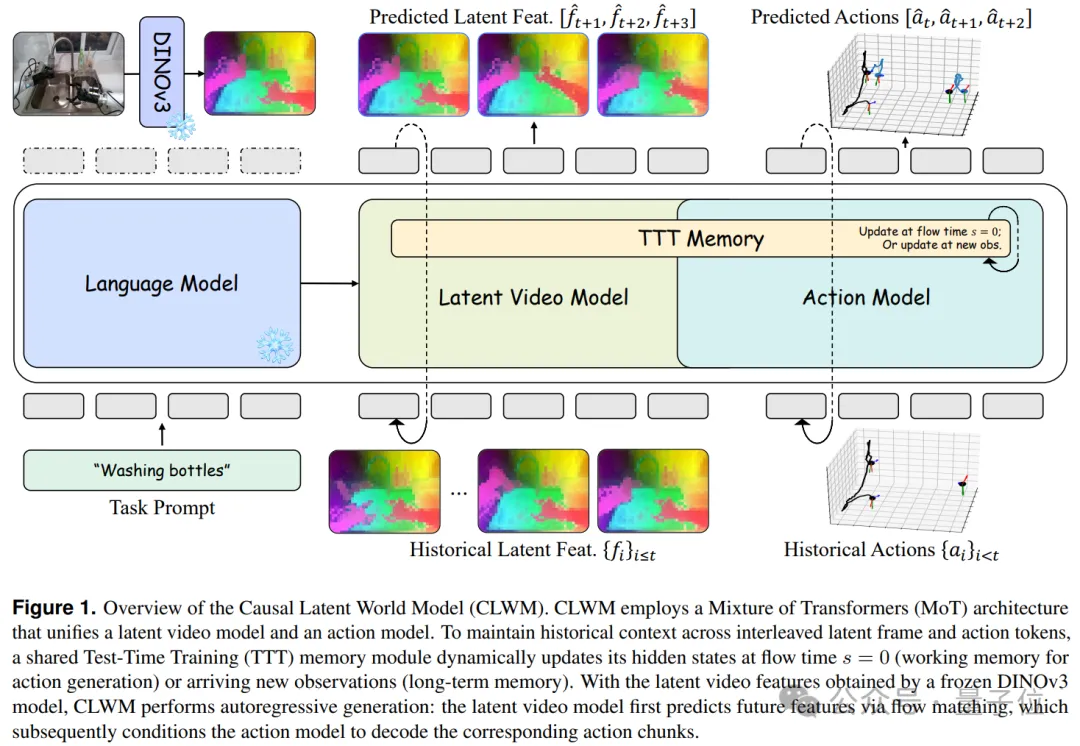

传统自回归世界模型(如 DreamZero 等)依赖 KV Cache 记录历史,空间复杂度 O(T),轨迹一长,显存占用就线性膨胀。

短回合评测中这一点不突出;但一到连续、多步、长时的真实操作,它很快就会变成系统瓶颈。

CLWM 用 TTT-MLP 把历史观测和历史动作压缩进记忆模块权重里,并进一步设计了双状态机制:

- Long-Term Memory:只用真实观测和已执行动作更新,锚定真实因果历史;

- Working Memory:从 Long-Term Memory fork 出来,在当前预测步骤里作为临时上下文;

- Flow Matching 去噪过程中 Working Memory 冻结,去噪完成后才更新。

这套机制最重要的不是“换个缓存实现”,而是把真实历史与推测历史严格隔离——避免 speculative future 反向污染真实因果链,同时把长时序的内存占用压到常数量级 O(1)。

部署含义也很直接:系统在持续运行中不再越积越重,长时操作因此才有机会真正走向稳定部署。

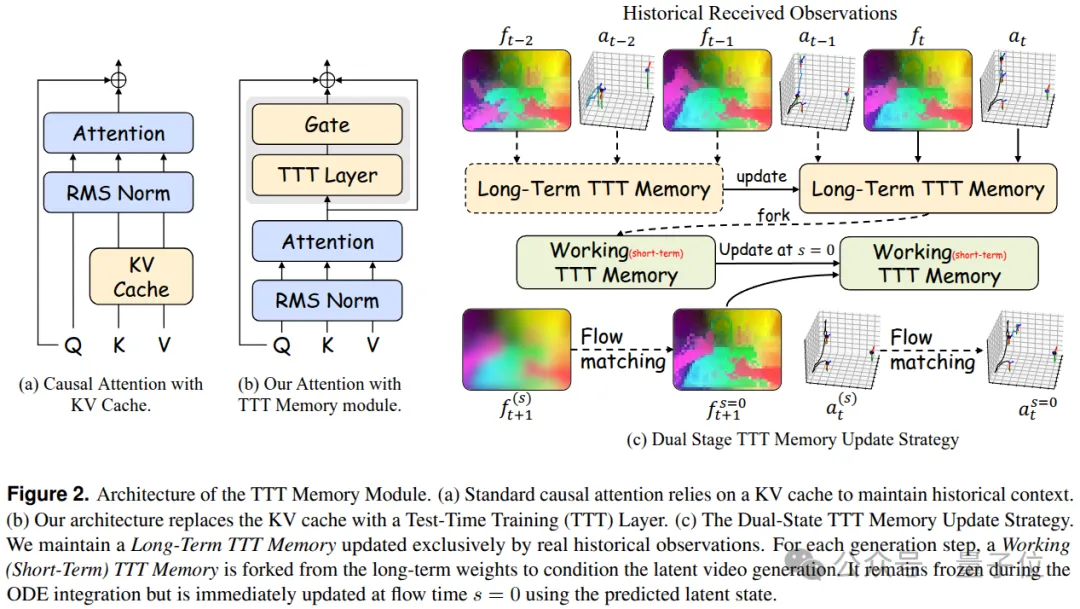

即使模型本身更强,只要“感知 → 推理 → 执行”仍然串行,真机闭环频率就永远被阻塞延迟卡住。

世界模型真正有价值的一点,在于它能对未来做推演;但如果这种前瞻能力只停留在“模型内部想到了未来”,却没有改变机器人系统的运行节奏,那它离部署价值就仍然差一层。

SAI(Speculative Asynchronous Inference) 就是在这一层把模型的前瞻能力真正兑换成系统时间:

- 机械臂执行当前动作时,GPU 不空转;

- 用上一轮预测得到的作为 surrogate condition,后台先完成下一阶段未来语义与动作的前半段 pre-denoising;

- 真实观测到达后,快速更新 Long-Term Memory,再完成后半段精细 denoising。

在 RoboTwin 仿真环境下,端到端阻塞延迟下降约50%。

这背后的变化很关键:传统流程里,机器人执行和模型推理是前后串行的;在 DexWorldModel 里,这两件事开始被深度重叠。

世界模型带来的不只是“更会预测”,还包括“更少等待”和“更高闭环频率”。

对真实机器人来说,这种变化往往比单纯提升几个离线指标更重要。

世界模型能否真正“长大”,取决于它能否持续接触到足够新鲜、足够多样、足够物理可信的经验。

而这恰恰是具身智能与纯互联网数据范式最不同的地方:机器人数据获取成本高、生产慢,很多训练过程仍然受限于有限的静态数据集。

机器人基础模型的瓶颈,很多时候并不在网络结构,而在”高质量交互数据的吞吐率“上。

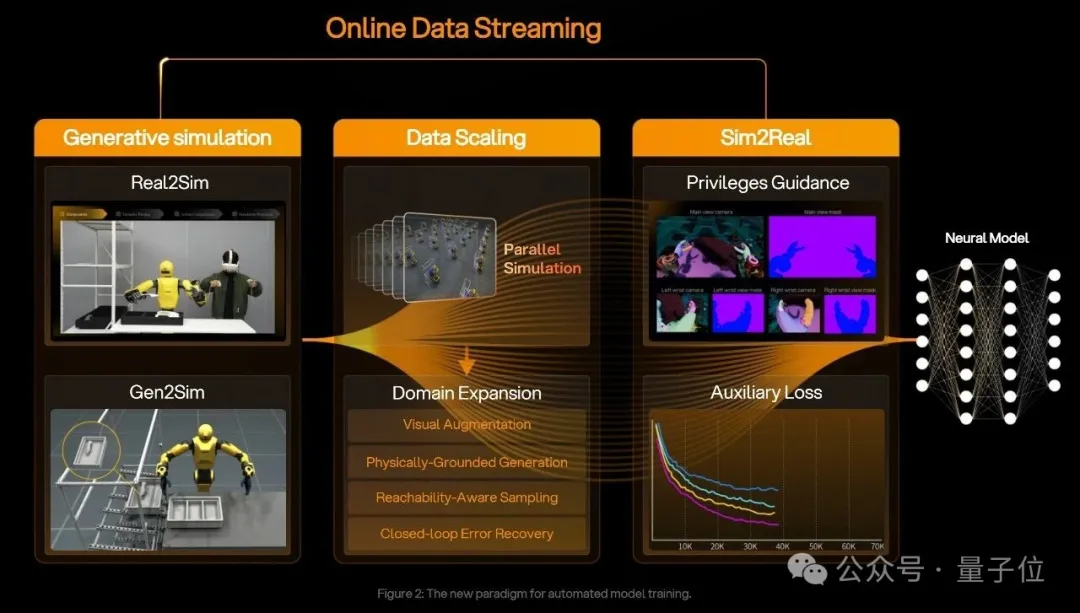

EmbodiChain(项目主页:

- 物理一致的资产与场景快速生成;

- Reachability-aware 轨迹采样,提升功能层面的多样性;

- 失败恢复轨迹回流训练,补齐错误状态下的监督信号;

- ODS(Online Data Streaming):流式注入新的批量数据,替代静态数据集的反复训练。

论文中的消融实验也印证了这一点——当在线数据流中新鲜经验的吞吐更高、单条轨迹被重复使用的次数更低时,任务成功率显著提升。

所以 EmbodiChain 并不是 DexWorldModel 旁边的一套“外围数据工具”,它是 DexWorldModel 能够不断逼近真实世界能力边界的经验引擎。

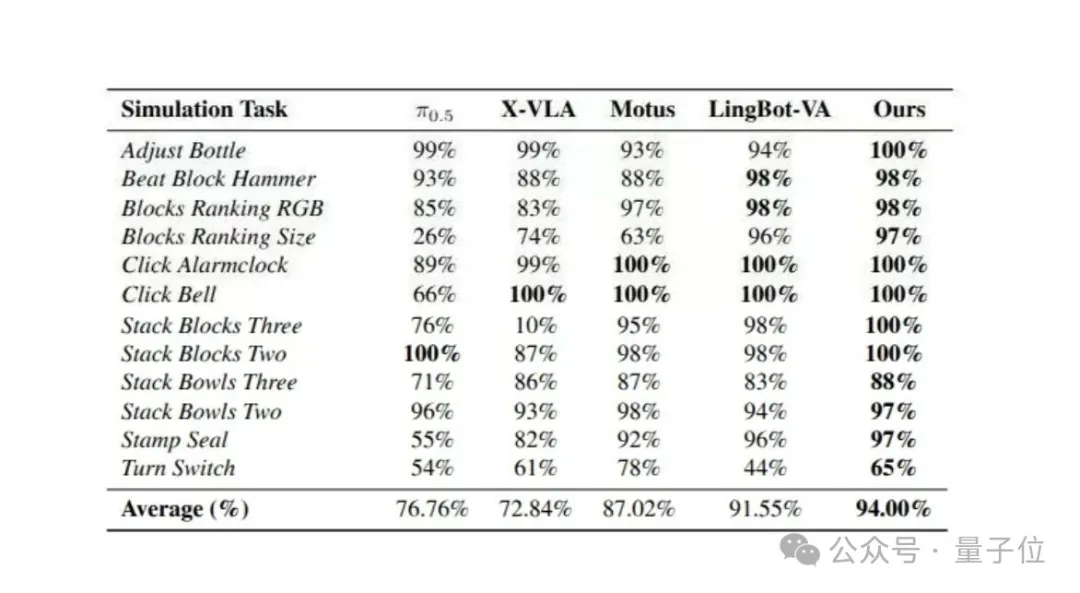

前面提过,具身世界模型真正该被评价的地方,是机器人任务成功率。

所以这回我们把结果直接放在 RoboTwin 这类真正相关的榜单上看。

在仿真环境RoboTwin上,DexWorldModel 取得了94.00%的平均成功率,超过多项已有基线。

系统效率方面,两条结果尤其关键:Dual-State TTT Memory 在长时任务中维持常数内存占用,SAI 将部署 blocking latency 降低约 50%。

更值得关注的是 Sim2Real 这一环。

DexWorldModel 在四个真实机器人任务上报告了零样本 sim-to-real结果:

模型仅在 simulation 中训练,就取得了优于π0、GR00T N1.5 与 Sim2Real-VLA 的表现,而其中部分基线还使用了真实示范做微调。

这组结果有几点值得强调:

第一,它不是单点刷榜,而是系统性结果。

CLWM 解决表示,TTT 解决记忆,SAI 解决推理节奏,EmbodiChain 解决经验供给,四层收益叠在同一条曲线上。

第二,EmbodiChain 不是“可选加持”,而是直接参与了上限提升。

消融实验里,把 ODS 从流程里拿掉,成功率会肉眼可见地下滑。

这进一步印证了“经验流的持续性本身就是一种系统能力”。

第三,Sim2Real 的 Zero-Shot 是最有说服力的一格。

仅仅在仿真里训练,在真实机器人上直接跑通四个任务,且超过了部分用了真机示范微调的强基线,这才是“具身世界模型是否走得通”的真正分水岭。

这当然还不是终点,也不意味着世界模型已经跨过了所有落地门槛。

但它至少说明了一件事:

当世界模型开始围绕语义状态、长时记忆、部署节奏、经验供给这几个关键问题被系统性地重做之后,从概念走向部署的距离,确实可以被一步一步拉近。

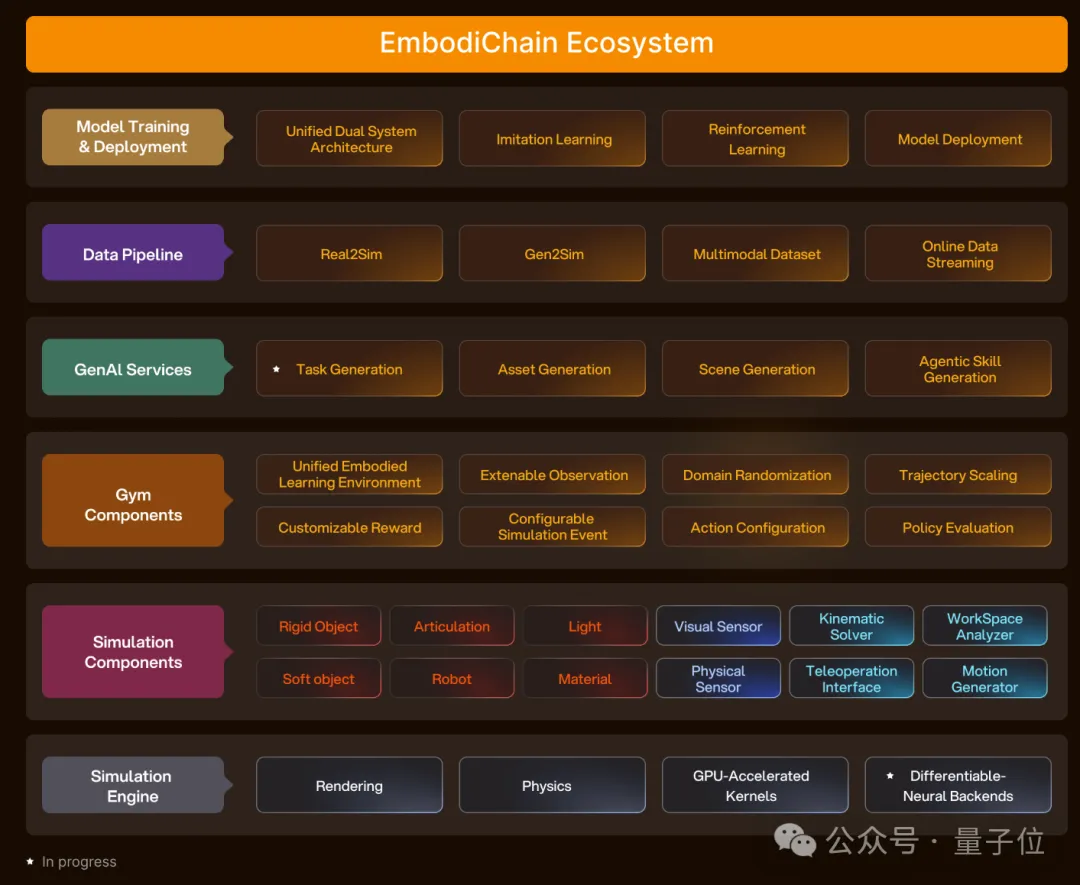

如果说 DexWorldModel 是模型侧的答卷,那么 EmbodiChain 则是跨维智能希望交给整个行业的基础设施。

过去两年,Scaling Law 在具身智能里常常被引用。

但机器人世界真正稀缺的,从来不是参数,也不是存量数据,而是持续、物理可信、可交互的数据流。

在这个变量上,整个领域目前仍然是欠供给的。

这也是我们选择把 EmbodiChain 作为仿真数据基建对外开源的原因。

它不是一个一次性的数据集发布,而是一整套可被社区复用、扩展、共建的经验生产链路:资产生成、场景布局、reachability-aware 采样、失败恢复、视觉域扩展、Online Data Streaming,都以模块化的方式开放出来。

跨维智能希望这件事能帮助行业,把注意力从“模型更大”拉回到“数据基建更持续、更新鲜、更物理可信”这条真正决定具身智能 scaling 斜率的主轴上。

开源不是终点,而是让这条曲线更陡的方式。

跨维智能期待更多同行一起把这套基建用起来,也把它共同推向更完整的形态。

如果要用一句话总结,跨维智能在这一阶段想讲的事情,它其实不只是“发布了一个世界模型”,而是:

世界模型的胜负手,不在视频生成得是否逼真,而在机器人能不能稳定地把事情做成。

当 VLA 的开创者自己都决定抛弃 VLA——剩下的问题只有一个:

谁能先把具身模型这条路,从概念拉到真机。

DexWorldModel 做的是在表示、记忆、推理、数据引擎四层同时发力,把 Sim2Real 的最后几段鸿沟一步步压小;EmbodiChain 做的是让这件事可以持续发生。

接下来,跨维智能会沿着“真机榜单”这条更难、但更有意义的路继续走下去。

DexWorldModel 背后的意义,从来不只是世界模型本身,而是跨维选择直面那些真正决定落地的系统问题——

今天离真实部署最近的阻碍到底是什么,哪些问题值得优先解决,哪些系统能力必须先搭出来。

它没有宣称世界模型已经走完了通向现实世界的路,但它确实把其中几段最关键的间隙拉小了。

这也是跨维智能一贯的态度,不和概念赛跑,和真实世界赛跑。

项目主页: