在大模型从文本向多模态交互演进的关键节点,语音能力的“情感化”与“可控性”正成为区分产品体验的核心分水岭。以往的行业方案往往侧重于识别准确率或合成自然度,却忽略了声音作为情感载体的深层价值。小米此次发布的新一代语音模型,正是试图解决这一痛点,将语音交互从简单的指令执行提升至角色化演绎的层面,为 Agent 时代的交互形态提供了新的技术底座。

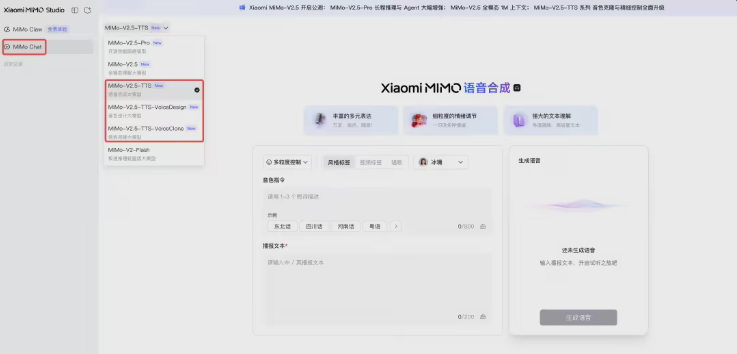

当 AI 语音不再仅仅“能听会说”,而是能像导演一样精确编排情感、语调甚至角色身份时,人机交互的自然度正迈入一个新纪元。小米正式推出了 MiMo-V2.5 全栈语音模型系列,包含三个 TTS(文本转语音)模型和一个开源 ASR(自动语音识别)模型,全面覆盖 Agent 时代的语音输入输出需求,让声音真正成为可编程、可创作、可复制的智能介质。

🎙️ 三款 TTS 模型:声音从此“听你指挥”

小米此次发布的 MiMo-V2.5-TTS 系列,首次在语音生成领域实现了“语言即控制”的范式:

-

MiMo-V2.5-TTS:内置多种高保真 premium 音色,支持通过自然语言指令对语速、情感和语调进行精细控制。用户无需填写参数,只需像指导演员一样描述:“用温柔但坚定的语气说,稍微慢一点,带一点疲惫感”,模型即可准确演绎。

-

MiMo-V2.5-TTS-VoiceDesign:一句话生成新音色——输入“一个 30 岁的知性女性声音,略带南方口音,适合财经新闻播报”,系统将立即创建个性化音色,大幅降低了声音创作的门槛。

-

MiMo-V2.5-TTS-VoiceClone:仅需少量样本(如 30 秒音频),即可高保真复刻目标声音,同时保留响应风格指令和音频标签的能力,适用于虚拟主播、个性化助手等场景。

更具突破性的是其 分层剧本机制:在有声书或游戏 NPC 等需要高一致性的场景中,开发者可以分别定义“角色身份”、“场景氛围”和“单句表演指导”。每一层可独立更新又能协同工作,确保角色声音全程一致,同时每句对话也展现出变化。

此外,模型支持 行内音频标签(如 [emotion: excited]),可插入文本任意位置并组合多个标签,实现复杂的情感编排;即使输入是纯文本无任何提示,模型也能自动解析标点、句结构和隐含情感,产出“生动”的语音。

🎧 开源 ASR:嘈杂现实场景中的“全能耳”

同步开源的 MiMo-V2.5-ASR 专注于“听得清、听得准”:

- 支持吴语、粤语、闽南语、四川话等主要中方言;

- 在混合语言(Code-Switch)场景下无需预设语言即可流畅转写;

- 在强噪声、远场拾音、多人交叉对话(如会议)等复杂环境中保持高鲁棒性;

- 准确识别 古诗词、专业术语及歌词(包括背景音乐干扰);

- 原生输出标点,转写结果可直接用于下游任务,无需后处理。

在多项权威评测中,该模型在通用中英文、方言、语码切换及歌词识别等维度均达到行业领先性能。

🚀 免费访问 + 开源,加速 Agent 生态发展

目前,三款 TTS 模型可在 小米 MiMo 开放平台限时免费访问,开发者可通过 API 调用或 MiMo Studio 快速体验;而 MiMo-V2.5-ASR 模型权重和代码已完全开源,支持社区二次开发。

从产业视角观察,小米选择将 ASR 模型权重与代码完全开源,这一策略颇具深意。在当前开发者生态争夺激烈的背景下,降低语音输入的门槛有助于加速 Agent 应用的落地。而 TTS 模型的精细化控制能力,则为虚拟人、智能陪伴等场景提供了更丰富的想象力。随着语音交互逐渐具备“导演级”的调度能力,人机交互的自然度将迎来质的飞跃,这也将倒逼整个行业在情感计算与语义理解层面投入更多研发资源,推动智能硬件从“工具”向“伙伴”的本质转变。