面向企业用户定向启动客户共创

4月27日,阿里视频生成模型HappyHorse 1.0开启灰测,悟空同步宣布已首批接入,并面向企业用户定向启动客户共创。

HappyHorse 1.0由阿里ATH创新事业部研发,模型依托原生多模态架构,采用音视频联合生成方案,支持文生视频、图生视频、多图参考生视频及视频编辑,可输出15秒多镜头叙事内容,支持多画幅适配和1080P超分输出,画面呈现电影级质感,并具备音画同步能力。

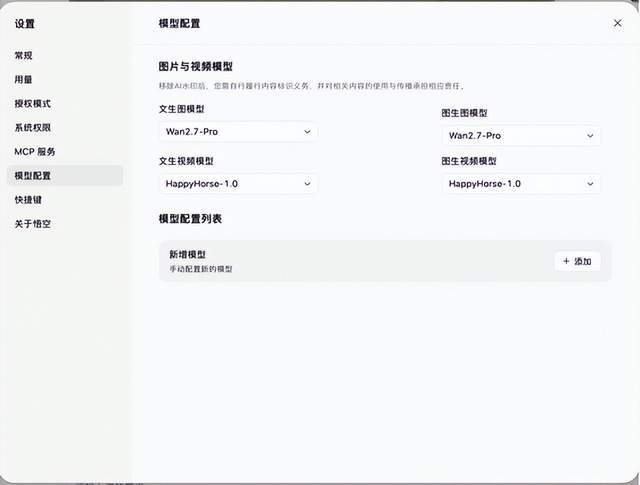

接入HappyHorse后,悟空将提升文生图和文生视频两大多模态创作能力。企业用户可在悟空中通过自然语言描述,直接生成高质量图片和视频内容,无需专业设计技能,也无需在多个工具之间来回切换。悟空已同步启动企业客户共创,邀请电商、设计等行业的企业级用户进行场景共创,将模型技术转变为实实在在的生产力。

以电商场景为例,过去制作一组产品推广视频或主图,往往需要摄影、设计、剪辑等多个环节的协作,周期长、成本高。现在通过悟空,运营人员只需用一句话描述产品卖点和风格,即可快速生成产品展示视频和推广图片,从创意到成品的周期大幅缩短。对于设计类企业,悟空+HappyHorse的组合可以快速生成设计方案的可视化效果,帮助设计师在方案初期快速验证创意,提升从构思到交付的效率。

这是继4月2日率先接入千问3.6-Plus之后,悟空在一个月内再次优先搭载ATH体系内的重磅模型。千问3.6 提升悟空在文本理解和智能体编程的能力,HappyHorse 增强了其视频和图片的多模态创作能力,悟空正在成为ATH全系模型能力的企业级首发平台,一个覆盖文本、代码、图片、视频的多模态AI工作平台正在加速成型。

从技术路线看,HappyHorse 1.0 走的是原生多模态+音视频联合生成路径,这与当前主流的纯视觉扩散模型(如Sora的DiT架构)形成明显差异:音视频联合训练能直接输出带同步音频的影片,免去后期配音对齐的麻烦。不过,15秒的片段长度在叙事连续性上仍有局限,能否通过多镜头智能拼接实现更长的连贯故事,是后续迭代的关键观察点。而悟空作为企业级平台,一次性接入千问3.6与HappyHorse,本质上是在构建“文本理解—代码生成—视觉创意”的闭环,这种“全家桶”策略对中小企业尤其有吸引力——他们可以在一套系统内完成从需求描述到成品交付的全流程,反过来也会倒逼阿里加速模型间协同优化。对于整个视频生成赛道而言,HappyHorse的“电影级质感”如果能在电商、营销场景中验证出可量化的效率提升(比如将原本需要3天的制作压缩到30分钟),那么它将不只是技术秀肌肉,而是真正撬动千亿级内容产业的第一块踏板。