< img id=”wx_img” src=” width=”400″ height=”400″>

全网开源,即刻可用

henry 发自 凹非寺

最近社交媒体上,GPT-Image-2生成的作品随处可见,中文海报、复古杂志、直播画面甚至高考试卷都能做到以假乱真。大家的反应也很一致:专业设计师的饭碗可能要端不住了,普通人也能行了。

但实际体验后会发现,免费用户每天只有几张生成额度,遇到稍微正式点的项目根本不够用。商汤恰好在这个时间点开源了全新架构的理解生成统一模型SenseNova-U1,虽然小尺寸版本仅8B参数,却也能复刻不少GPT-Image-2的经典能力。

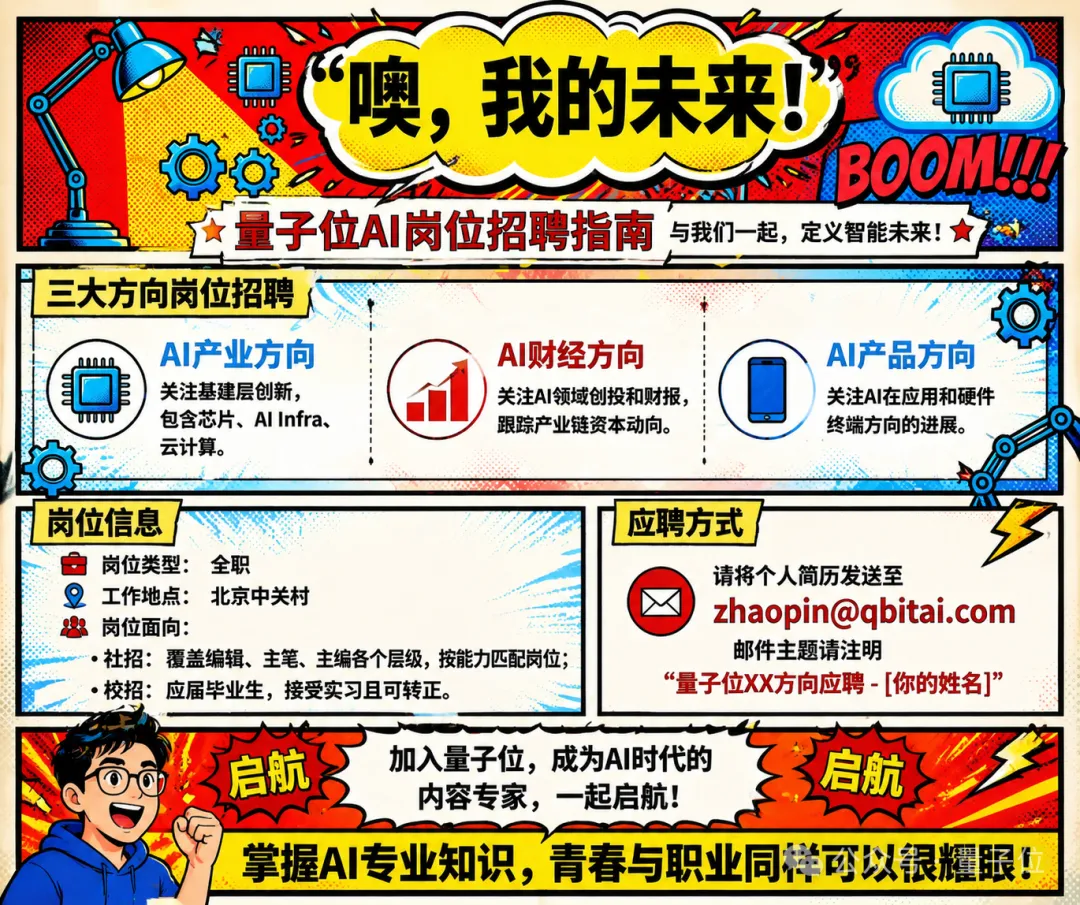

比如用U1生成一张AI快讯网的招聘海报:文字排版、色彩搭配、版式布局都挑不出明显毛病。

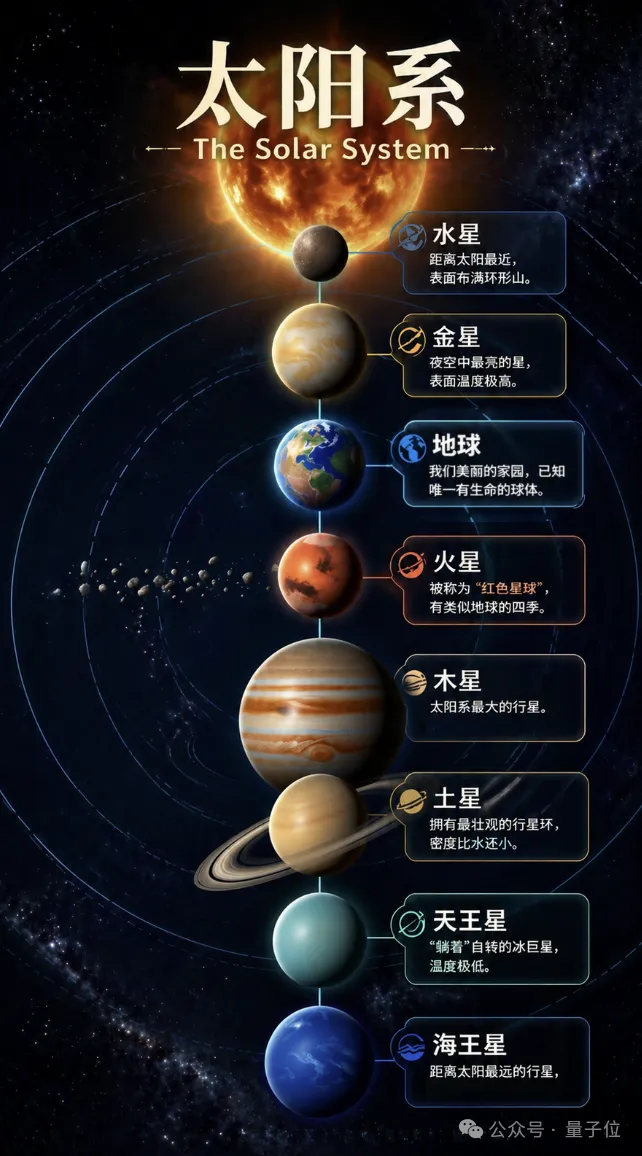

太阳系图解,八大行星的轨道、属性与文字介绍也安排得有条有理。

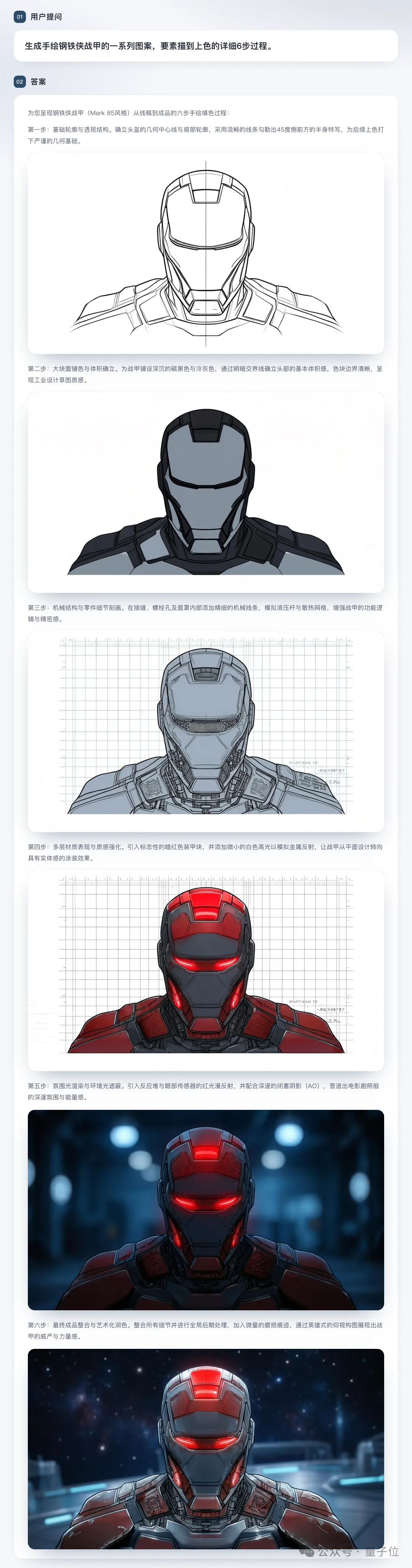

画钢铁侠时,模型会自动从轮廓、铺色、细节、质感、氛围等多个阶段拆解完整绘画流程。

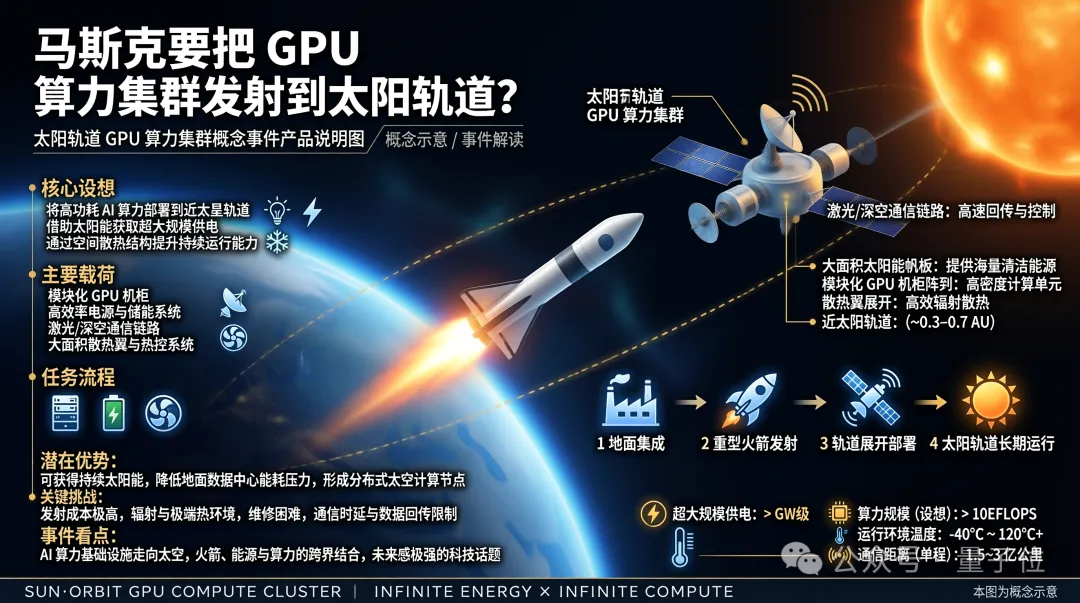

马斯克太空集群信息图的审美也在线。

可以说,信息图、文字密集排版、图文交错这些AI生图曾经公认的硬骨头,U1已经能和GPT-Image-2同台竞技。

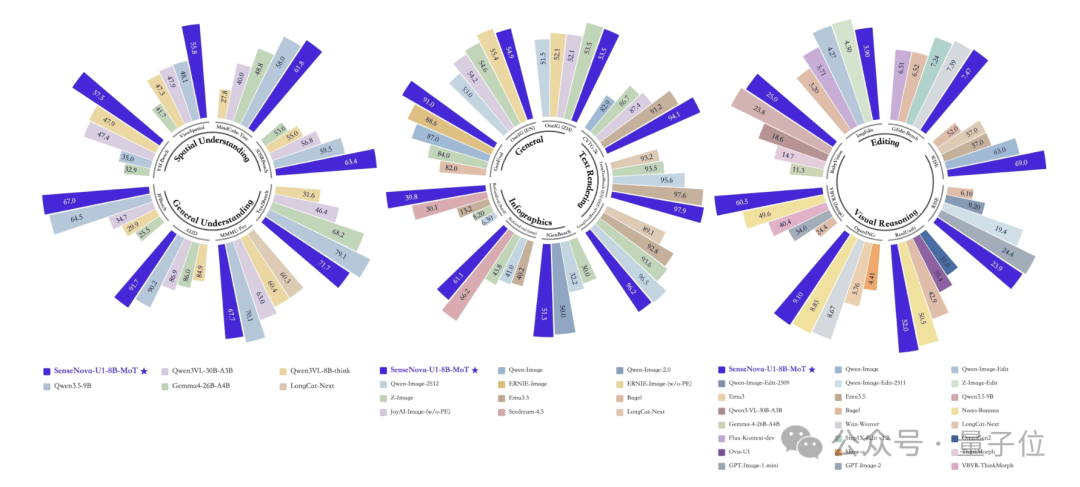

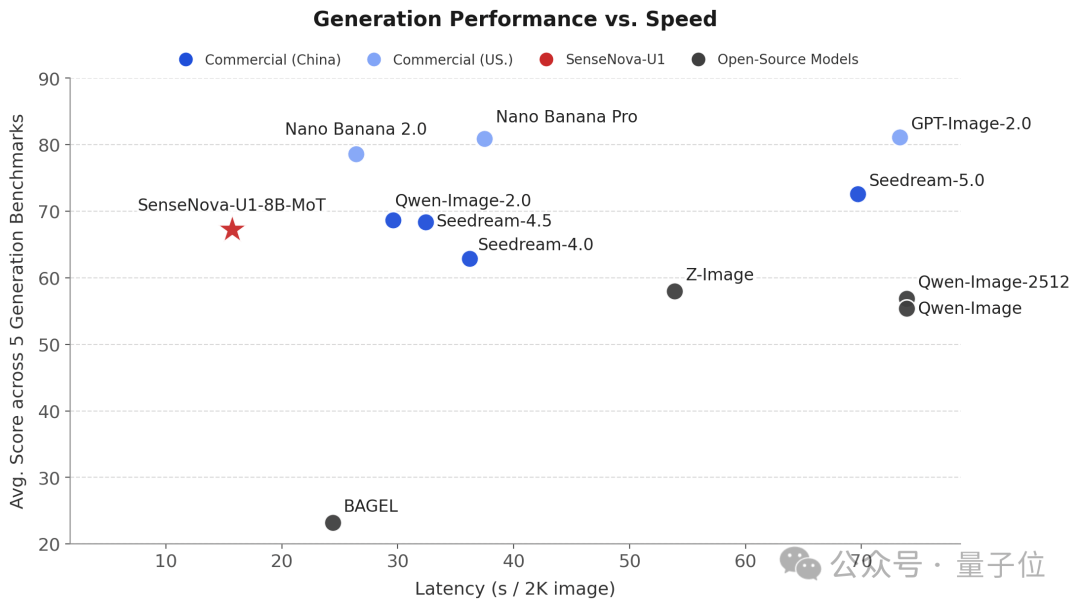

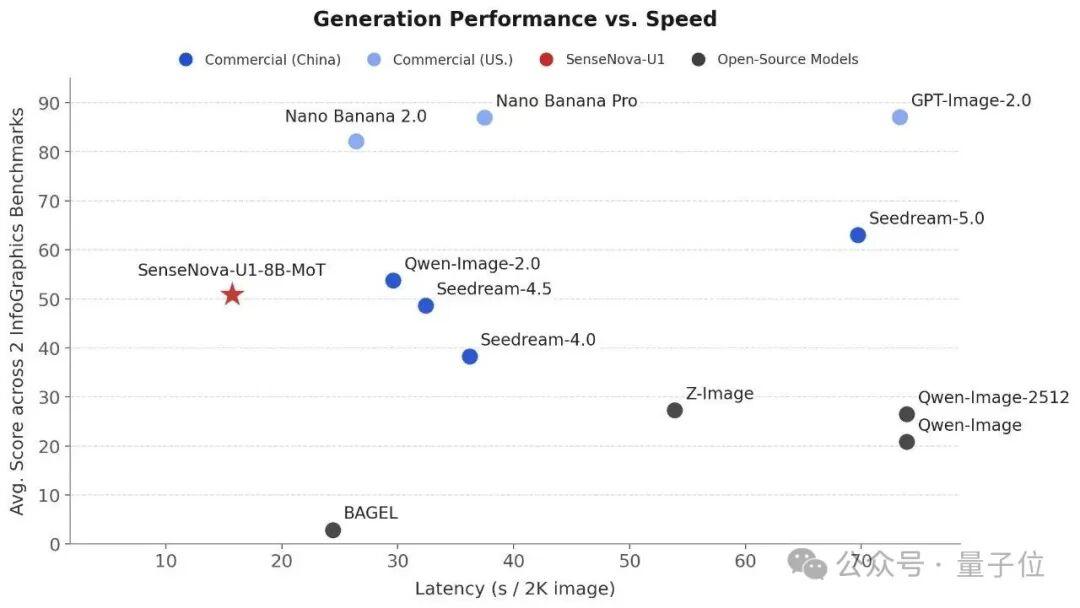

在图像理解与生成的多项指标上,SenseNova-U1也登顶开源模型榜首,推理响应速度逼近主流商用闭源模型。

在推理响应速度上也具备相当优势。

这是怎么做到的?往下看。

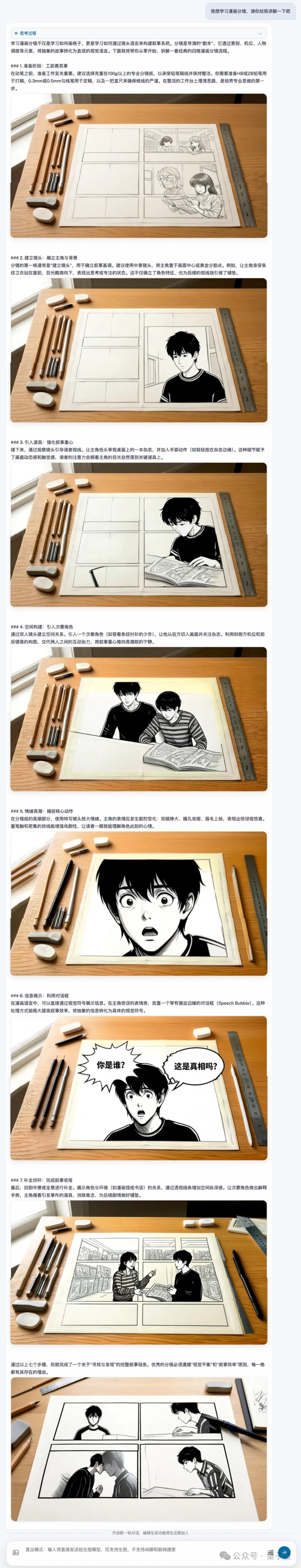

U1最有趣的能力是连续性图文创作,即文字和图片在同一段输出里自然交叠,而不是割裂开来。这听着简单,实际很难,因为保留语义和保留像素细节在传统架构里几乎是天敌。U1的做法是让两者在同一个表征空间里共享上下文,同时兼顾语义丰富性和像素级视觉保真度。

例如让模型生成一个“煎牛排操作教学”,它可以从食材准备到装盘,每一步的关键操作都有图,牛排状态从生肉到五分熟保持高度一致,不会画着画着变成另一块肉。

再比如学习漫画分镜技巧,它可以直接吐出图文并茂的教材式段落,比纯文字解释直观得多。

从准备阶段、镜头建立到引入道具、次要角色,一应俱全。

这种“始终是同一个主体”的连贯性看起来朴素,但对生成模型来说是个挑战。传统范式需要在多个模型之间来回调用,角色形象很容易在第三步就走样。U1单次单模型调用直接出全套。

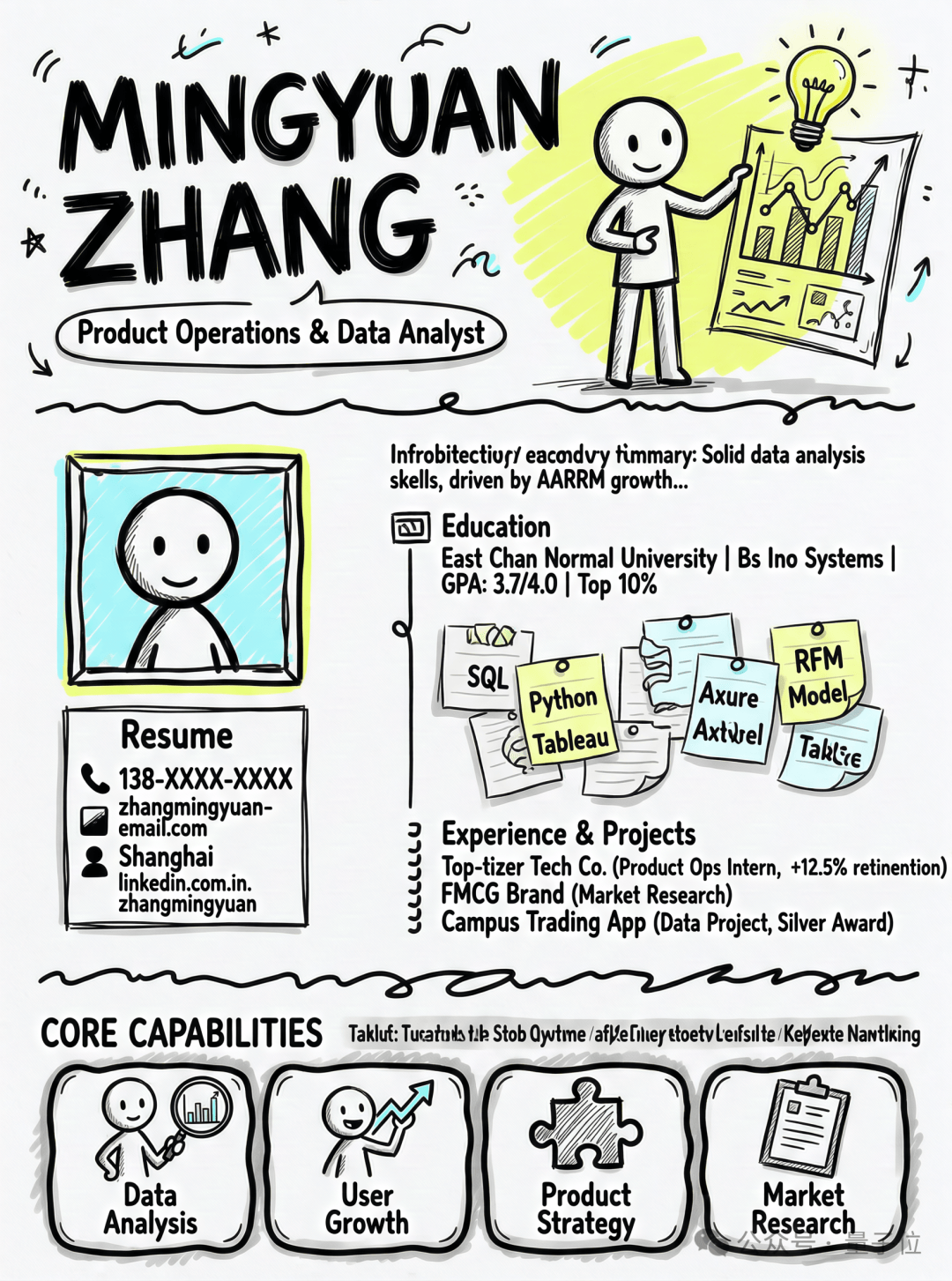

另一个值得关注的能力是高密度信息图。在模型界面中直接输入自己的简历信息,就能返回一张手绘风格海报,信息分布、配色、字体层级都安排得明明白白。

让模型讲“三只小猪盖房子”,输入仅7个字,输出就能直接生成一整组连环画,三只小猪、三种材料、三栋房子、大灰狼,一格一格排好,顺序与故事吻合。

炒红烧肉这类做菜教程图也可以一次直出,图文对应。

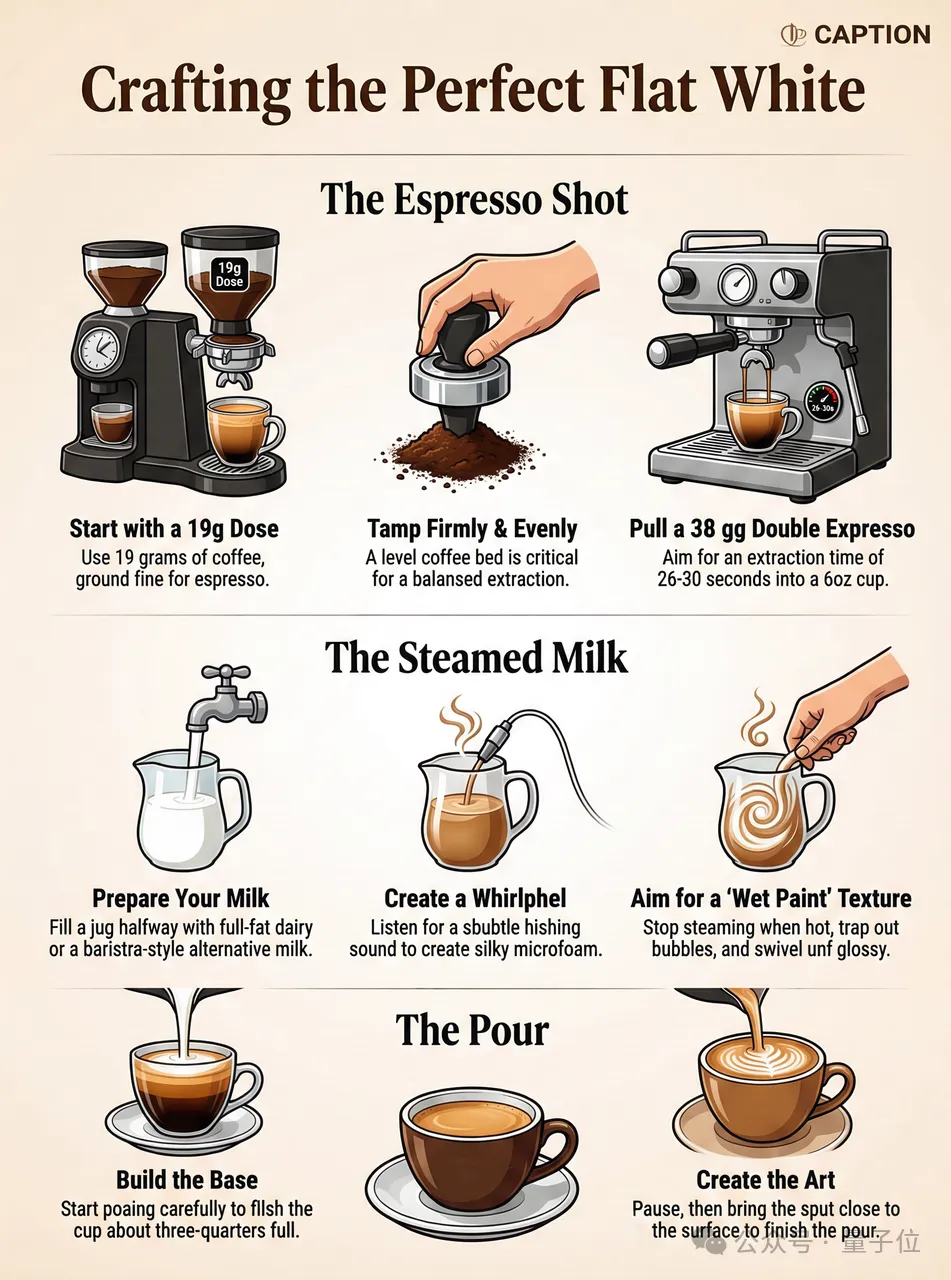

给一句“做杯咖啡的英文流程图”,图也直接出来。

在讲究排版、涉及多种元素的插画场景中,U1也能实现精细效果,比如划船乐的教学总览图。

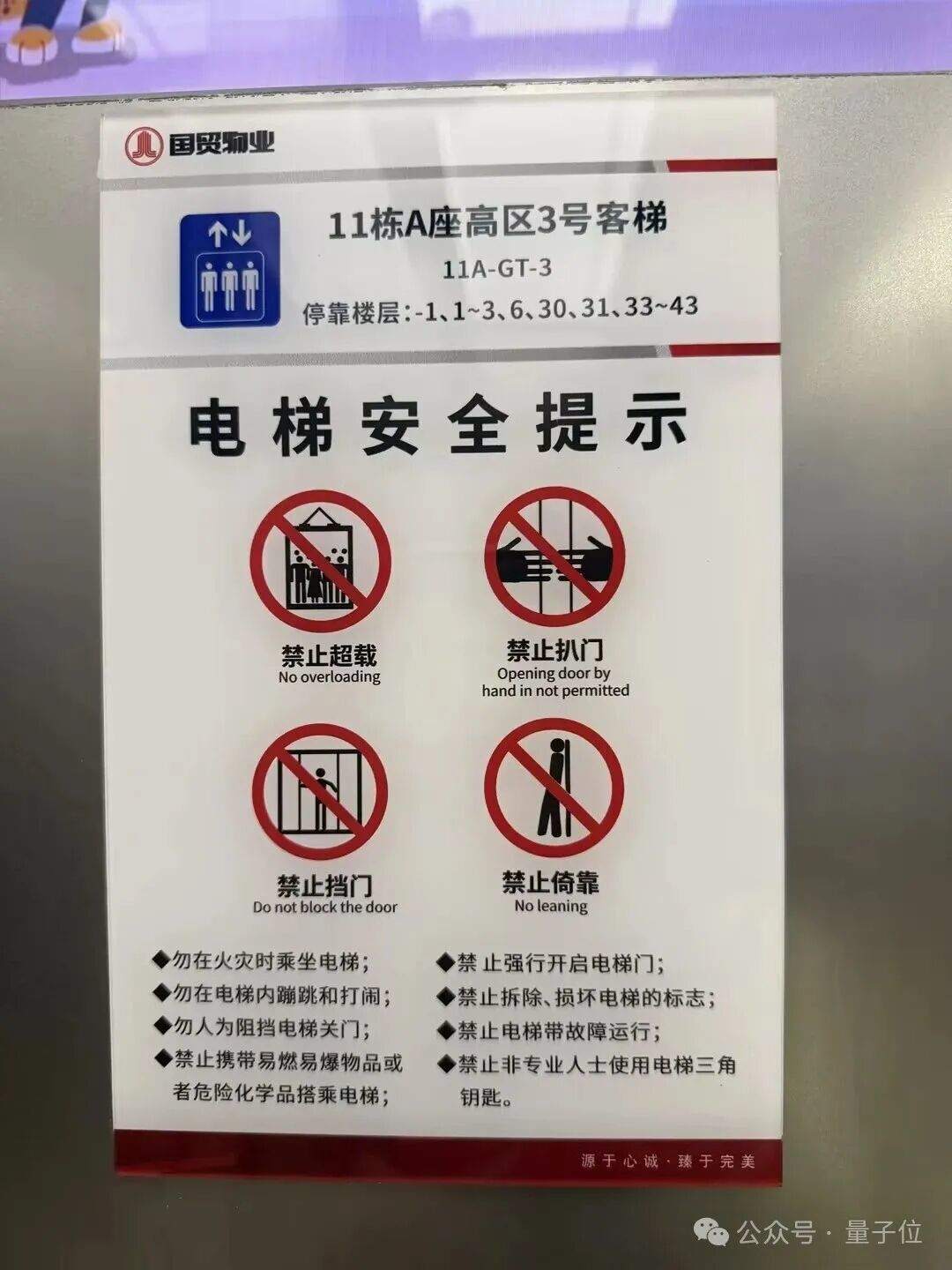

更有意思的是扔给它一张路边常见的“电梯安全”警示牌,让它换个排版做成信息图,它能完美迁移版式,从警示牌变成科普卡片。

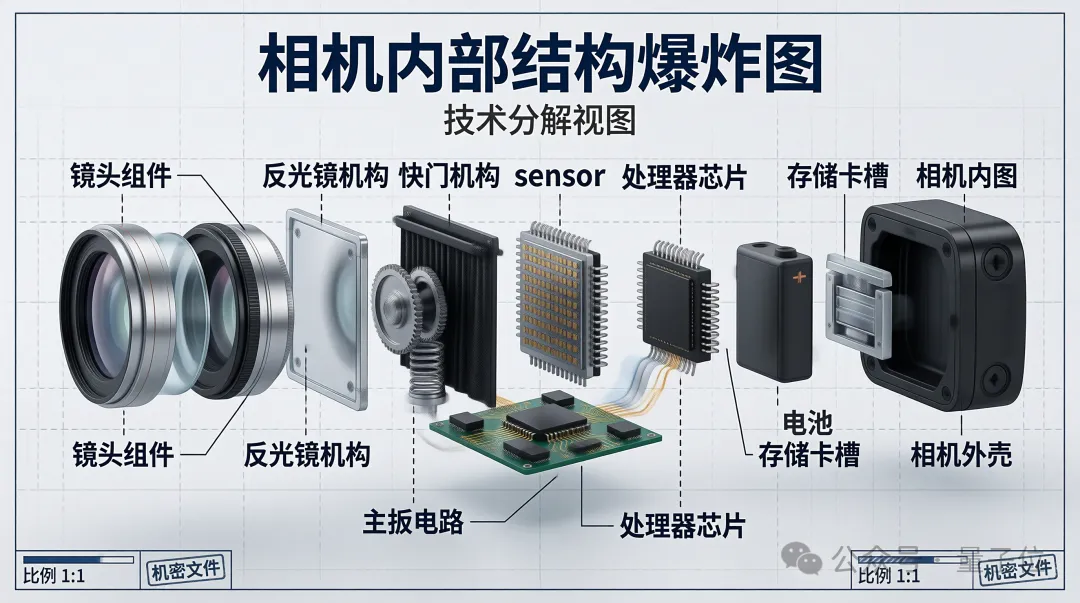

前段时间火爆的产品爆炸图,U1也能做到。一台相机,被拆得整整齐齐,镜头组、反光镜、快门、传感器、芯片、电池等悬浮在空中,标注线一根不少。

这种玩法以前是超大参数模型的专属。更有意思的是,SenseNova U1 Lite还在行业首创了图文交错的思维链,这种推理能力放到图像编辑上更有趣。

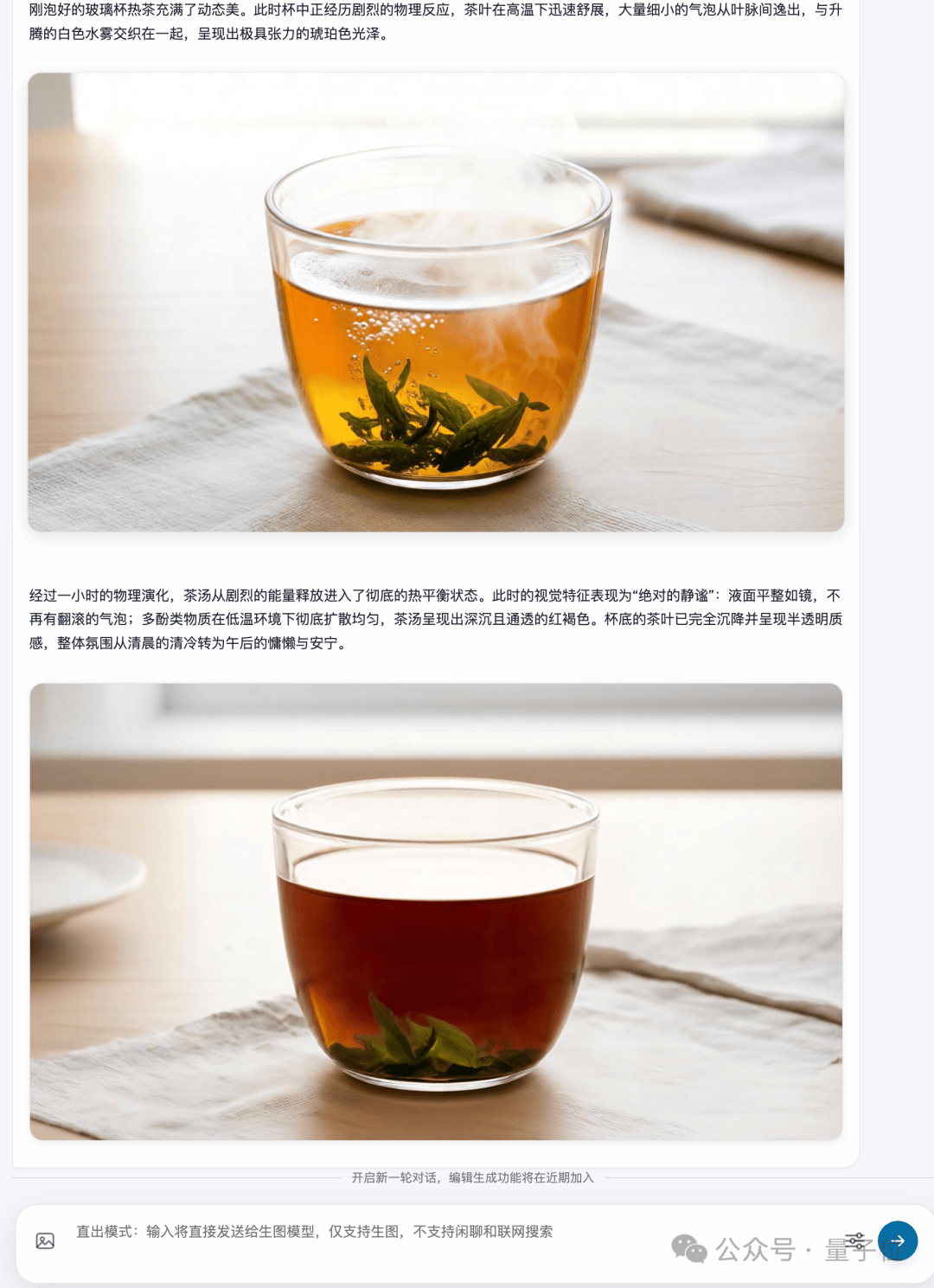

扔给模型一张刚泡好的玻璃杯热茶,让它“画出一小时后的样子”,它会先推理物理过程:刚泡时叶片舒展、气泡逸出、蒸汽折射;一小时后茶汤变深、叶子沉降、杯底出现冷凝痕迹。然后生成符合物理规律的结果。

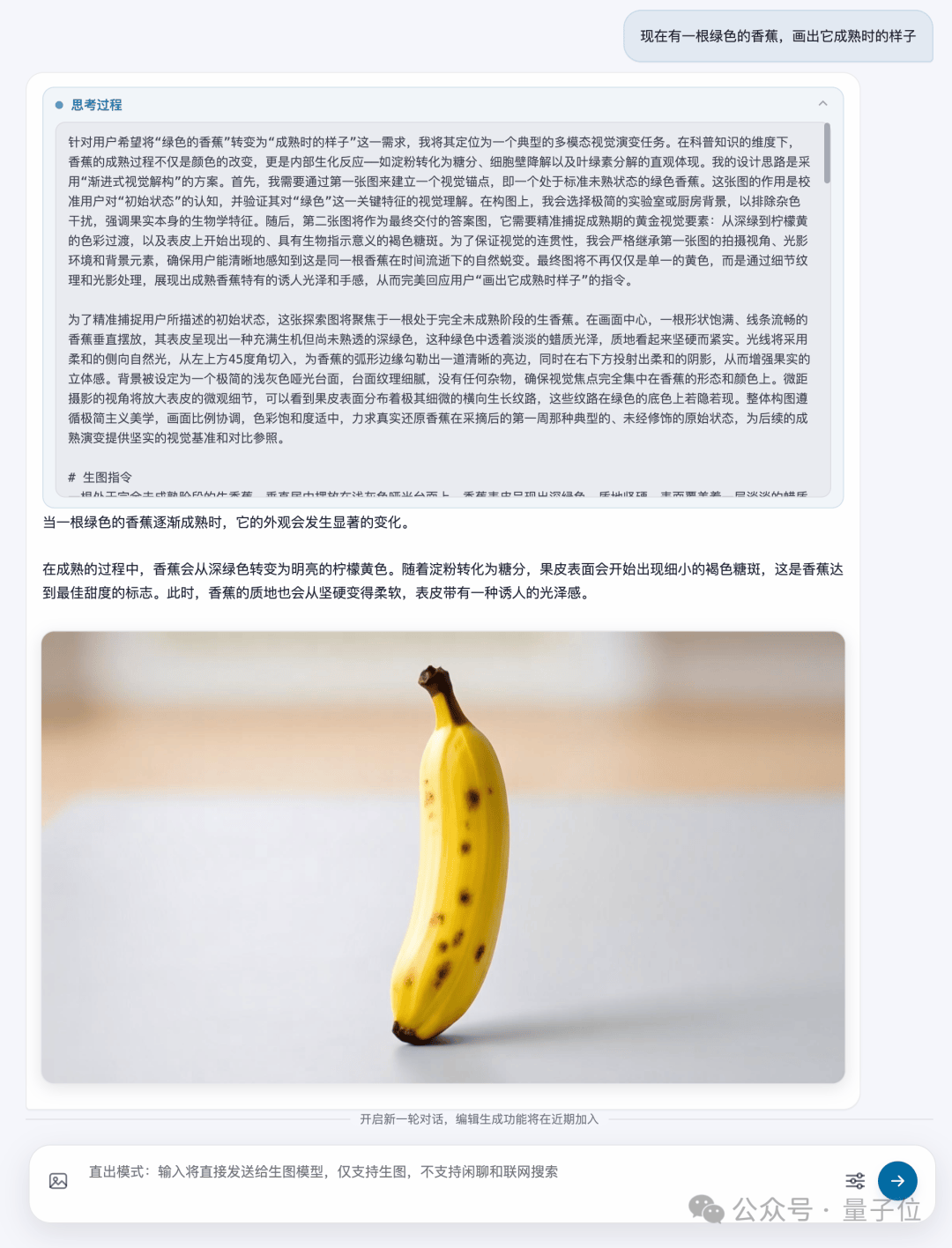

类似地,给一个绿色香蕉,模型会先推理“叶绿素分解+糖化”,输出一根带着斑点的成熟香蕉。

可以说,新模型不只是在改图,还具备了一定的物理常识。

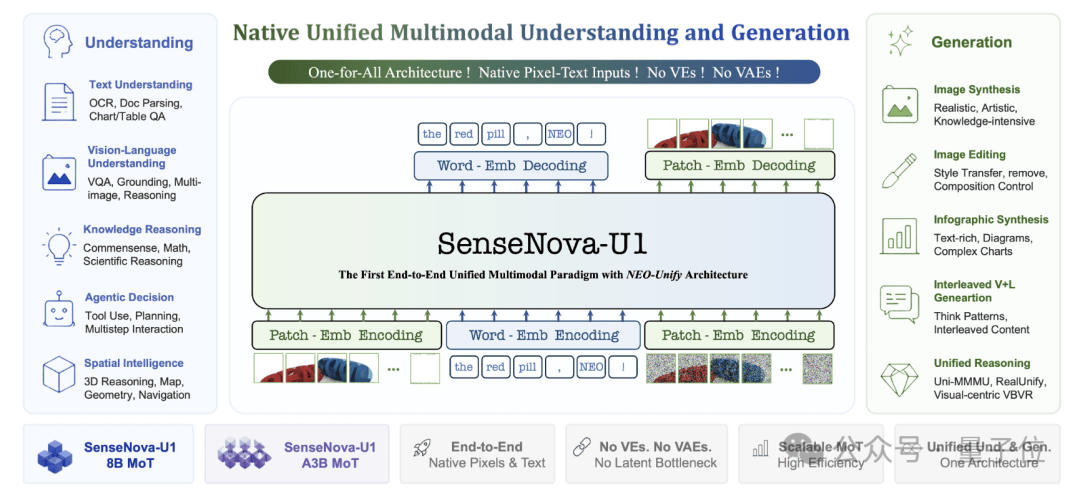

那么,U1是如何实现的?其底层是一套叫NEO-unify的架构,一个模型同时会看会画,理解和生成在同一个网络里完成,没有任何拼接。传统多模态模型通常需要视觉编码器和变分自编码器,理解归理解,生成归生成,中间靠适配器拼起来。NEO-unify拿掉这些东西,模型直接吃像素、直接吐像素。

具体分为三步:第一步引入近似无损的视觉接口,统一输入输出表示;第二步用Mixture-of-Transformer做主干,共享理解和生成底层;第三步文本走自回归,视觉走像素流匹配,两套目标函数在同一框架内跑完。

这套架构赋予了U1连续性图文创作的独门绝活。传统模型需要外挂工具或后处理拼接,而U1底层统一,原生支持图片和文字的交叉排版,所有视觉内容来自模型自身。

模型在思考问题时,可以一边推理一边生成中间示意图,把复杂逻辑可视化;生成教程时,能在恰当位置自然地插入说明图。

落地到两个规格:SenseNova-U1-8B-MoT(8B参数,端侧可跑)和SenseNova-U1-3AB-MoT(38B参数MoE架构,能力更强),底层都是NEO-unify。商汤还配了自研推理栈LightLLM和LightX2V,以H100/H200单节点为例,生成一张2048×2048的图端到端约9秒。

值得一提的是,商汤在README中明确列出了模型局限:上下文最长32K、人物复杂场景细节有时不稳、长文字渲染偶尔出错、连续性图文创作仍是beta。但这些短板均标注“持续改进中”。U1此次开源更像是一个起点而非终点。

为了方便使用,商汤还顺手开源了一套SenseNova-Skills技能包,将U1做成Agent中可直接调用的工具。sn-infographic自带87种版式、66种风格,自动评分挑选;挂进OpenClaw,一句 /skill sn-infographic “提示词”即可出图。Skills覆盖图像生成、PPT制作、Excel数据分析、深度研究、跨平台搜索等。

目前,SenseNova-U1两个模型已在Hugging Face和GitHub全网开源。想直接体验的可以进入SenseNova U1 Lite Skill,另外办公小浣熊也即将上线U1。

从行业视角看,GPT-Image-2的爆火证明了图文融合生成的需求巨大,但商业模型的算力成本和使用门槛限制了普及。商汤将8B小模型开源,并在信息图、连续创作等场景交出接近顶尖水平的答卷,意味着中小团队甚至个人开发者也能低成本获得“理解与生成统一”的能力。这可能会加速AI图像生成从“大厂玩具”向“通用工具”的演进,也让更多人有机会参与到创意生产中。当然,模型在人物细节、长文本渲染上的瑕疵仍需迭代,但开源生态的力量往往能带来意想不到的改进速度。接下来,值得关注的是U1能否像它的前辈一样,在社区中涌现出大量定制化应用。