5月6日,字节跳动旗下火山引擎正式宣布,豆包大模型家族迎来首个全模态理解模型——Doubao-Seed-2.0-lite。作为该系列的又一次重大迭代,新模型彻底打破单一模态的局限,实现了对视频、图像、音频与文本的原生统一理解。这标志着多模态交互在“感知融合”层面迈出了关键一步——不再只是“看懂”或“听懂”,而是让机器像人一样,把看、听、读、写整合成一个整体认知。

从技术指标看,Doubao-Seed-2.0-lite在视觉与逻辑推理能力上表现出色。在物理、医学等高阶学科复杂推理测试中,其成绩显著超越了今年2月发布的Pro版本。更值得关注的是,它在细粒度感知与具身理解等前沿维度已经达到行业顶尖水平。比如,通过融合语音理解技术,该模型能够实现“音画同步”的深度联合推理——不仅“看懂”视频中的人、物、动作,还能结合背景音频精准判断视频内容的一致性,甚至根据指令在长视频中精确定位特定事件,还原复杂的人物关系图谱。

音频处理方面,新模型展现了极高的翻译与感知精度。它支持中英文等19种语言的转写,以及14种语言之间的互译。除了准确的语义识别,模型还能敏锐捕捉语音中的情绪波动和环境音——比如一段采访视频中背景有雨声,模型可以判断出“说话人在下雨的街道上”,这种能力已经非常接近人类自然的听觉认知。

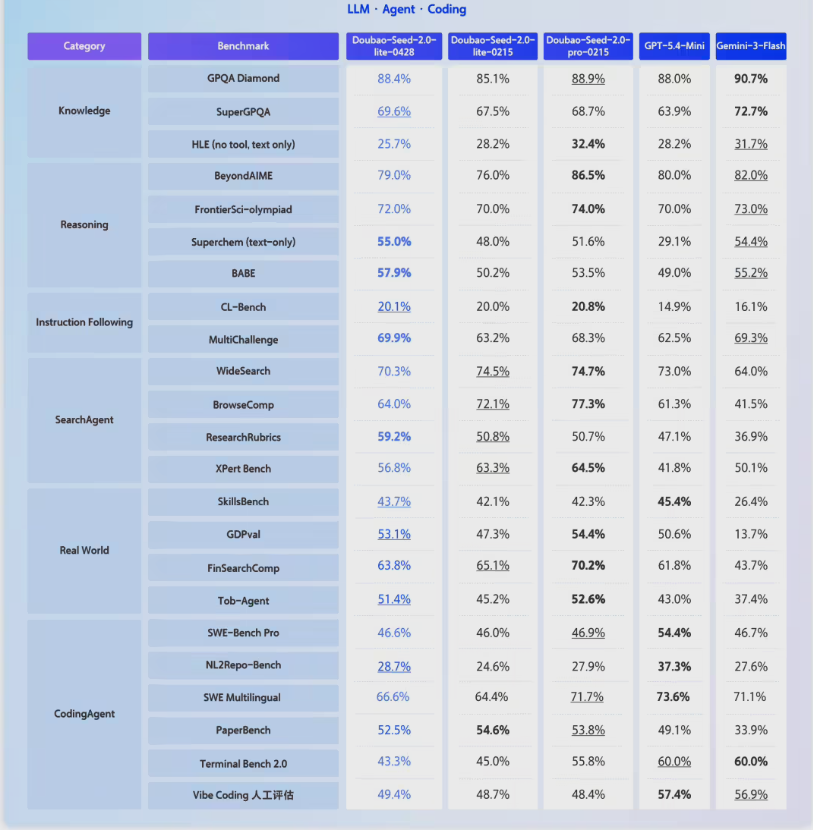

值得注意的是,Doubao-Seed-2.0-lite在Agent(智能体)与Coding(编程)能力上也同步升级。模型对多轮复杂指令的遵从性显著提升,具备更强的自我分解与验证能力——这意味着它不再简单地“执行命令”,而是能够拆解任务、自检结果,并在出错时主动修正。在开发领域,其代码能力已覆盖前端页面、3D场景与游戏开发,不仅能生成美观的界面,还能交付完整工程化的产品。

更令人眼前一亮的,是模型首次实现了GUI(图形用户界面)的集成理解与执行。它不仅能识别网页或应用中的按钮、菜单等元素,还能像人类一样执行点击、拖拽、输入等操作——真正达成了从“理解界面”到“端到端完成任务”的闭环。这意味着AI助理未来可以直接操作你的App,而不需要API适配,这对智能办公、自动化测试等场景会产生结构性的影响。

目前,这项技术已在电竞解说复盘、在线教育、跨境电商等多个领域落地。例如在电竞场景中,AI可以充当教练,连续分析长达25小时的比赛视频与语音,并自动生成战术复盘图。与此同时,更高效版本的Doubao-Seed-2.0-mini也已同步推出,为企业大规模部署低成本的全模态推理任务提供了更具性价比的选择。客观来看,全模态模型的商业化窗口正在打开,而豆包家族这次的“两步走”——先以lite版本验证能力天花板,再以mini版本压降单位成本——显示了一种务实的落地策略。