AI代理终于长出了“眼睛”和“手脚”,这可能是今年Mac自动化领域最值得关注的技术进展之一。长期以来,大语言模型在理解文本、生成代码方面表现出色,但一遇到图形界面操作就陷入“眼高手低”的窘境——能告诉你该怎么做,却无法亲自替你点击那个按钮。这不仅是技术限制,更是AI从“参谋”走向“执行”的关键瓶颈。Peter这次带来的Peekaboo v3版本,试图从根本上打破这种割裂。

友友们,小声问一句,OpenClaw更新还有人关注吗?

关不关注不重要了,重要的是给大家同步一下,龙虾刚刚长出手脚了!

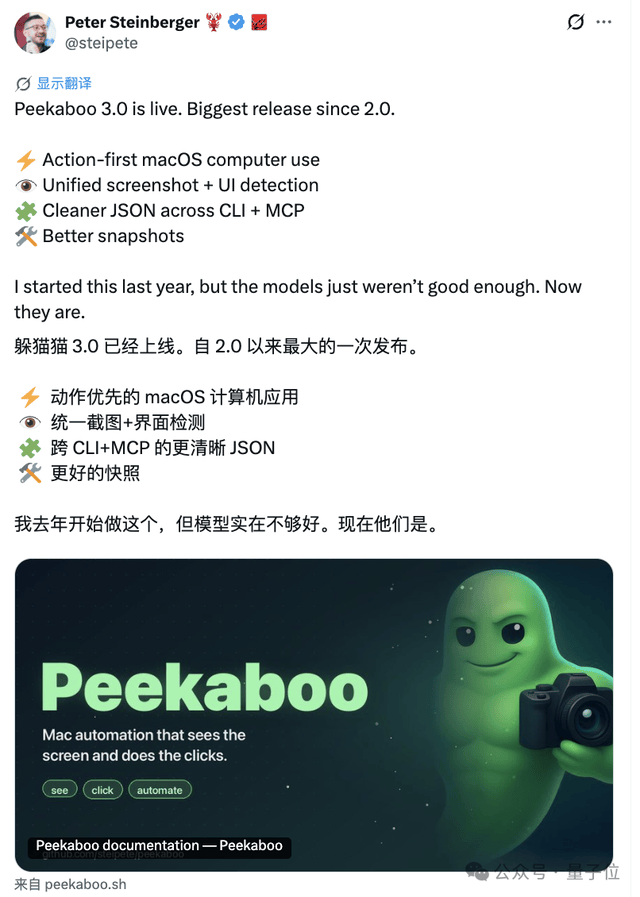

依旧是那个龙虾之父Peter,这次带来了全新的Computer Use工具Peekaboo v3版本——

直接把过去Agent类产品只能简单执行,但没法直接操控桌面的问题一把《梭哈》:

Peekaboo v3不仅能在MAC电脑上实现像素级截图,还能读取电脑上每个UI的位置。

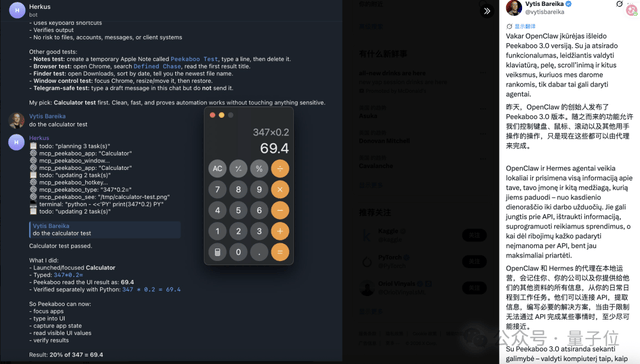

下面这位网友,直接就是让Peekaboo v3做了一个简单的「Computer Use」烟雾测试。

让Hermes操作计算器、Peekaboo读屏幕结果、Python独立验证答案是否正确,一气呵成成功通过。

兴致来了挡都挡不住,人家立刻立flag:

好玩好玩,下一步我还要让Peekaboo自动翻找以前写过的邮件!(尝鲜ing…

眼睛+手脚都齐了,现在这虾啊,是真的能在咱Mac上替我们打工了???

仔细想想,这种“屏幕理解+物理操作”的组合拳,其实是朝着更通用AI助手迈出的坚实一步。传统RPA(机器人流程自动化)工具虽然也能操作界面,但它们依赖固定规则和元素选择器,面对动态变化的UI往往束手无策。而Peekaboo v3的突破在于:它让AI通过视觉识别和理解界面,再通过模拟操作来执行任务,这本质上是在复现人类使用电脑的认知-动作闭环。

事实上,Peekaboo(翻译:躲猫猫)已经不是一个新产品了。

早在OpenClaw大火之前,去年11月份左右,Peter就动了给Agent装手脚的心思。

当时陆陆续续憋了v3.0.0-beta1到beta4好几个测试版,前后差不多磨了快半年的时间。

直到最近这两天,直接开启「狂更模式」

v3.1.0、v3.1.1、v3.1.2开始一个疯狂大更新……

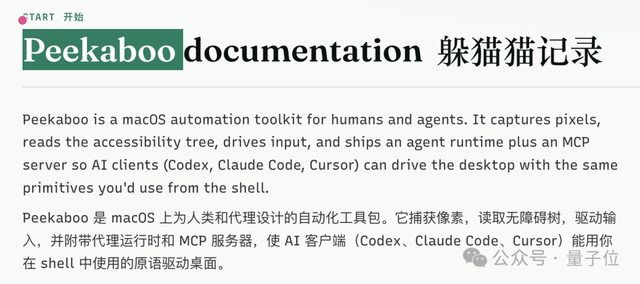

那问题来了,这个躲猫猫,Peekaboo到底是个啥东西呢?

一句话说就是:给你的Mac装一双带有眼睛和手的工具包,能让AI agent看到屏幕,也能操作鼠标键盘。(省流版)

大家之前如过有用过龙虾或者Agent产品,应该能感觉到一个bug点——

Agent确实能帮我们打开网页、跑个流程,可一旦涉及到屏幕上更细的操作,比如戳那个按钮、拖那个文件、把这段字敲到那个输入框里……

它就开始《装瞎》,最后那一步还得咱自己上手操刀。

看不下去的Peter清楚地知道,AI要想在Mac上动手,必须有一个能看屏幕、能操作鼠标键盘的工具,这恰好就是Peekaboo。

这次给Peekaboo v3做的事儿,就是把这道墙凿穿:

让Agent真的能看,也真的能动,从指手画脚的甲方,变成真的能下场干活的乙方。

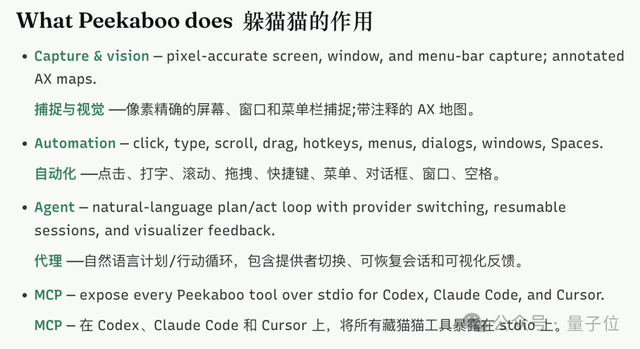

首先是「看」的能力。

Peekaboo v3不仅能实现像窗口、全屏、菜单栏的像素级截图、还能读取macOS上每个UI元素的位置、类型、label等,真·慧眼识珠屏幕了。

其实是「动」这事儿上。

一整套真人用Mac才会干的事,它现在自己就能干,真·能kuku上手干活儿了。

但是Agent光能看和动还不够,Peekaboo v3真正让人觉得开大的还在「下面」——

在能力调用上,其支持自然语言Agent模式,所以在提示词指令上我们可以直接用大白话甩任务就行。

第二个蛮实用也非常聪明的设计,就是能把所有能力打包成MCP,喂给你常用的AI工具。

例如我们在Cursor里写代码,跑起来UI出bug了,以前得自己截屏发给Cursor让它看。

但现在Cursor自己就能截图、自己看、自己改、自己再跑一遍验证,真·全程不用插手。

(躲猫猫这名字还是含蓄了,感觉堪称蜘蛛网了…一招鲜吃遍天N个产品了也是…)

从产业视角看,这种“工具化”的策略非常聪明。将屏幕理解和操作能力封装成MCP(Model Context Protocol)服务,意味着它不绑定任何特定AI模型或应用。无论是Claude Code、Cursor、还是未来的任何AI编程助手,只要支持MCP协议,就能获得这套“所见即所得”的桌面操作能力。这有点像给AI世界搭建了一个通用的“视觉-运动皮层”,让不同的大模型都能接入并执行GUI任务,而不是每个厂商都从头造轮子。

友友们非常关心的问题来了——那这Peekaboo v3到底咋用捏?

好消息是,Peekaboo为同一套能力,准备了四种不同的「打开方式」。

写代码的、用AI编程的、纯用Mac的、做App的,四拨人各取所需,丰俭由人啊丰俭由人~

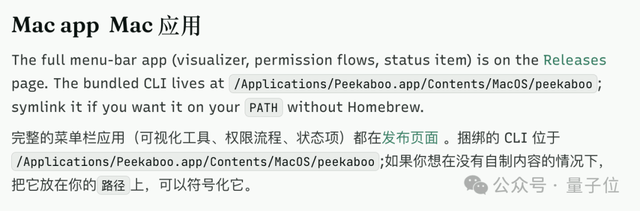

第一种,如果屏幕前的友友想写脚本自动化干活,直接用Homebrew安装方法就完事儿了~

brew install steipete/tap/peekaboo

peekaboo --version第二种,如果屏幕前的友友日常在用Claude Code、Cursor、Codex这类AI编程工具。

那这个最香,因为Peekaboo可以直接当成MCP server接进去:

npx -y @steipete/peekaboo mcp去GitHub Releases下载Mac桌面版app就行,有可视化反馈,权限管理也是图形界面,很友好。

对了,对于想在OpenClaw实用其能力的友友来说,直接「Skill」一下子就ok。

相当于给虾装了个操作Mac的插件,装好之后录屏、辅助功能这些Mac权限走OpenClaw一次性过,不用再单独给Peekaboo开一遍~

最后想说的是,Peter这波这么着急地狠狠更新一波,说实话也挺能理解……

这两年像Anthropic的Computer Use、OpenAI自家的Operator、各种browser-use工具全在卷「AI操作电脑」这条路子。

开源Agent领域热起来了,各种Computer Use替代方案开始疯狂冒头了。

他必须快啊,才能避免被后来者追上,也算是给自己在OpenAI的Agent工作提供个最强本地验证平台吧?

(这套「内外兼修」的打法好啊,妙啊)

总体来看,Peekaboo v3的发布时机和产品定位都相当精准。当前AI行业正从“文本对话”转向“行动执行”,谁能率先解决AI与真实数字世界的交互问题,谁就能在下一波应用浪潮中占据先机。Peekaboo v3选择深耕macOS这一确定性较高的平台,同时通过MCP协议保持与各类AI工具的兼容性,这种策略既务实又有扩展性。不过也要看到,这种基于像素截屏和UI元素读取的方案,在面对自定义控件、复杂渲染或不规范界面时,稳定性和准确率仍有待长期验证。对于追求极致自动化的极客用户来说,它已经足够让人兴奋;而对于企业级应用,可能还需要更多的边缘场景打磨。