近期,AI领域的一项重大进展来自于腾讯微信AI团队,他们公布了一个名为WeDLM(WeChat Diffusion Language Model)的新型扩散语言模型框架。这项工作的核心在于其创新性的设计思路,旨在突破当前主流大型语言模型(如GPT系列)在并行推理效率上的固有瓶颈,为文本生成提供一个更迅捷、更高效的解决方案。这预示着在追求模型性能的同时,计算效率将成为下一阶段技术竞争的焦点之一。

WeDLM巧妙地将扩散模型与经典的因果注意力机制融合,并通过一项独具匠心的拓扑重排序技术实现了这一点。这种集成的关键之处在于,它使得WeDLM能够兼容和利用KV Cache技术——这是困扰许多传统扩散模型(尤其是那些采用双向注意力设计的)在推理阶段速度提升的一大难题。通过这一方法,WeDLM不仅在速度上取得了显著的飞跃,同时也没有牺牲生成文本的质量,尤其在处理需要复杂逻辑推理的任务时,表现得尤为出色。

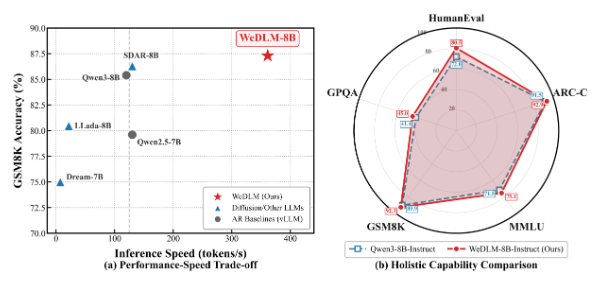

在实际性能评估中,WeDLM的速度优势得到了充分验证。例如,在数学推理基准测试GSM8K上,WeDLM-8B模型的推理速度比经过优化的自回归模型(例如Qwen3-8B)快了约三倍。而在一些对模型精度要求极高的低熵场景计数任务中,其速度提升幅度甚至超过了十倍。与此同时,在ARC、MMLU、Hellaswag等一系列广泛使用的基准测试中,WeDLM生成的质量与同级别的自回归基线模型相比,表现相当甚至有所超越。这充分证明了WeDLM在效率和准确性之间取得了完美的平衡,实现了“又快又好”。

WeDLM所展现出的高效推理能力,使其在众多实际应用场景中具有巨大的潜力,包括但不限于:需要快速响应的智能客服、提升开发效率的代码辅助生成,以及低延迟需求下的实时问答系统。随着WeDLM在各项实际应用中的部署和推广,可以预见它将有效降低AI服务所需的计算成本,显著提升用户体验,并进一步推动AI技术在更广泛领域内的落地和普及,加速AI普惠的进程。

更多技术细节,可访问其GitHub仓库:https://github.com/tencent/WeDLM

核心亮点速览:

– 🚀 引入拓扑重排序技术,WeDLM有效解决了传统模型在推理速度上的瓶颈,实现质的飞跃。

– 📊 在GSM8K等关键任务上,WeDLM-8B的速度表现远超优化后的自回归模型,效率提升显著。

– 💡 适用于智能客服、实时问答等多元场景,有望大幅削减运营成本,优化用户交互,赋能AI应用新纪元。