<!--摘要样式-->

<div class="zhaiyao"><p>准确率93.8%超越DeepSeek-V3.2</p>当业界目光仍聚焦于通用大模型的参数竞赛时,一个专注于特定场景的“小模型”却带来了超越预期的表现。这似乎预示着,AI在企业级落地进程中,“专用”与“高效”正成为比“全能”更受关注的关键词。

3月25日,硅心科技(aiXcoder)发布了一款专为「代码变更应用」场景设计的高性能、轻量级模型aiX-apply.

4B。

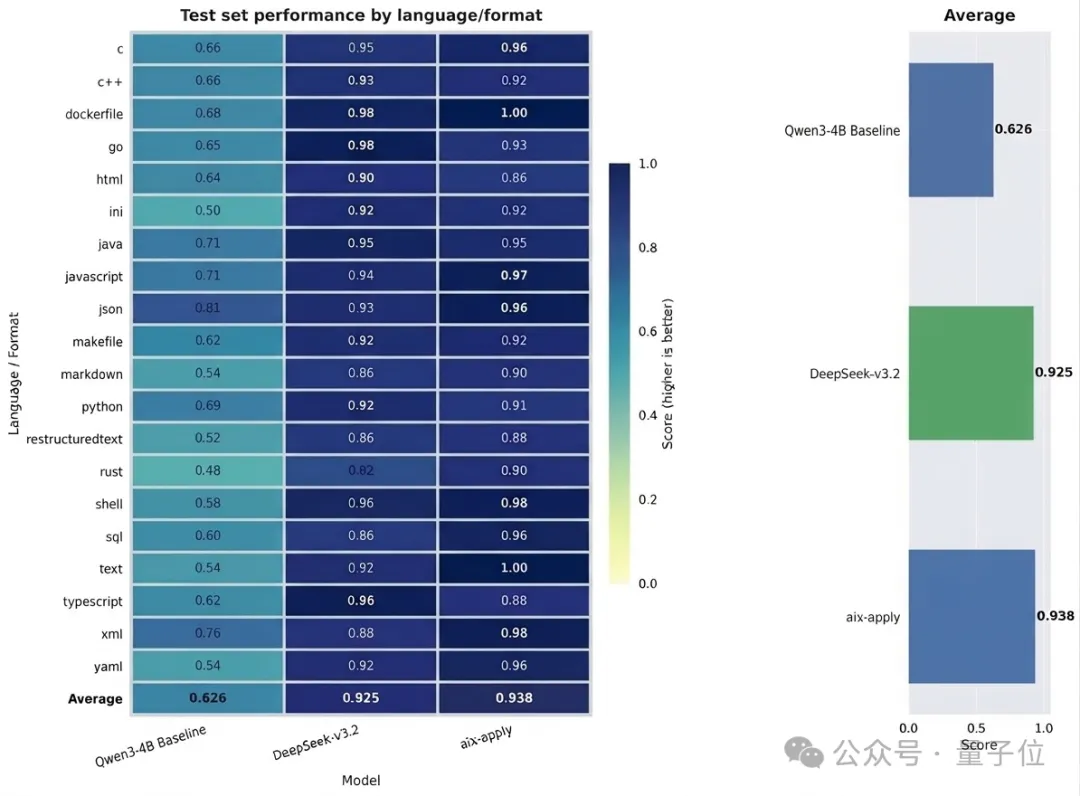

基准测试结果显示,在涵盖20多种主流编程语言及Markdown等多类型文件格式的测试中,aiX-apply-4B的平均准确率达到93.8%,不仅显著超越同级Qwen3-4B基座模型62.6%的准确度,甚至略高于千亿级通用大模型DeepSeek-V3.2的92.5%。

同一任务场景下,aiX-apply模型的算力成本约为DeepSeek-V3.2的5%,推理速度则提升15倍,仅需一张消费级显卡即可在企业部署。

这并非偶然。当前,企业AI应用正从早期的单点代码生成或问答,转向智能体(Agent)驱动的自动化工作流。一个复杂开发任务可能涉及多次模型调用与迭代,算力消耗呈指数级增长。

对于金融、通信、航天等强调数据安全与成本控制的企业而言,直接在私有化环境中部署并频繁调用千亿级大模型,无疑是沉重的负担。算力空转与高昂延迟,成为智能化转型的隐形瓶颈。

通用大模型固然在复杂逻辑与创意生成上优势明显,但其“通才”属性也意味着在特定高频、标准化任务上存在冗余。将宝贵的集群算力消耗在“将生成代码准确插入文件”这类具体执行动作上,性价比极低。

因此,为关键场景定制专用模型,实现算力资源的精细化管理,已成为工业界的新共识。 aiX-apply-4B的发布,正是这一趋势下的典型产物。

该模型瞄准的“代码变更应用”场景,技术要求极高:需将AI生成的(可能不规整的)代码片段,无损、精准、保持格式一致性地应用到既有源代码中,且不能影响上下文其他代码。这一过程犹如精密手术,传统正则匹配或简单规则引擎难以可靠应对。

△aiX-apply-4B模型架构

△aiX-apply-4B模型架构据悉,为保障模型效果贴合真实企业需求,团队基于大量真实代码提交记录构建训练数据集,并采用高性能强化学习框架进行训练,充分覆盖了各种边界情况。

测试结果表明,这一仅4B参数的小模型,通过针对性的训练方法,在专项任务上实现了对千亿级通用模型的“场景超越”。

在准确率方面,在覆盖20余种编程语言的1600余条测试集上,aiX-apply的93.8%准确率表现优异,与参数量是其数百倍的DeepSeek-V3.2(92.5%)处于同一水平线。

△基准测试对比

△基准测试对比在推理效率上,模型引入了自适应投机采样技术,显著压缩端到端延迟。

实测显示,aiX-apply-4B推理速度可达每秒2000 tokens,仅需单张消费级RTX 4090显卡;而对比的千亿级模型通常需要八卡H200集群。

综合硬件部署成本与推理速度,aiX-apply-4B以约5%的算力成本,实现了15倍的效率提升。

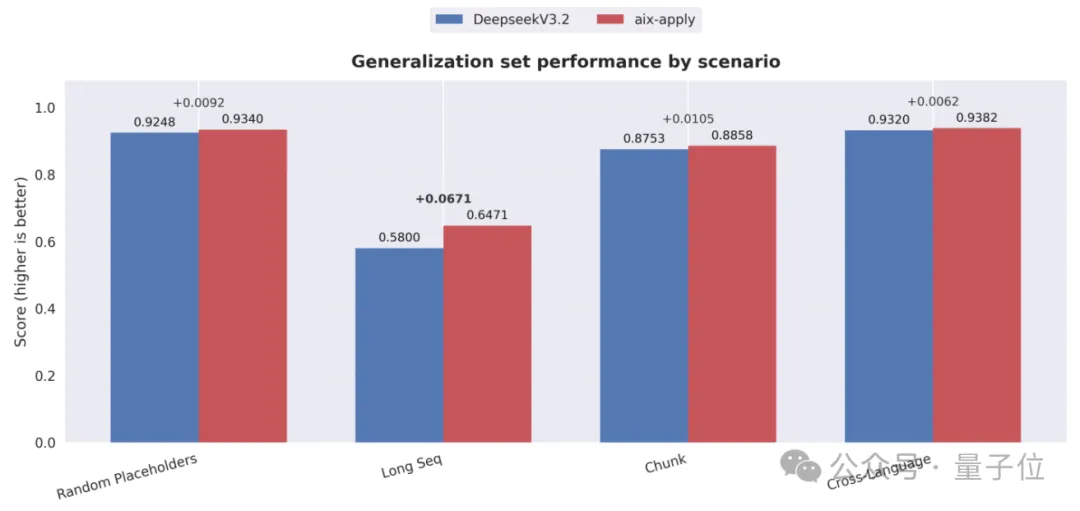

在泛化能力方面,该模型在处理超长代码文件或冷门编程语言时,也展现出稳定的性能,验证了其在复杂企业环境中的实用性。

△基准测试对比

△基准测试对比这并非aiXcoder首次针对具体研发场景定义模型。其技术路线清晰地体现了“场景定义模型”的理念。

此前,团队已推出专注于代码补全的7B模型。如今,他们已构建起覆盖多个研发环节的专用小模型矩阵,并提出“大模型+小模型”协同架构。

在这一架构中:“通才”大模型负责复杂意图理解、方案设计与逻辑分析;“专才”小模型则接管如代码补全、变更应用等高频率、高确定性任务,以极致效率执行。

- 通用大模型聚焦复杂意图理解、代码逻辑分析、修改方案制定等需要深度推理的工作,发挥其智能优势;

- 垂直场景小模型则承接高频工程任务,以轻量化特性实现快速、精准执行。

这种分工使企业有限的私有算力得以分层、高效利用。小模型以极低成本保障高频任务的流畅执行,从而为运行大模型的复杂推理任务节约出更多高端算力。

**其核心价值在于:让合适的模型做合适的事,最大化每一份算力投入的产出,这正是AI深入产业核心流程的必经之路。**随着多智能体协作成为主流,类似aiX-apply这样的垂直场景模型,或将成为企业构建高效、可控AI开发流水线的关键技术组件。

行业观察: aiX-apply-4B的出现,标志着代码大模型赛道从“能力展示”进入“工程优化”深水区。它揭示了一个现实:在商业环境中,单纯追求benchmarks上的全能冠军并非最优解。通过模型专业化、架构协同化来降低总拥有成本(TCO)、提升投资回报率(ROI),才是技术产品化的关键。未来,能否针对测试、运维、代码审查等更多细分场景推出“小而美”的解决方案,并实现与大模型的顺畅编排,将成为衡量一家AI代码公司技术深度与工程化能力的新标准。

<!--版权声明-->

</div>