视频生成技术正在跨越从“玩具”到“工具”的鸿沟。在这一进程中,如何解决生成内容的不可控性与后期编辑的复杂性,成为行业攻关的核心方向。业界普遍观察到,单纯的生成质量已不再是唯一壁垒,能否融入专业工作流才是落地的关键。

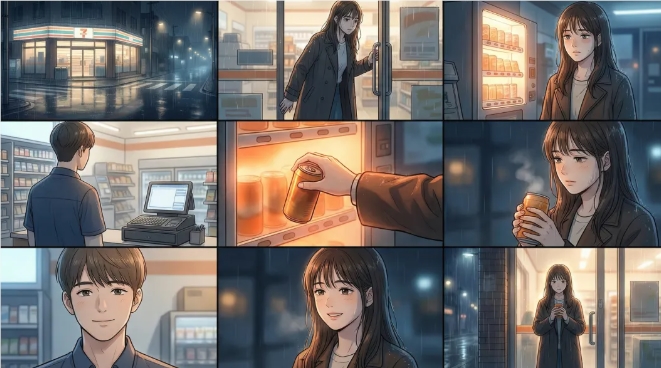

Tongyi Lab 近日推出了全新的视频创作工具 Wan2.7-Video,旨在进一步提升创作者的自由度与灵活性。针对当前 AI 视频创作领域普遍存在的两大痛点——生成内容专业性不足以及视频编辑难度大,Wan2.7-Video 提供了一系列强大功能,帮助用户轻松实现创作与编辑。

在内容生成层面,Wan2.7-Video 采用了更先进的模型架构,支持包括文本、图像、视频和音频在内的全模态输入。用户可以对场景结构、故事情节以及局部细节等方面进行精确控制。这意味着用户可以像编辑文档一样编辑视频内容,满足更高的创意需求。

该工具强大的编辑能力使得视频修改变得更为简单。用户只需通过简单的指令,即可精确调整视频中的元素,例如移除不必要的路人或替换视频中的物体。此外,用户还可以更改背景环境,轻松将夏季场景转换为秋季或冬季,甚至一键切换风格,为视频增添丰富的视觉效果。

在涉及视频剧情修改时,Wan2.7-Video 允许用户在不重新拍摄的情况下更改角色的对话、动作和镜头角度。用户可以根据需要灵活调整角色的表演和场景设置,极大地提高了创作的便利性。

此外,Wan2.7-Video 还具备快速复制创意和续写故事的功能。用户可以快速复用现有视频中的动作、镜头和特效,实现新的创意表达。通过精确的时间控制,用户可以实现视频的无缝过渡,增强故事的流畅性。

随着模型对时空一致性理解的加深,视频生成的工作流将迎来重构。这不仅降低了专业创作的门槛,也为人工智能在影视工业化流程中的深度整合提供了新的想象空间。纵观当前赛道,可控编辑能力正成为新的竞争焦点,通义实验室此次更新,无疑为影视后期、广告创作等领域提供了新的生产力工具。