具身智能(Embodied AI)正处于从“感知”向“认知”跨越的关键节点。当大模型不再局限于屏幕内的对话,而是需要驱动机械肢体在物理世界中作业时,空间推理能力便成为了决定落地成败的核心壁垒。

Google DeepMind 最新动作表明,他们正试图通过强化模型的空间理解能力,为机器人装上更为敏锐的“眼睛”与“大脑”。这一次,焦点落在了空间推理与真实场景的交互上。

Gemini Robotics 系列迎来主打空间推理的第三代模型升级。

Google DeepMind 正式发布了最新的机器人推理模型——Gemini Robotics-ER 1.6。

在演示场景中,搭载该模型的波士顿动力机器狗 Spot 展现出了以往罕见的精细操作能力:它能够自主走到工厂环境的压力表前,停稳,并准确读出表盘数字,精度甚至可辨识刻度以下的数值。

面对机械臂操作任务,新模型也能自主判断任务的启动时机与完成状态。

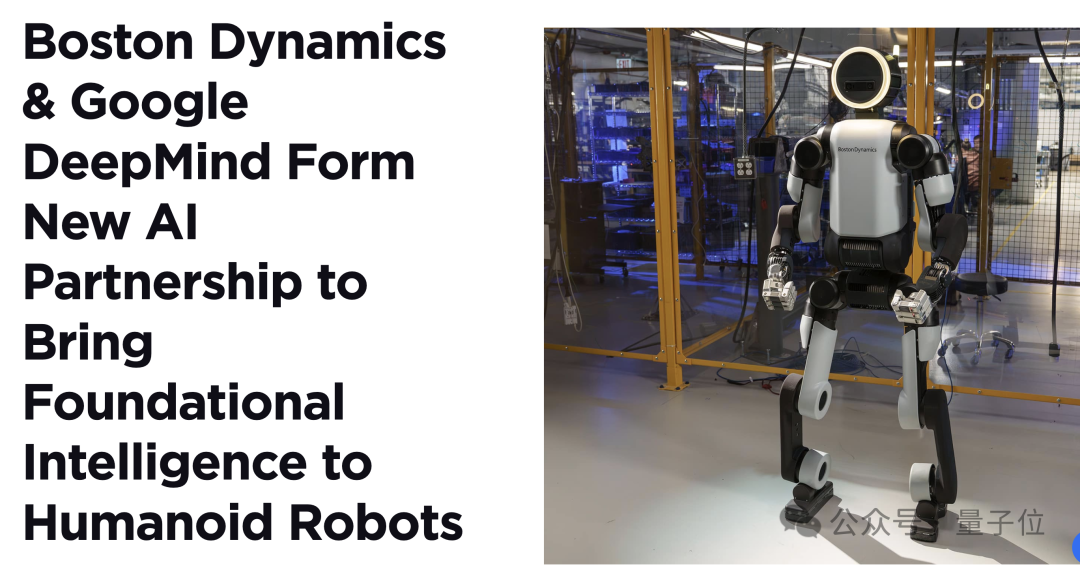

这标志着 Gemini Robotics 系列在空间推理方向的第三代迭代。值得注意的是,九年前谷歌将波士顿动力出售,而在今年 CES 上双方刚宣布重新达成合作,ER 1.6 便是这一战略合作重启后的首个正式技术成果。

DeepMind 负责人哈萨比斯也在第一时间对外分享了这一进展。

ER 1.6 的定位清晰:作为机器人的高层大脑。它不直接底层的机械动作控制,而是专注于理解环境、制定计划以及调用工具。

无论是谷歌搜索、VLA(视觉 – 语言 – 动作)模型,还是开发者自定义的函数,均可被直接调用。

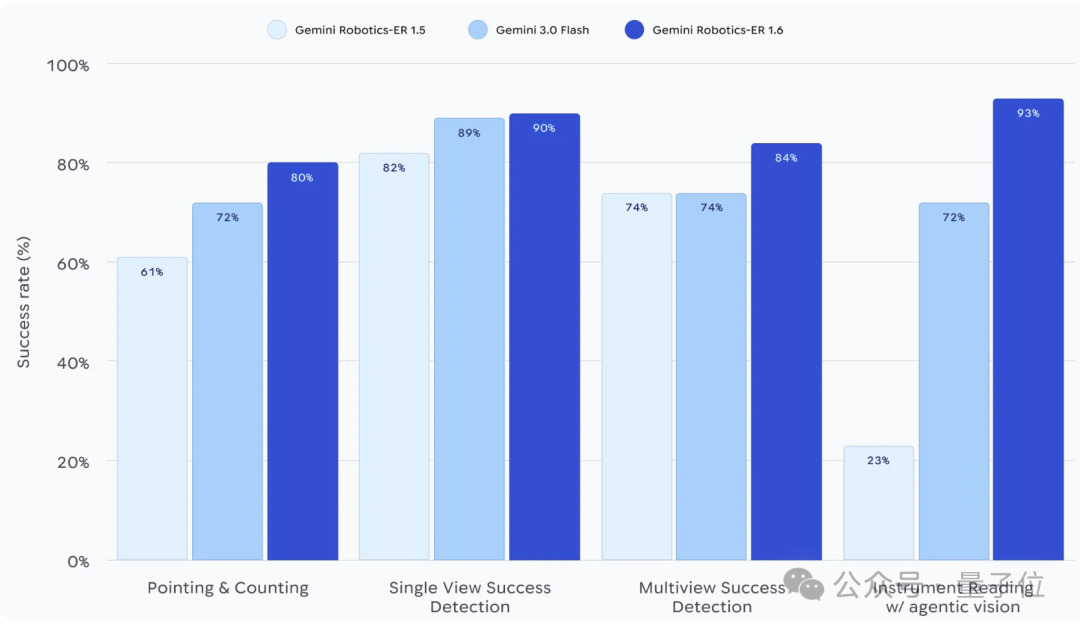

相较于上一代 ER 1.5 及 Gemini 3.0 Flash,新模型在空间推理、物体计数以及任务成功检测等维度均有显著提升。此外,还新增了一项关键能力:读取仪表。

在官方技术博客中,作者 Laura Graesser 和 Peng Xu 开篇即指出:

机器人若要真正具备实用性,就必须超越单纯的指令执行,进而实现对物理世界的推理。

ER 1.6 的核心升级逻辑围绕一点展开:让机器人真正「看懂」其所处的环境。

以 Spot 在工厂的演示为例。工业设施中存在大量需要持续监控的仪器,如温度计、压力表及化学视镜。以往,Spot 虽能走近拍摄,却无法理解图像中的数字含义。

ER 1.6 改变了这一现状。

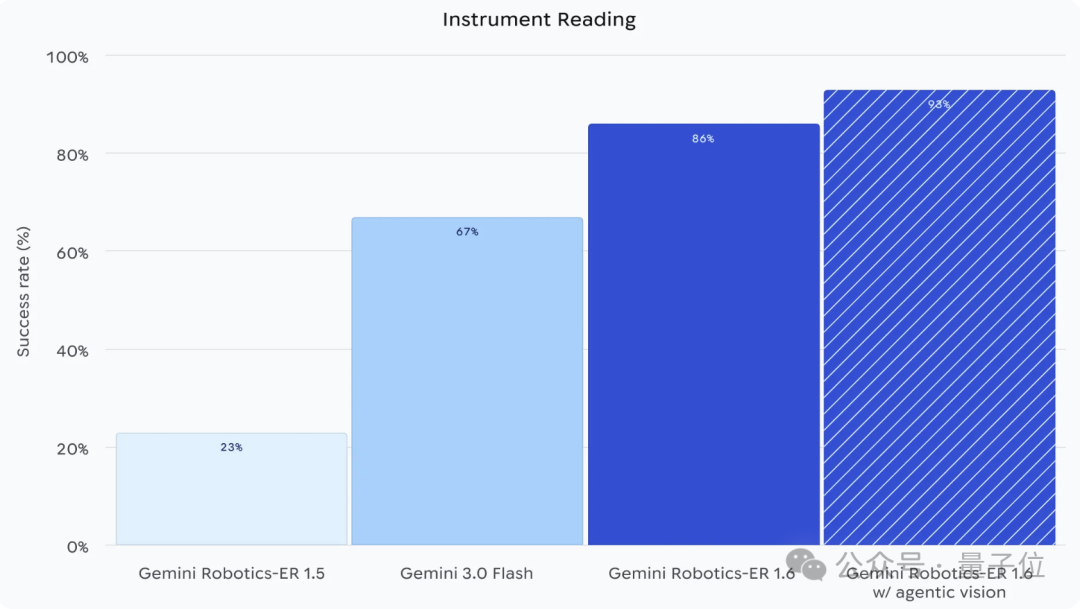

模型读取仪表的过程分为三步:首先放大图像以看清微小刻度;其次利用 Pointing 能力定位指针与刻度,结合代码计算比例;最后调用世界知识,将数字解释为具有物理意义的读数。

这套组合拳效果显著。数据显示,ER 1.5 的仪表识别成功率仅为 23%,而引入 Agentic Vision 后的 ER 1.6 达到了93%。

波士顿动力 Spot 副总裁Marco da Silva评价道:

仪表识别等能力和更可靠的任务推理,将使 Spot 能够完全自主地观察、理解并应对现实世界的挑战。

仪表识别能力的突破,背后依托的是Pointing能力的支撑。

Pointing 是 ER 模型从初代便开始训练的基本功。其核心在于让模型用「点」来表达对空间的理解:物体在哪里、数量多少、如何移动以及最佳抓取位置。

ER 1.5 在此任务上表现尚不稳定:面对工具图,它曾数错锤子数量,遗漏剪刀,甚至幻觉出不存在的手推车。

ER 1.6 则能准确无误地回答:锤子 2 把、剪刀 1 把、画笔 1 支、钳子 6 把。更关键的是,对于图中不存在的事物,模型学会了不去错误指向。

ER 1.6 的另一项升级在于成功检测。

知晓任务何时结束,与知晓如何开始,同样是自主性的核心要素。

传统系统往往做完一个动作即判定结束。但在真实场景中,遮挡、光线变化及模糊指令使得「做完了」这一状态本身就需要复杂判断。

ER 1.6 强化了多视角推理能力。机器人通常配备多个摄像头(如头顶、手腕),系统需将这些视角合并为连贯的判断。

例如演示中的任务:把蓝色笔放进黑色笔筒,任务完成了吗?

ER 1.6 能基于多角度画面,给出可靠的答案。

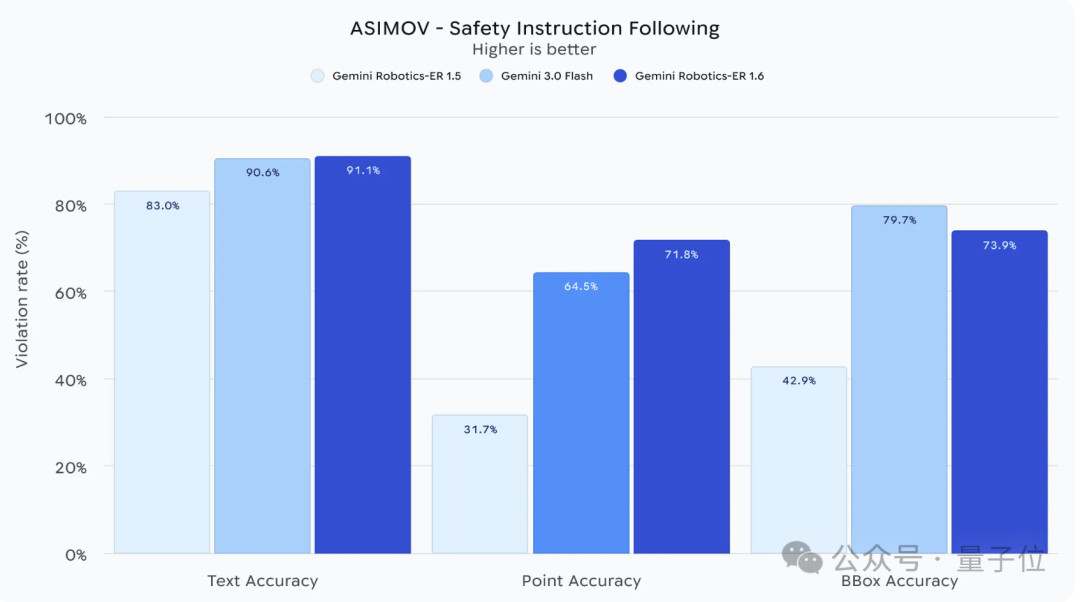

值得一提的是,这也是谷歌迄今最安全的机器人模型。

在对抗性空间推理任务中,ER 1.6 对安全指令的遵循程度优于所有前代版本。

对于不处理液体、不搬运超过 20 公斤物体等物理安全约束,ER 1.6 能通过 Pointing 等空间输出做出更准确的判断。

在基于真实伤害报告的安全隐患识别测试里,ER 系列比 Gemini 3.0 Flash 高出 6%(文字场景)和 10%(视频场景)。

外界可能会好奇,为何谷歌选择用波士顿动力的狗来展示模型能力?

这背后是一段漫长的分合故事。

谷歌 2013 年收购波士顿动力,2017 年卖给软银,当时理由是看不到商业闭环。

2020 年现代汽车以 8.8 亿美元接盘。随后在 2025 年 11 月,波士顿动力的前 CTO Aaron Saunders 离职,加入谷歌 DeepMind。

2026 年 1 月 CES 期间,两家在现代汽车的发布会上宣布正式合作,目标是将 Gemini Robotics 部署到 Atlas 人形机器人上。

出售九年,如今又以另一种形式回归。

哈萨比斯的战略意图明确:谷歌不做硬件,而是要成为「机器人领域的 Android」,为所有机器人厂商提供大脑。

此次 ER 1.6 发布,署名为两位作者:Laura Graesser和Peng Xu。

Laura Graesser拥有牛津本科、NYU 硕士背景,2018 年加入 Google,2023 年至今在 DeepMind 从事机器人研究,还合著过强化学习教科书《Foundations of Deep Reinforcement Learning》。

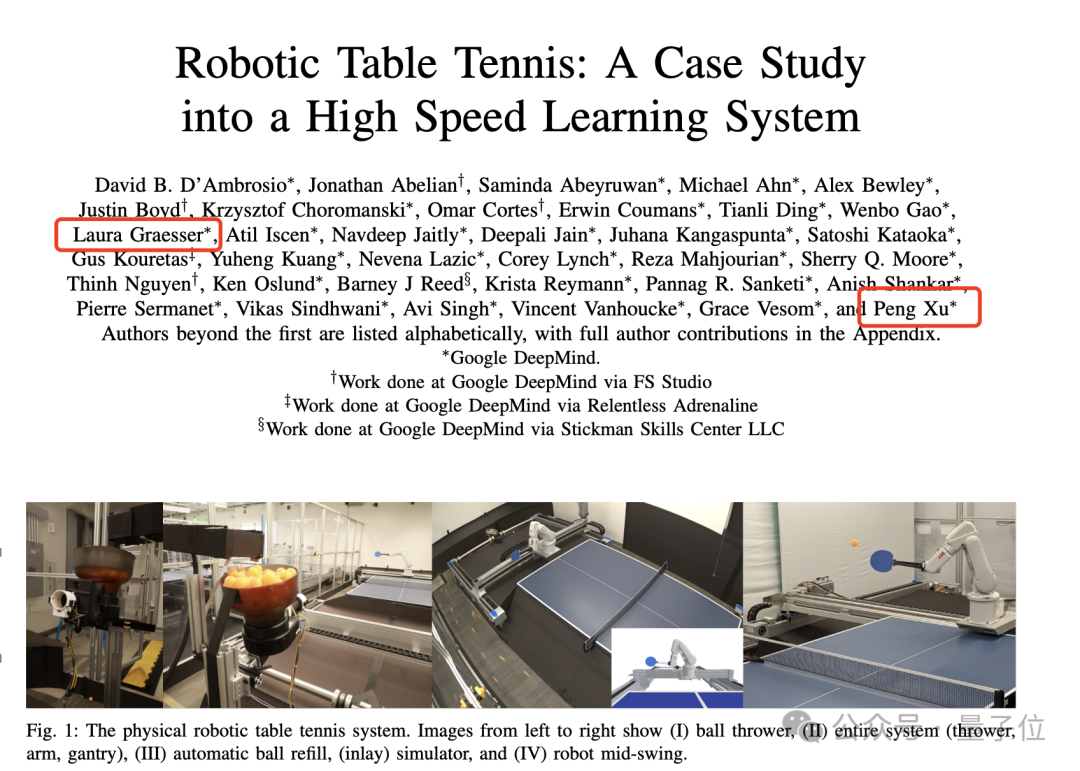

她早期的研究方向之一,是让机器人打乒乓球,系统需要在 100 毫秒内完成感知、计算和击球动作。

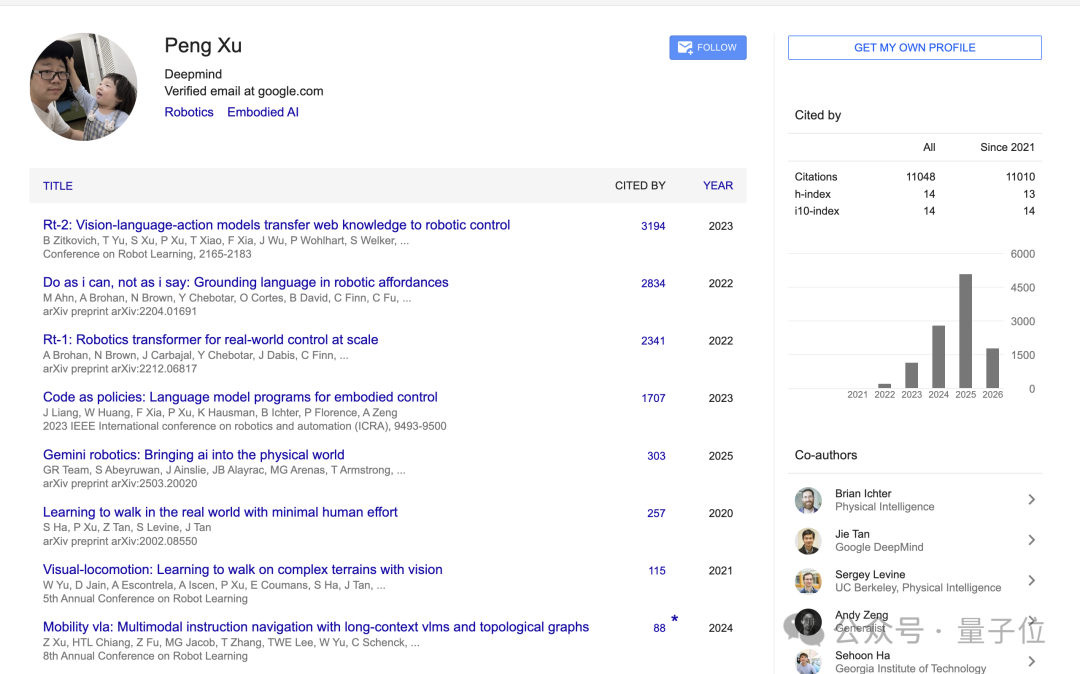

Peng Xu是 DeepMind 机器人基础模型方向的研究员,专注机器人学习与大模型的结合,不仅参与过上面的机器人打乒乓球项目,也是 RT-1、RT-2、Cap(Code as policy)、Gemini robotics 等一系列著名工作的作者之一。

从行业视角观察,谷歌此举意在构建通用的机器人操作系统生态。通过强化模型的空间推理与安全性,降低开发商的准入门槛,这与当年 Android 开放授权策略异曲同工。

然而,具身智能的落地仍面临硬件成本、场景碎片化及长尾问题等挑战。谷歌与波士顿动力的再度联手,虽展示了软件定义硬件的潜力,但能否在特斯拉 Optimus 等竞争对手之前建立起广泛的开发者生态,仍是后续观察的重点。空间推理能力的提升只是第一步,如何让机器人在非结构化环境中持续、稳定地创造价值,才是检验「机器人安卓」成色的关键。