大模型领域的开源与闭源之争正在进入新的阶段。随着技术迭代的加速,开源模型在性能上逼近顶级闭源模型已成为行业趋势,而此次发布的产品更是将这一竞争推向了高潮,标志着开源生态在通用能力上的又一次重要突破。

北京时间 4 月 24 日,DeepSeek 正式发布其新一代大模型 DeepSeek-V4。其整体性能已达到与当前顶级闭源模型相当的水平,成为开源 AI 领域的又一款里程碑式产品。

超长 100 万 token 上下文窗口

DeepSeek-V4 支持高达 100 万 token 的超长上下文,为复杂长文档分析、超长代码生成及多轮 Agent 任务提供了坚实基础。

双版本策略,灵活适配不同场景

新模型提供两个版本:

- DeepSeek-V4-Flash:轻量高效版本,适用于快速迭代和日常开发

- DeepSeek-V4-Pro:高性能旗舰版本,专为极端需求场景定制

数学、STEM 及竞赛代码全面卓越

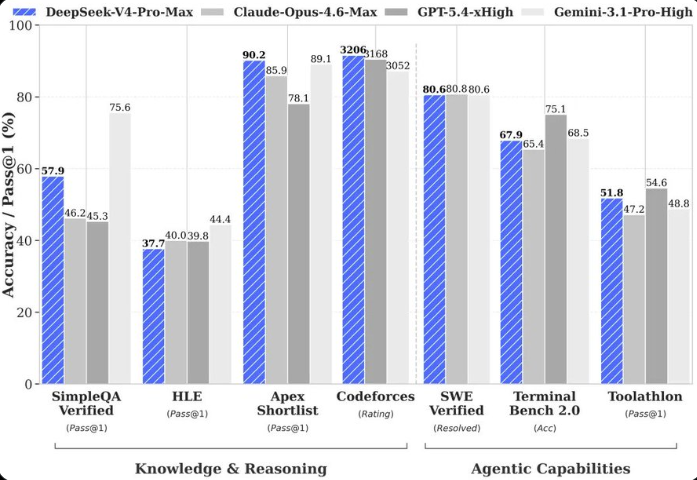

在数学、STEM 及竞赛代码评估中,DeepSeek-V4-Pro 超越了所有当前公开评估的开源模型,展现出压倒性的实力。

Agent 能力显著提升,开源领域达到新高度

DeepSeek-V4-Pro 的 Agent 能力得到显著增强。在 Agentic Coding 专项评估中,达到了当前开源模型的最佳水平,并在多项 Agent 相关评估中表现优异,为复杂自主任务的实施铺平了道路。

世界知识储备领先,仅次于顶级闭源模型

在世界知识评估中,DeepSeek-V4-Pro 大幅优于其他开源模型,仅略微落后于顶级闭源模型 Gemini-Pro-3.1,在知识广度和深度上实现了质的飞跃。

定价粉碎市场,100 万 token 成本降至冰点

DeepSeek-V4 延续了该系列一贯的极高性价比策略:

- 输入:Flash 版本 100 万 token 成本 1 元,Pro 版本为 12 元

- 输出:Flash 版本 100 万 token 成本 2 元,Pro 版本为 24 元

这一定价策略再次打破了行业边界,将顶级模型的能力带到了普通开发者和中小企业手中。

我们将持续跟踪 DeepSeek-V4 的实际应用表现及社区反馈,敬请关注后续的深度评估报告。

此举无疑将对整个 AI 应用生态产生深远影响。极低的调用成本有望激发更多开发者的创新活力,推动大模型从技术演示走向规模化落地。但模型在实际生产环境中的稳定性、长上下文的有效利用率以及生态工具的完善程度,仍是后续需要重点验证的指标。未来,开源模型如何在性能与成本之间找到可持续的平衡点,值得行业持续观察。