近日,OpenAI 发布了新一代图像生成模型 ChatGPT Images 2.0。仅仅一天之后,互联网上便出现了翻天覆地的变化。

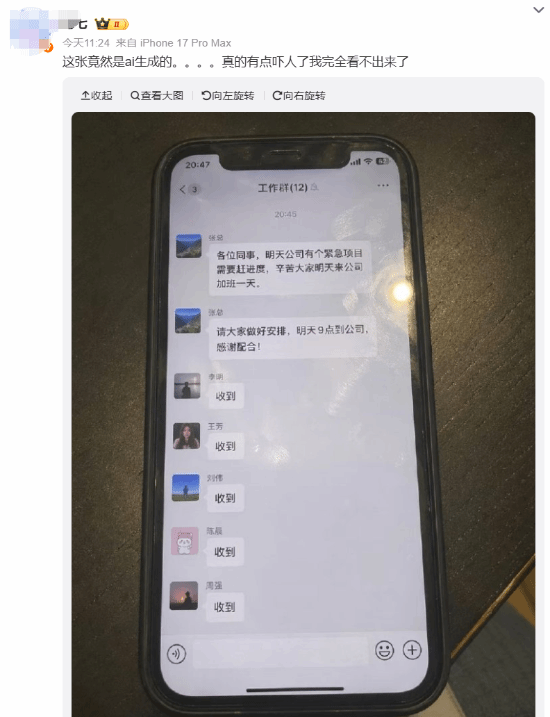

“库克入职小米汽车”“罗永浩收购苹果”“贾跃亭回国”——这些看起来像模像样的“官方公告”在社交平台上迅速传播,无数用户纷纷转发。小米高管紧急辟谣:“乱P图不可取”。不少网友表示:“我真的以为库克加入了小米汽车。”“现在看什么都觉得是AI生成的,连‘惊讶’的能力都快丧失了。”

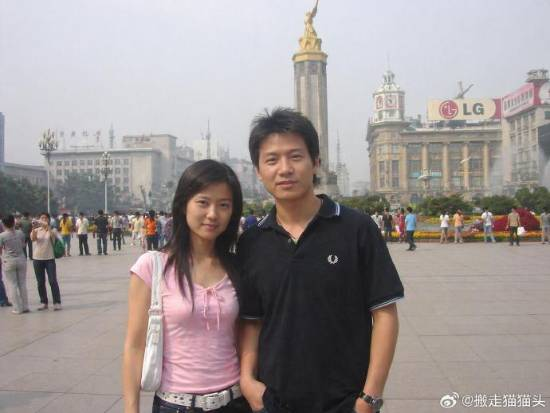

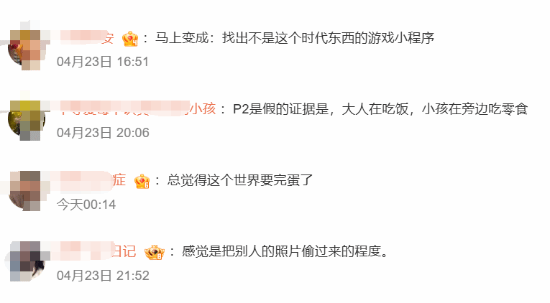

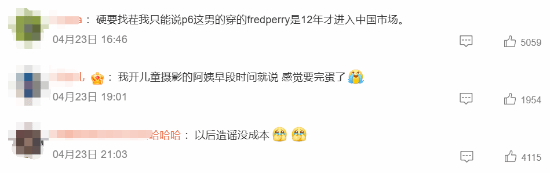

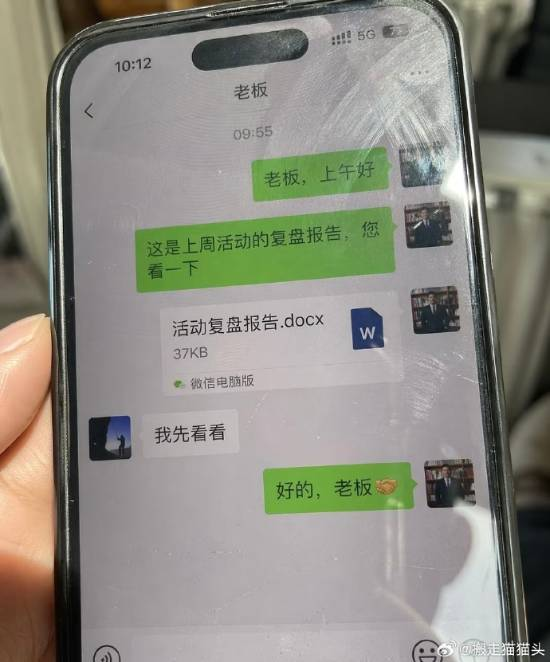

AI 生图技术已经突破了肉眼鉴别的边界。从生活场景中油渍反光的精准模拟,到专业试卷上复杂公式的排版,AI 生成的图片在细节、质感和逻辑性上几乎与实拍照片毫无二致。这一进步彻底颠覆了“有图有真相”的传统认知。客观来看,模型的进步速度远超预期:仅仅一年前,AI 生成的图像还经常出现手指畸形、文字乱码等问题,而如今 Images 2.0 已经能输出包含清晰且准确文字的界面截图,甚至连直播间评论区中网友的语气都模仿得惟妙惟肖。

这些图的生成门槛低到离谱。据实测,用户只需一句简单的描述,Images 2.0 便能在数秒内生成带有精准文字、逼真 UI 界面的截图。更令人惊讶的是,模型甚至能根据上下文生成符合场景的评论内容,例如在模拟直播间时自动生成语气贴切的网友留言。这种能力的背后是模型对文字与图像语义的深度理解,已经不再只是简单的像素合成。

更让人感到不安的是,这并不仅仅是网友之间的玩梗。有用户利用 AI 伪造了“西山居解散”的企业公告,细节极为逼真,直接引发了资本市场的波动;还有人伪造了“流浪汉闯进家门”的图片,导致整栋楼居民恐慌。当造假的成本趋近于零,伦理底线便容易被轻易践踏。从社会层面来看,这要求平台、监管和技术开发者共同构建更有效的鉴别机制,比如推广数字水印技术、加强溯源能力以及提升公众的媒介素养。

“当 AI 能生成以假乱真的假图时,会刺激更多人主动去造假玩。”“以前我们默认截图就是真的,现在这个底层的假设已经崩塌了。”有评论这样写道。网友的灵魂发问直击要害:“你告诉我什么是真的!”从技术发展的角度分析,这种信任危机并非第一次出现——从早期 PS 修图到深度伪造视频,每一次技术进步都在重塑真实与虚拟的边界。但 Images 2.0 的突破在于,它让造假变得极其简单且隐蔽,普通人几乎无法用肉眼辨别。

当“有图有真相”成为历史,我们正集体进入一个更加扑朔迷离的信息时代。未来,如何在海量内容中甄别真假、如何重建公众对信息的信任,将是整个社会必须面对的课题。而技术本身既可以是造假的工具,也可以是打假的利器——关键在于我们如何选择应用与监管的方向。