随着多模态大模型技术持续迭代,端到端全双工交互正成为下一阶段的核心竞争方向。面壁智能联合OpenBMB开源社区、清华大学THUNLP实验室和THUMAI实验室,正式公开其全双工全模态交互的核心技术——Omni-Flow 流式全模态框架,并同期发布MiniCPM-o 4.5技术报告。

过往大模型多为半双工交互,类似对讲机的回合制对话。用户与AI无法并行交流,AI无法实时感知环境、不能被打断,交互存在明显割裂。MiniCPM-o 4.5是面壁智能今年2月发布的全双工全模态模型,也是业界首个端到端全双工全模态大模型。该模型参数规模约9B,支持视频、音频、文本流输入及文本与语音的连续输出。

无需联网、仅用一张消费级显卡,便可在个人电脑上获得一个“边看、边听、边说、还能主动提醒”的类人AI助手。目前MiniCPM-o 4.5已基于llama.cpp完成模型量化和推理性能优化,实测最低12GB显存的RTX 5070即可流畅运行全双工模式(RTF 0.4),极大降低个人端侧部署门槛。M1-M5 Max(含M5 Pro)的Mac设备也可使用,建议内存超过16GB。模型发布至今,在Hugging Face的下载量已突破25万。

技术报告公开之外,MiniCPM-o 4.5同步推出在线体验Demo、全模态全双工API、端侧安装包Comni和Demo仓库,形成了从研究到落地的完整链路。

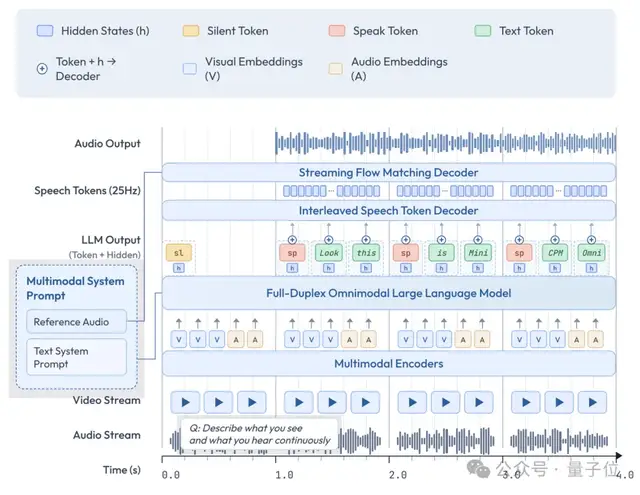

MiniCPM-o 4.5极致流畅的全双工交互体验,核心依托于面壁智能与清华大学联合研发的Omni-Flow流式全模态框架。这一框架打破了传统模型孤立的回合式交互逻辑,搭建了毫秒级统一时间轴。通过时分复用机制,Omni-Flow将视觉、音频、文本等多模态并行信息流精准对齐、拆分重组为周期性时序信息组。模型以每秒一次的高频持续刷新环境认知,实时更新对场景和用户意图的理解,全程无需外部VAD语音活动检测工具,原生支持持续感知、即时响应、自由打断。

从架构设计来看,Omni-Flow实现了真正的“感知即理解”,这在整个开源社区中十分罕见。

在模型架构上,MiniCPM-o 4.5采用轻量化端到端全模态设计,整体仅9B参数,由四大核心模块协同构成:

- 0.4B参数SigLIP-ViT视觉编码器负责环境视觉感知;

- 0.3B参数Whisper-Medium音频编码器完成声音信息采集;

- 8B参数Qwen3-8B LLM基座承担核心思考与语义理解;

- 搭配0.3B参数轻量级语音Token解码器实现语音生成。

模块化分工设计各司其职、高效联动,既保留了大模型强大的理解推理能力,又规避了复杂声学任务对核心算力的损耗。同时搭配自研TAIL时间对齐交错语音生成方案,精准匹配文本与语音输出节奏,在保证语音流畅自然、情感饱满的前提下最大限度降低交互延迟。这一组合方案解决了流式对话中常见的卡顿、滞后、衔接生硬等行业难题。

参数不大,但多项权威评测基准中MiniCPM-o 4.5实现了越级对标,综合性能比肩甚至超越多款行业前沿大模型。

在视觉能力上,模型OpenCompass综合得分77.6、MMBench英文得分87.6,整体表现对标Gemini 2.5 Flash,图像理解、数学推理、文档解析能力表现优异。

在全模态动态交互与视频场景理解领域,MiniCPM-o 4.5优势更为突出。Daily-Omni、Video-Holmes等多项评测数据显示,MiniCPM-o 4.5优于Gemini 2.5 Flash等大模型。在LiveSports-3K-CC全双工视频基准测试中,胜率达到54.4%,领先各类专用流式视频模型。

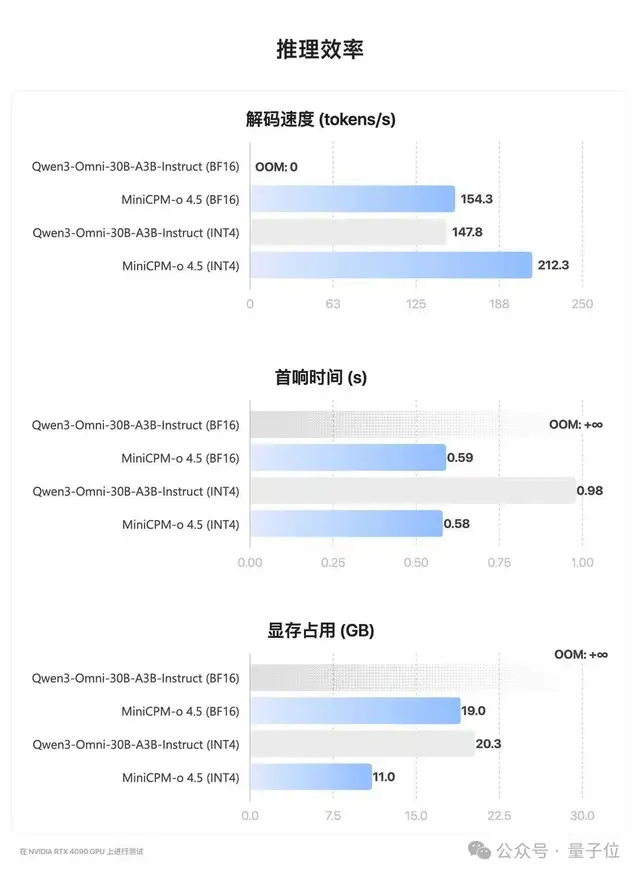

推理效率优势同样显著。INT4量化版本显存占用大幅降低,仅需12GB显存即可运行,解码速度可达212 tokens/s,相较同类模型提速40%以上,响应延迟更低。

此外,模型搭载多项实用特色功能,适配多元化使用场景。MiniCPM-o 4.5全面支持中英双语实时语音对话,语音生成质量行业领先,中文CER、英文WER错误率低于CosyVoice2等主流模型,情感表现力更强。支持简易参考音频即可完成声音克隆与角色扮演,音色自然逼真。延续MiniCPM-V系列优势,拥有前沿的OCR文档解析能力,支持高清图像、高帧率视频处理,多语言解析能力覆盖30余种语言。同时模型原生兼容传统轮次对话和Omni-Flow全双工流式交互两种模式,无缝切换,兼顾精准问答与实时流式交互需求。

为了让技术真正落地普惠,MiniCPM-o 4.5打造了全渠道的开放落地体系,兼顾普通用户体验与开发者二次开发需求。

面向普通用户,官方开放无需注册、无需下载的在线体验Demo,同时推出适配Windows、macOS系统的桌面端Comni一键安装包,简化部署流程。面向广大开发者,平台免费开放全双工实时WebSocket API,提供完整规范的接口文档,并完整开源Demo前后端代码,开放Linux部署方案,支持自由二次开发与自定义调试。

依托原生全双工、持续感知、主动交互的核心能力,MiniCPM-o 4.5突破了传统AI单次问答的场景局限,解锁了大量全新流式交互应用场景。

- 生活服务领域:可作为沉浸式智能陪伴助手,在用户运动、烹饪、日常劳作时实时答疑、主动提醒、全程指导。

- 无障碍公益领域:为视障人群提供实时环境感知服务,主动播报路况、设备状态、环境变化。

- 智能车载领域:持续监测路况与驾驶员状态,主动预警风险、提示可用车位、辅助泊车。

- 具身智能领域:作为机器人核心大脑,持续感知动态环境、自主决策交互时机,覆盖生活化、公益化、工业级多维度需求。

可以说,MiniCPM-o 4.5把“主动式AI”从概念变成了可以在个人电脑上跑起来的具体产品。团队也在技术报告中坦诚指出了当前不足:长时间交互的稳定性、主动行为的丰富性、对复杂场景的鲁棒性仍有提升空间。但这不妨碍它已经立起了一个新的起点——全双工全模态、端侧可部署、全栈开源,这条路线已经跑通。

目前MiniCPM-o 4.5在线体验、API、端侧安装包、Demo代码仓库均已上线,感兴趣的朋友可直接体验。

技术报告PDF:

在线体验:

在线体验(手机端推荐):mobile/

GitHub Demo(含本地安装包):

Hugging Face:

ModelScope: