具身智能正站在一个十字路口:一边是资本催熟的千台部署承诺,一边是真实世界中令人沮丧的数据利用率。两万小时的机器人数据,有效部分可能不足三千小时——这个数字暴露了行业在“堆数据”上的盲目性。当行业从仿真转移到真机,物理规律的差异、本体的迁移壁垒,以及一场看不到尽头的数据马拉松,让所有参与者都陷入了集体焦虑。

在这场由蚂蚁灵波与乐聚机器人等机构联合发起的闭门沙龙中,近两百位一线从业者被拉进同一个屋子,围绕一个核心命题反复撕扯:具身智能如何真正从实验室走进物理世界?

做具身别着急“堆数据”,先想透这些问题

编辑部 发自 北京

2026年,具身智能的关注点已经从硬件本体转移到了数据与模型。融资新闻里动辄千台部署的豪言,与研究者发现数据有效利用率极低的现实,形成了刺眼的反差。沙龙上各方观点交锋激烈,几个共识与分歧同时浮现:

关于数据采集:大规模数据采集最难的是认知对齐——让每一个数采员真正理解算法团队想要什么,这件事比写质检规范难得多。

关于模型训练:为了趟清楚预训练这条路到底有多少坑,团队选择用2万小时真机数据做预训练,结果发现Scaling Law的迹象还远未到来。

关于数据评测:基准低分未必代表好,但起步就拿高分肯定不行。要是刚发布大家都能冲上80分,那这个基准就废了。

关于训练效率:一个人每天与物理世界交互10小时、持续10年,累计才约3万小时,而一个10岁孩子用这些数据已经能完成海量复杂任务——这组对比揭示了一个尴尬事实:当前具身范式对数据的利用率太低。

以下为整理的沙龙实录。

乐聚机器人具身智能算法工程师以《数据驱动具身智能:从数据生态到多场景落地》为题,系统梳理了具身数据面临的产业挑战与乐聚的应对策略。

他指出,制约机器人产业规模化落地的核心障碍,已从硬件和底层运控算法转移至具身智能模型,也就是具身大脑的欠缺。

然而,与文本和视觉数据不同,具身智能数据在供给侧仍存在多重瓶颈:其一是难以获得,往往依赖真机采集,需人工参与,成本高、效率低;其二是跨本体与多模态复杂,数据包含视觉、位姿、力反馈等多维信息,格式复杂,难以跨本体复用;其三是流转效率低:数据采集、处理与训练链路割裂,缺乏统一标准与规模化生产能力。

他强调,要在具身智能领域复现LLM的成功路径,数据规模至少需达到Scaling Law起效的门槛,而这一目标目前仍相距甚远。

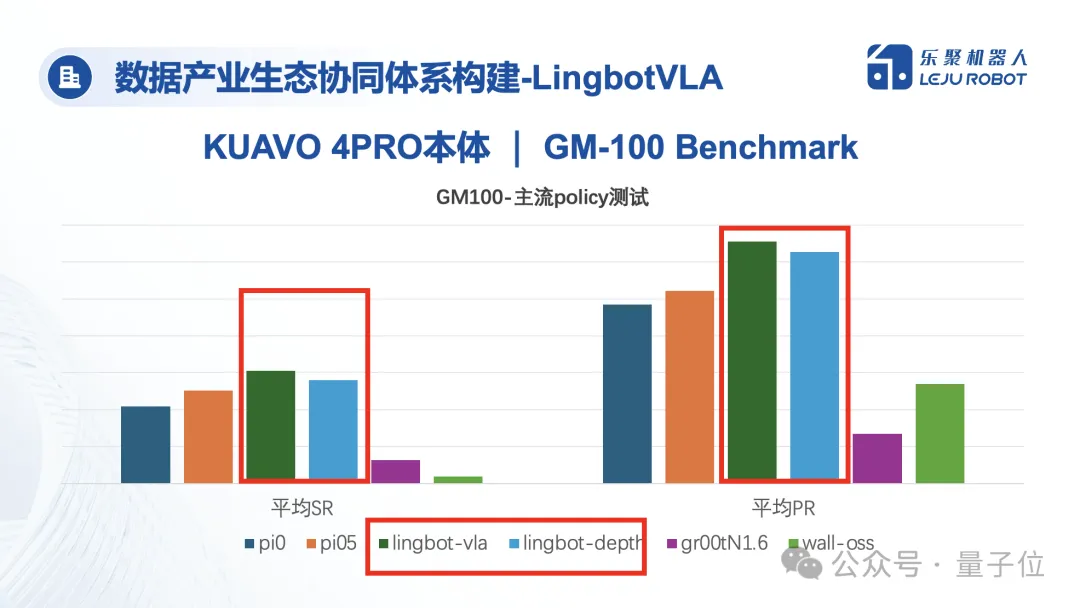

目前乐聚也与LingBot模型达成了合作,基于乐聚夸父4 Pro平台训练的数据,使LingBot-VLA与LingBot-Depth在多项基准测试中的成功率与过程得分均显著优于主流模型。

现在,乐聚机器人还和蚂蚁灵波与阿里云联合举办了两项具身智能操作挑战赛,总奖金达9万美元,欢迎感兴趣的伙伴一起参与!

由乐聚机器人、阿里云与蚂蚁灵波联合举办的第一届具身智能操作任务挑战赛,于2025年9月在阿里云天池平台正式启动,目前已进入真机赛阶段,预计2026年7月公布结果并颁奖。赛事任务为3个真实工业场景。

总奖金池达50万人民币。对于赛中有创业意向的团队,组委会还将提供专项资源支持。

另一项赛事为在ICRA 2026会议期间举办的REAL-I具身智能操作挑战赛,2026年1月启动,6月将有部分选手赴维也纳参加现场决赛。赛事同样设置3个工业任务:小件翻面、快递包裹称重与扫码分拣、日化产品上料整列。

两项赛事中,LingBot-VLA作为赛事官方推荐基线模型,组委会将为参赛者提供详细部署文档与专项奖励。使用LingBot-VLA获得一定名次的参赛队伍,可在常规奖励基础上额外获得LingBot-VLA专项奖。

蚂蚁灵波LingBot-VLA模型负责人郑可成介绍了今年1月发布的LingBot-VLA模型。

他指出,VLA(视觉-语言-动作)模型的主流范式存在根本性局限:需要在特定本体和特定任务上采集数据,再进行后训练并部署,本质上是轨迹拟合,泛化能力极为有限。

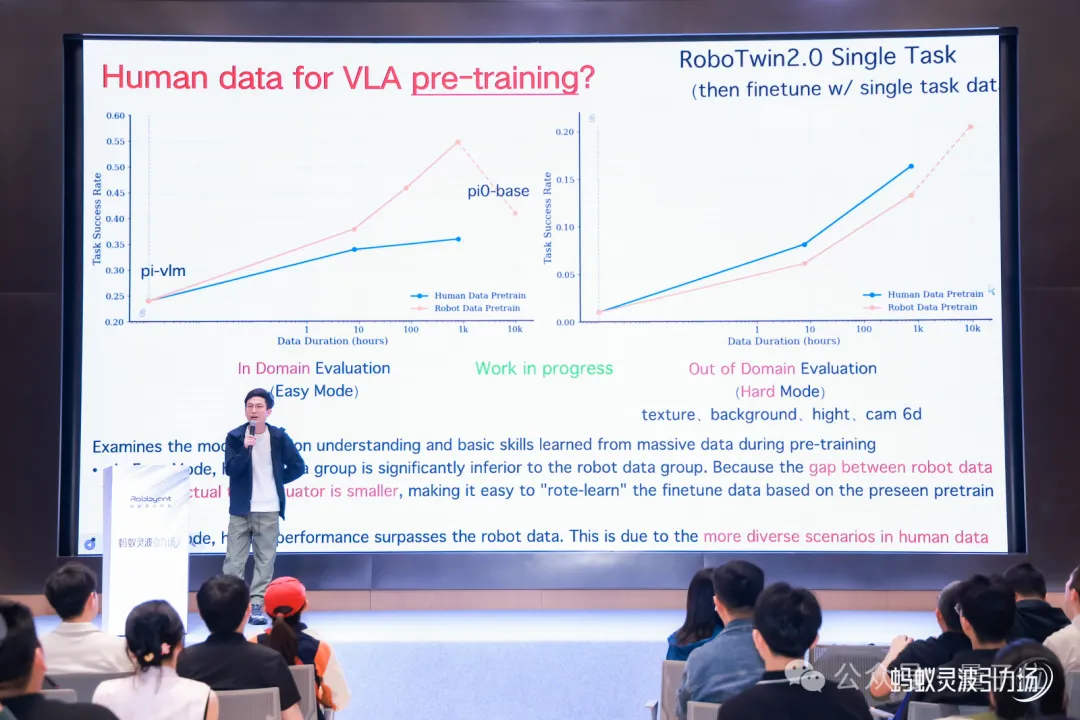

蚂蚁灵波希望借鉴大语言模型(LLM)和视觉语言模型(VLM)的预训练范式,让模型在预训练阶段学习通用知识,从而快速泛化到下游场景,降低具体任务的数据采集与训练成本。

郑可成强调,具身智能VLA模型的核心在于构建数据—架构—评测的完整闭环。

首先看数据,当前的具身智能操作数据分为3类:

- 互联网数据

- 海量规模,语义丰富,可以扩充模型多样性,但没有精确动作(action)

- 无本体数据

- 例如最近很火的UMI与Egocentric,量级是中等规模

- 真机数据

- 具有高精度,但效率较低

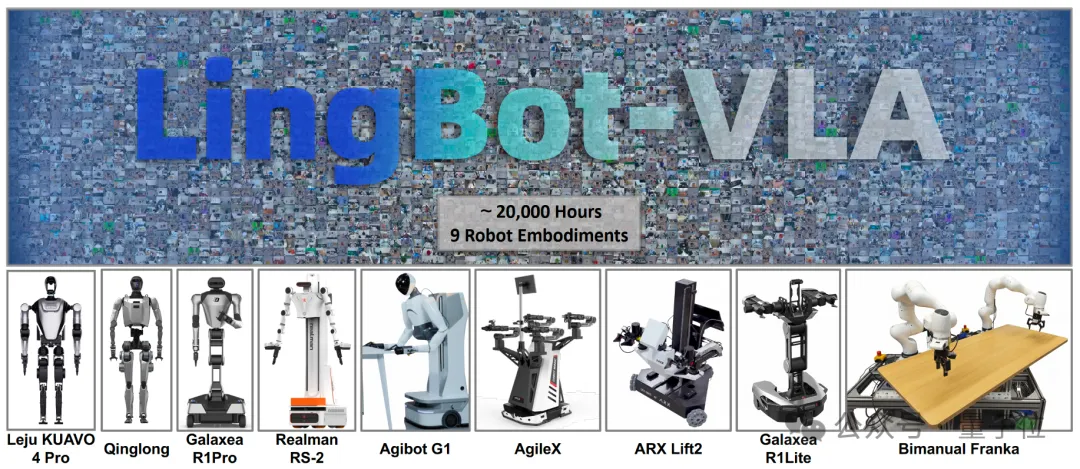

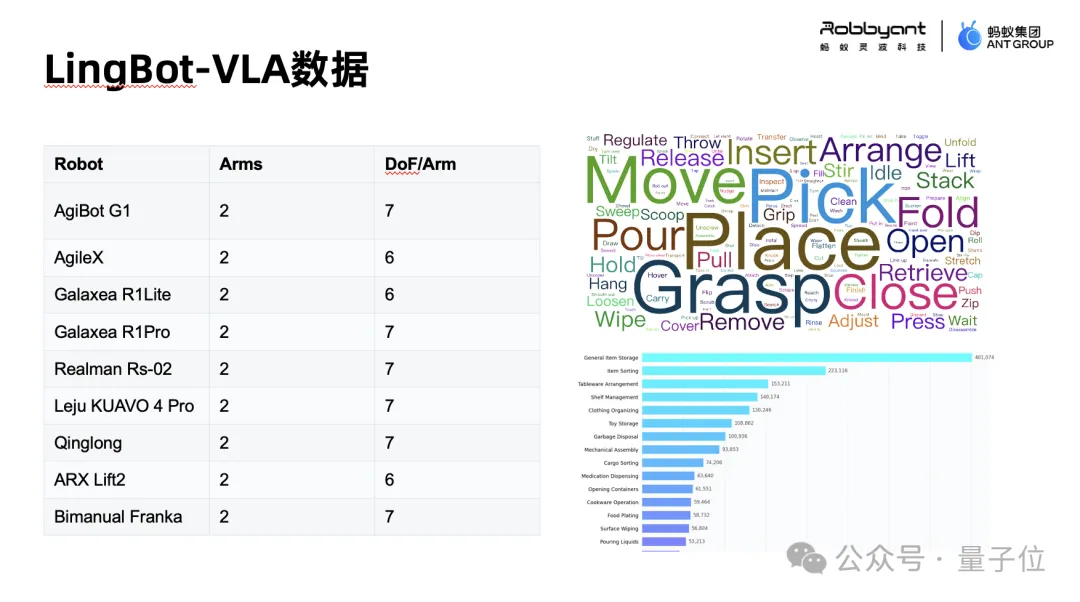

LingBot-VLA训练数据集包含2万小时真机数据,覆盖9种机器人本体构型。构型的纳入设有门槛,每种构型须达到一定的数据时长才能进入训练池,以确保多构型混训时各构型知识能够有效共享。

数据基础上,团队在标注上也下足了功夫。通过人工切片、标注原子动作等方式,促进不同构型的知识共享,进而缓解了真机数据不足的问题。

可以看到,当前数据主要集中于双臂桌面操作,以Pick、Place、Grasp等原子动作占主体,场景分布较长尾,构型集中在6-7自由度范围内。

在模型架构上,LingBot-VLA沿用Pi系列的MoT架构,并引入了LingBot-Depth深度模型。通过将Depth模型的深度知识蒸馏进VLM,解决透明、反光、密集物体的深度估计难题,让操作任务的空间精度进一步提升。

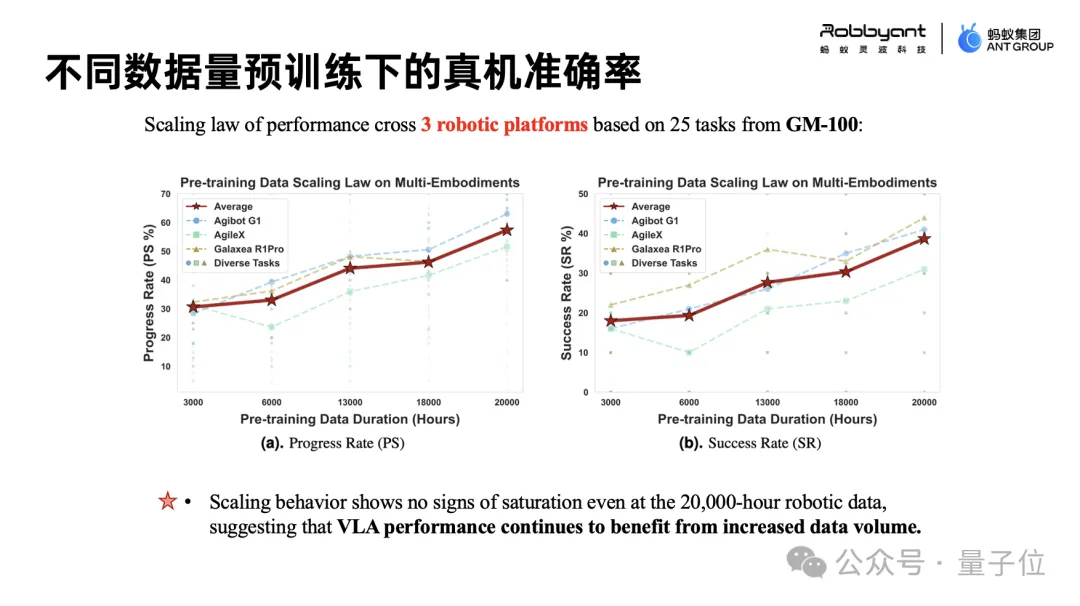

在Scaling实验中,团队从3000小时至2万小时做了分段对比,初步发现增加预训练数据量有助于加速后训练收敛。

郑可成坦言,受限于当前总数据规模,这一趋势尚不足以证明Scaling Law在具身领域成立,需要更大规模数据的持续积累。此外,多任务联合训练(multi-task fine-tuning)相比单任务训练有一定的性能提升,印证了任务间动作知识的可共享性。

上海交通大学副教授、上海创智学院全职导师李永露,从学术视角阐述了GM-100具身操作评测基准的设计理念与核心发现,并延伸至具身数据的根本性科学问题。

李永露首先抛出一个反问:机器人评测为什么需要统一标准?在他看来,AI是一个特殊领域,评测对象的复杂性本身就决定了稳定的Benchmark极难构建。

但这件事必须做,要把评测变成科学问题,而非工程问题。

他指出,在定义机器人任务时存在两种思路:一是研究者拍脑袋列举任务;二是从真实场景归纳,再用大模型过滤整合。

但无论哪种方式,都面临“莫拉维克悖论”:我们以为机器人擅长的事情反而很难;我们以为它难的事情,机器却很擅长。

李永露举例说明,刷锅与刷马桶的物理过程高度相似,混合训练时会互相提分;而折断一根筷子和折断一截金属棒,物理过程完全不同,但语言层面却是同一个词。

语言描述无法有效区分物理过程,这是当前具身数据标注体系的根本性缺陷。

△GM-100官网:

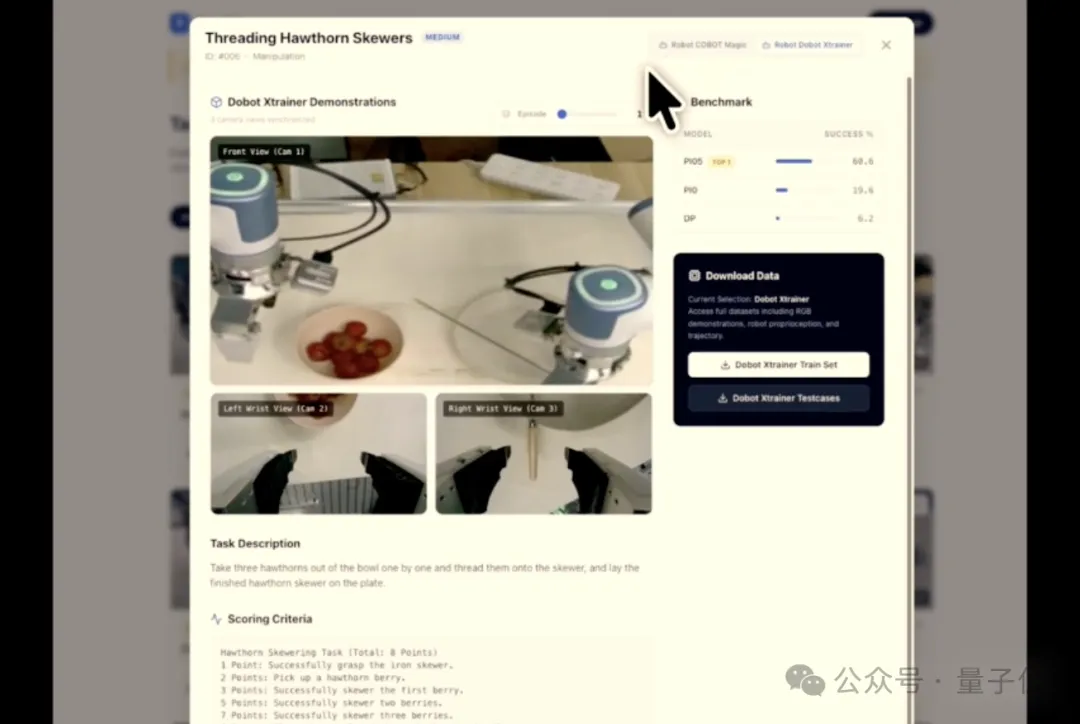

△GM-100官网:GM-100共设计100个评测任务,名称来源于“长征二万五千里”,100里刚刚开始,是小试牛刀。任务选取的核心原则是,覆盖当前主流预训练数据集中未充分涵盖的物理过程。

在任务设计上,GM-100特意纳入了一批直觉上不难,但实际对模型极具挑战性的任务,例如串糖葫芦、弹球入框、压制随机滚动的小球等。

评测结果印证了这一判断,Pi 0.5得分仅13分,LingBot-VLA + Depth得分17分,整体成功率普遍偏低。

李永露认为这恰恰是好基准应有的样子:“低分未必代表好,但起步就拿高分肯定不行。要是刚发布大家都能冲上80分,那这个基准就废了。”

GM-100采用开放平台模式,任务物料清单、GT演示视频、Leaderboard均公开,鼓励社区自行上传测评结果,以众包方式形成共识。数据集开源一个月内下载量突破5万次。

他认为对于数据的使用还需要新的架构和范式。对此还分享了一组关键数据:从约12万小时的Ego-centric人类行为数据中筛选后,真正可用于VLA预训练的数据不超过5000小时;而某机构公开的11万小时工厂视频数据,经过筛选,乐观估计可用比例约为3%。

具身数据的困境,不缺讨论,缺的是共识。在沙龙主持人金磊的主持下,北京人形机器人创新中心有限公司具身智能负责人车正平,蚂蚁灵波科技首席数据科学家黄用韬,北京智源人工智能研究院具身Infra&数据负责人姚国才,上海库帕思科技有限公司具身数据解决方案负责人曹宇四位嘉宾围绕数据挑战、破局路径与未来图景展开了一场坦诚的对话。

在数据挑战这一议题上,几位嘉宾给出了各自最深的感受。

北京人形车正平认为,大规模数据采集中,最难的问题是认知对齐,如何将算法团队对数据需求的理解,有效传达给一线数采人员。

他举例说,采集数据的多相机视角与数采员的自然视角存在显著差距,若不提前在流程中加以强化约束,采集到的数据将无法支撑机器人视角下的精细操作。

△车正平,北京人形机器人创新中心有限公司具身智能负责人

△车正平,北京人形机器人创新中心有限公司具身智能负责人蚂蚁灵波黄用韬从自动驾驶领域的从业背景切入,提出具身智能数据面临的三种无法对齐的问题:

首先是学习对象与数据不对齐,遥操作动作质量天花板太低,远不及人类日常真实能力;其次是任务分布与数据不对齐,采集的是抓拿放,用户要的是切菜洗碗;其三是本体间不对齐,不同机器人的零位误差和传感器标定差异无法统一。

智源研究院姚国才则指出,当前行业最大的阻力是“太着急”。大家都想要百万小时级数据去Scale up,但对于采什么数据、具身数据的目标是什么都还没想清楚。

现在具身数据领域还存在大量非共识,例如实现AGI需要多少数据、需要哪些模态、如何评价数据质量、什么样的数据才能有效表征人类行为模式等等。

困境如此,那如何破局呢?

△姚国才,北京智源人工智能研究院具身Infra&数据负责人

△姚国才,北京智源人工智能研究院具身Infra&数据负责人姚国才给出的回答是数据质量远比数量重要。

他用了一组简单计算说明数据利用率的问题。一个人每天与物理世界交互10小时、持续10年,累计才约3万小时,而一个10岁孩子用这些数据已经能完成海量复杂任务。

这说明当前具身模型对数据的利用率极低,如何从有限数据中充分提取价值,是比单纯扩量更根本的科学命题。

他对高质量数据的定义也有独特视角。姚国才认为,真正好的数据,应当能够自然地捕捉人类的真实行为模式。

以Ego-centric数据为例,许多数采厂商为了获得更多数据,人为设置任务让数采员反复采集,恰恰把这类数据最核心的价值“in the wild”的自然行为捕捉丢弃了。

除了回归真实这一点外,姚国才和团队也很关注数据如何能更好表征人类行为模式,因此也非常关注肌电、脑电这种与行为意图紧密关联的数据。

库帕思曹宇认为,现在具身数据通用性与复用性仍有很大提升空间。对于不同的场景,应该分层来考虑使用什么样的数据。

在核心工艺和技术壁垒上,应通过自研或定制真机数据,构筑起竞争护城河;在通用技能的模型冷启动阶段,应通过合作共享数据,快速打好模型的泛化基础;而针对复杂多变的长尾场景和边缘案例,则可以利用仿真合成数据来补齐短板。

他强调,这不是一道单选题,三者分工明确、缺一不可。问题的本质是,如何将不同来源的数据,统一组织成可复用的标准化链路。

△曹宇,上海库帕思科技有限公司具身数据解决方案负责人

△曹宇,上海库帕思科技有限公司具身数据解决方案负责人展望未来,曹宇预判行业将从各自封闭的全链路模式走向明确分工的协作生态。场景方开放核心场景,数据方沉淀可复用的采集、标注、训练、评测全链路能力,模型方基于统一Benchmark持续迭代算法。

在仿真与真机的关系上,车正平提出了VIP仿真标准:Visual(视觉)、Interactive(交互)、Physical(物理)。

他认为视觉层的仿真已有显著进步,但物理层与交互层仍是最大短板,尤其是物体被操作后的状态变化和力学反馈,在仿真中几乎无法被准确还原。

他还提出了一个量化标准,若一个策略在仿真中成功率达90%以上,零样本迁移至真机后应至少达到60%-70%,才算合格的仿真质量。他明确表示,仿真数据永远无法完全替代真机数据,但可以大幅压缩对真机数据的依赖。

展望未来3-5年,他预判具身数据的采集方式将向无感化演进。就像自动驾驶车辆的日常行驶数据可被自动回传一样,机器人部署后产生的真机数据也将逐步成为主要数据来源。

△黄用韬,蚂蚁灵波科技首席数据科学家

△黄用韬,蚂蚁灵波科技首席数据科学家黄用韬提到仿真数据与真机实采数据之间始终存在难以弥合的物理gap,尤其在末端执行器与物体的接触交互上,直接影响模型的学习信号质量。

基于此,蚂蚁灵波坚持以真机数据为预训练核心,目的是在排除干扰变量的前提下,探索清楚VLA范式的真实上限。

黄用韬指出,当前真机部署规模仅是全市场几千台,与国内几百万台的工业机器人总量之间存在数量级的鸿沟,弥合这一差距需要机器人自身产生的数据承担更大比重。

随着部署规模扩大,数据飞轮将真正转动起来。

回看整场讨论,一个清晰的信号是:具身智能的数据困境根植于“数量崇拜”与“质量缺失”之间的巨大张力。当行业不再执迷于堆砌海量低质数据,转而聚焦如何用更聪明的方式提取有限数据中的通用知识,真正的转折点或许才会到来。而GM-100基准为这种转向提供了一面镜子——它提醒所有从业者,在冲向“百万小时”之前,先问清楚:我们到底需要什么样的数据?