十年前,计算机视觉还在为让机器“看清世界”而奋力奔跑——从ImageNet分类到今天的扩散模型,感知精度一路逼近人类极限。然而,当准确率爬坡的边际成本越来越高,整个领域开始追问一个更本质的问题:看懂了,然后呢?在CVPR 2026的学术舞台上,一个明显的风向已经确立:视觉不再只是感知的终点,而是推理、决策与交互的中继站。这场从“看”到“想”再到“做”的进化,正在悄然重塑技术栈的每一个层级。

告别“盲目推理”:按需激活与隐式路径

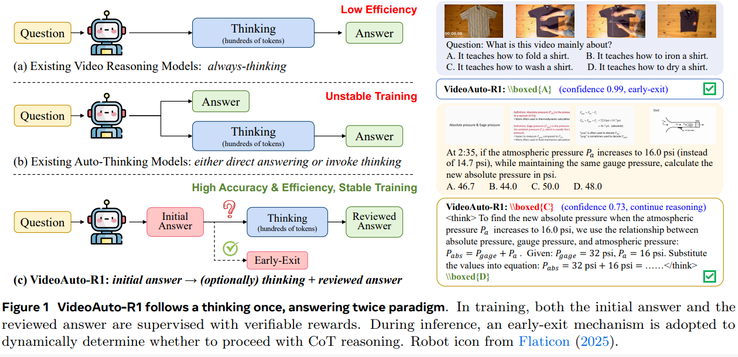

长期以来,多模态模型默认把任何任务都塞进“思维链”(CoT)的管道里,仿佛每一步都非得自言自语一番才算合理。但最新研究表明,这种“凡事必推理”的做法往往效率低下,甚至冗余。以VideoAuto-R1框架为例,它引入了“按需推理”机制:面对简单的感知问题直接回答,只有在逻辑复杂的场景下才触发推理链。实验数据显示,这一策略在保持最优性能的同时,将平均输出长度压缩了3.3倍——相当于让模型学会“该动脑子时才动脑子”。

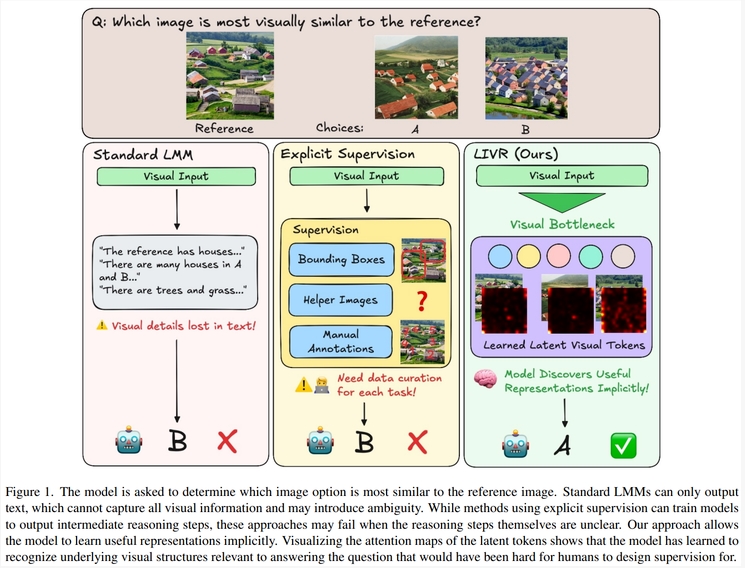

不仅如此,推理的媒介也在发生质变。过去模型高度依赖语言描述来处理空间关系,但面对拼图、几何结构这类任务,文本线性化的能力捉襟见肘。新的趋势是让模型直接在“潜空间”内进行隐式视觉推理——让视觉问题在视觉的维度内解决,而非强行翻译成文字链条。这种做法更自然地捕获了复杂视觉结构中的拓扑与层级关系,也为更高效的跨模态对齐打开了新思路。

评估体系大洗牌:戳破选择题的“幸存者偏差”

当前大多数视觉-语言模型评估仍依赖多项选择题(MCQA)。但一系列深入分析指出,这种范式可能系统性地高估了模型能力——模型往往通过排除法或选项偏好“作弊”,实际得分存在约20分的“虚高”。换句话说,很多模型不是真的“看懂”了,而是学会了在固定选项间玩概率游戏。为了拨开这层迷雾,业界正在推动“可验证开放问答”评估范式,强迫模型真正理解视觉内容,而非依赖选项线索蒙混过关。

与此同时,评估场景正在从“单机静态图”向“多智能体动态环境”迁移。新涌现的VS-Bench等基准要求模型不仅要理解环境,还需具备在协作、竞争等复杂交互中的战略推理与决策能力。这意味着视觉智能的度量标尺,已经从“它能认出什么”升级为“它能决定做什么”。一个只会看、不会想、更不会动的模型,在新的评估体系下很难及格。

基础设施升级:开源模型透明化,真实数据集补短板

在模型形态方面,开源社区正在经历一场透明度革命。以Molmo2为代表的模型不仅公开权重,还将训练数据、训练流程全盘托出——这对于推动可复现研究和社区共建意义重大。Molmo2系列的能力也从单图扩展到了视频,并引入精确定位功能,实现了从“理解画面”到“指出位置”的跨越。这种从感知到定位的跃迁,正是视觉智能走向具身交互的关键一步。

支撑这一切进步的,是越来越完善的数据基础设施。以文图编辑任务为例,过去大量依赖合成数据,导致模型缺乏真实世界中的常识与逻辑。大规模真实场景数据集Pico-Banana-400K的发布填补了这一空白:它支持多轮编辑和偏好对齐,为训练出更“懂事”的编辑模型提供了扎实的土壤。可以说,数据供应链的成熟度,正在直接决定上层模型的天花板。

综合来看,视觉智能正从单一的“感知器官”进化为集感知、认知、行动于一体的综合智能体。这一过程绝非简单的性能爬坡,而是对推理机制、评估范式和数据供应体系的系统性重构。当机器既能看懂世界,又能根据所见自主决策、主动交互,AI的下一个十年或许会比我们想象中来得更快。