Rain科技4月26日消息,国产大模型DeepSeek官方宣布,全系API输入缓存命中价格下调至首发价的1/10,叠加限时优惠后,V4-Pro缓存输入低至0.025元/百万Tokens,创全球大模型价格新低。

本次调价覆盖DeepSeek-V4-Pro、V4-Flash全系列,核心降幅集中在输入缓存命中场景。

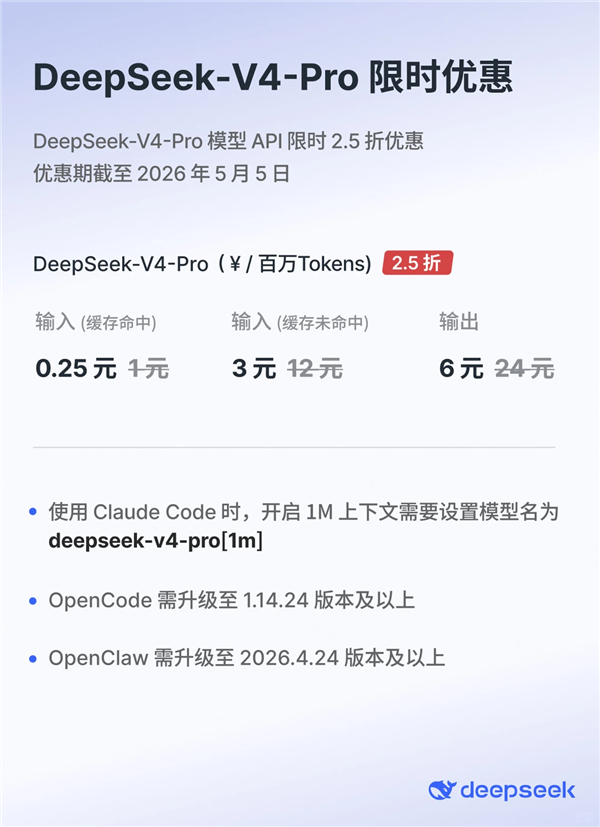

DeepSeek-V4-Pro:从1元降至0.1元/百万Tokens,5月5日前叠加2.5折,实付0.025元。

DeepSeek-V4-Flash:从0.2元降至0.02元/百万Tokens,无额外折扣。

缓存未命中与输出价格同步下调:V4-Pro输入(未命中)3元、输出6元;V4-Flash输入(未命中)1元、输出2元,均为原价1/4。

此次降价直击行业痛点,缓存输入价仅为GPT-5.5 Pro的1/700,大幅降低企业长文本、高频调用场景成本。

对RAG知识库、智能客服、文档分析等缓存命中率高的应用,成本可降90%以上。

技术端,DeepSeek-V4采用自研稀疏注意力架构,支持160k超长上下文,长文本处理效率领先。目前已适配华为云、阿里云等8大云平台及多家智算中心。

从行业视角来看,此次降价兼具战略与技术双重意义。一方面,缓存命中场景的定价逻辑直接对标企业实际使用习惯——长文本对话、多轮交互和知识库检索等高频重复查询,缓存命中率往往超过60%,按此计算实际成本甚至低于0.02元/百万Tokens,远低于行业平均的0.2~0.5元水平。另一方面,稀疏注意力架构的引入使得模型在保持160k上下文的条件下,计算复杂度从O(n²)降至接近O(n),这为极端低价提供了硬件效率支撑。相比OpenAI GPT-5.5 Pro缓存输入约17.5元/百万Tokens的价格,DeepSeek的定价优势接近700倍,直接冲击了海外厂商的定价体系。

业内认为,DeepSeek此举将重塑行业定价体系,加速AI应用普惠化,倒逼海外模型降价,巩固国产大模型成本优势。