这几年,随着生成式AI、物理AI、智能体AI的持续火爆,GPU的地位被空前提高,甚至有声音号称CPU的时代已经结束了,GPU才是真正的顶梁柱。然而,从技术底层逻辑来看,这种论调过于片面。GPU擅长并行计算,适合大规模矩阵运算,但AI工作流远不止训练阶段——数据预处理、逻辑控制、任务调度、智能体自主决策等环节高度依赖CPU的串行处理能力和低延迟特性。因此,GPU的爆发并未让CPU边缘化,反而因为AI应用的全栈化,让CPU的角色变得更加不可或缺。

随着技术的演进与形势的变化,人们渐渐发现,CPU依然是真正意义上的“中央处理器”,AI时代下的地位不但没有削弱甚至被替代,反而得到了进一步的加强。这并非怀旧式的断言,而是从实际算力需求结构变化中得出的客观结论。例如,在智能体AI场景中,AI代理需要频繁调用工具、解析上下文、执行条件分支,这些任务天然适合CPU架构,而GPU在大规模并行推理之外反而显得笨重。

通俗地讲:你大爷还是你大爷!

这一点,在AMD刚刚发布的财报中就得到了直接的体现。数据不仅反映了AMD自身的业绩爆发,更揭示了行业风向的深层转变——云厂商开始重新评估CPU在AI基础设施中的战略价值,从过去“只堆GPU”转向“CPU+GPU协同优化”。

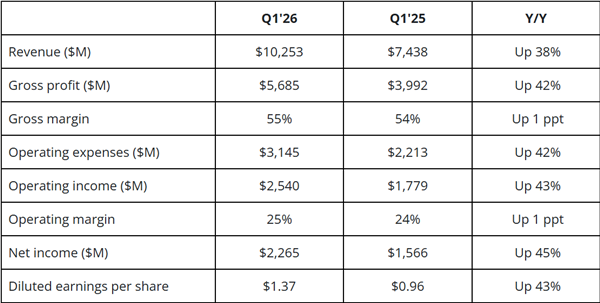

2026年第一季度,AMD取得收入102.53亿美元,同比大涨38%,经营收入14.76亿美元,同比高涨83%,净利润13.83亿美元,同比飙升95%,几乎翻倍,带动股价当天猛涨超过16%。这样的增幅在半导体行业普遍放缓的背景下尤为突出,表明市场对AMD产品组合的认可已从单一爆款升级为系统性胜利。

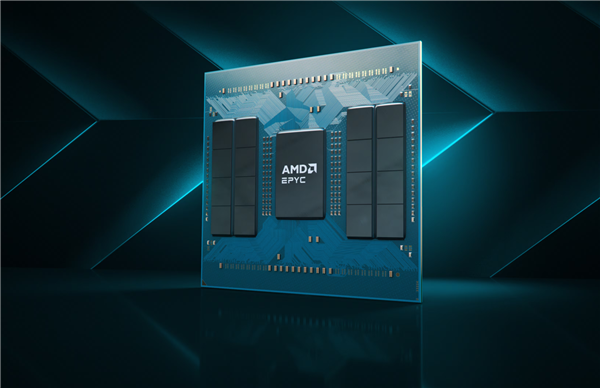

其中,AMD数据中心事业部当季收入58亿美元,不但占总收入的一半以上,成为当之无愧的核心增长引擎,同比增幅更是多达57%,这主要得益于市场对AMD EPYC数据中心处理器的强劲需求,以及AMD Instinct数据中心GPU加速器出货量的持续增长。值得注意的是,这一数据背后是客户对“高集成度、低总体拥有成本”方案的偏好——EPYC处理器凭借更高的核心密度和更低的功耗,在大型云厂商的机架部署中优势明显。

特别值得关注的是,Intel当季数据中心业务收入51亿美元,虽然也有22%的增幅,但远不及AMD,而且历史上第一次被AMD正式超越,成为历史性的转折。这一超越并非偶然。过去几年,AMD凭借Zen架构的持续迭代和Chiplet封装技术,在数据中心市场步步紧逼;而Intel在制程和架构上的迟滞,导致其产品竞争力相对减弱。从市场份额角度看,AMD在数据中心CPU领域的份额已从五年前的不足10%飙升至接近30%,并且还在加速攀升。

更令人惊叹的是利润:AMD数据中心业务营业利润飙升至11.6亿美元,Intel同期则只有2亿美元。利润差距远超收入差距,说明AMD不仅以量取胜,更以溢价能力取胜。客户愿意为AMD产品支付更高价格,因为其带来的性能提升和能效优化能够直接降低长期运营成本。

这意味着,AMD不仅卖得比Intel多,而且赚得比Intel更有效率,客户愿意为更贵但更有价值的AMD产品买单。从财务角度分析,AMD数据中心业务的营业利润率已达到20%,而Intel仅约4%,这反映出两家公司在产品定义、供应链管理和客户信任上的巨大分化。

另外,AMD客户端和游戏事业部当季收入36亿美元,同比增长23%,主要得益于市场对AMD 锐龙消费级处理器的强劲需求,市场份额也在持续提升。在PC市场整体疲软的当下,AMD凭借锐龙在高端游戏和内容创作领域的口碑,成功实现了逆势增长,进一步巩固了其“全能芯片商”的形象。

这样的表现,在半导体行业整体放缓的大背景下,显得格外亮眼,也进一步彰显了AMD产品的强劲竞争力,和市场需求的悄然变化。可以说,AMD已经从一个“挑战者”蜕变为“规则改写者”,而这一切的核心驱动力正是CPU在AI时代的重新估值。

在财报发布后的财务会议上,AMD特别指出,CPU处理器的价值正在被重新发现,未来每年的复合增长率将达到35%,预计到2030年市场总规模就高达1200亿美元,比之前的预测翻了整整一倍,而其中的核心推动力就是智能体AI的爆发。这一预测并非空谈——随着AI代理从实验阶段走向生产部署,每个代理都需要独立的CPU核心来执行推理、工具调用和上下文管理,这种“每代理一CPU”的模型将极大拉动需求。

AMD 董事会主席及首席执行官苏姿丰博士也提到,以往在AI数据中心内,CPU与GPU的配比经常是1:8、1:4,未来CPU的比重会不断提高,甚至转向1:1,未来甚至可能出现CPU数量超过GPU的情况。这种配比变化意味着,数据中心的总机架数不变的前提下,CPU的采购量将成倍增长,对AMD这种同时拥有强大CPU和GPU产品线的公司来说,是绝佳的整合机会。

其实在去年的AMD分析师日活动上,AMD就提出,CPU市场份额的目标是要超过50%,而今随着CPU在AI时代的重要性越发凸显,市场规模越发庞大,AMD自然对这一目标更有信心,相信很快就能实现,从而登上老大的宝座!从竞争格局看,若AMD能保持当前的产品迭代节奏,并在下一代Venice处理器(2nm工艺、256核心)上实现技术领先,超越50%份额只是时间问题。

相关资料显示,AMD把如今的CPU分成了三类:一是传统的通用计算CPU,市场规模很大,只是增速会比较低,但一般也有两位数。这部分是基本盘,为AMD提供稳定的收入来源。二是AI节点CPU,通常与GPU加速器等连接,增速也在提升,但总体规模比较小。这类CPU主要负责数据预处理和任务调度,是GPU集群的“大脑”。三是智能体Agent CPU,这不但是CPU价值被重新发现的核心领域,更是最大的增长源,是真正的未来主角。智能体CPU需要高单线程性能、低延迟和丰富的指令集,这正是AMD Zen架构的优势所在。

为了满足上述不同的需求,必须提供广泛的CPU产品线,而这恰恰就是AMD的强项,在三个方面都可以恰到好处地针对不同负载进行相应的优化,灵活满足市场。AMD通过统一的Zen架构和灵活的Chiplet设计,能够从低功耗嵌入式到高性能服务器实现全线覆盖,而竞争对手Intel在架构统一性上稍显逊色。

AMD财报中就特意披露,Meta已经确定将成为代号Venice、Verano的第六代AMD EPYC的主要客户之一。Meta作为全球最大的社交平台之一,其AI基础设施需求极为庞大,选择AMD表明其已对AMD的CPU路线图持有高度信心。

随着“养龙虾”即OpenClaw热度的爆发,这种可以替用户执行任务的半自主甚至全自主AI智能体,正在快速进化、普及。这一趋势直接推动了CPU需求的结构性增长,因为智能体需要实时响应、频繁调用外部工具,这些操作无法通过GPU高效完成。

在这种形势下,CPU在消费级和数据中心市场的重要性都在持续攀升,因为AI智能体代理执行任务时,非常依赖基于CPU运行的工具与软件,CPU的快速响应能力、超低延迟特性可以说天然就非常适合跑AI智能体,从而大幅推高了CPU的市场需求。从技术角度看,CPU的上下文切换速度比GPU快几个数量级,这决定了在交互式AI应用中CPU无可替代。

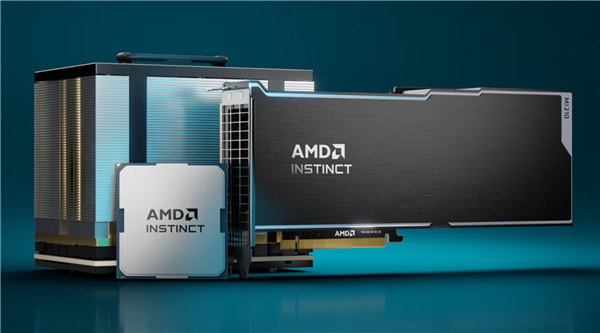

当然,AMD拥有的不只是强悍的CPU,面向AI训练与推理的Instinct GPU加速器产品线同样卓有成效,不断拿下大单。这种CPU+GPU的双轮驱动格局,使AMD成为少数能够提供完整AI基础设施解决方案的供应商。

究其原因,主要是在AI算力需求爆发的当下,云计算厂商并不愿意把鸡蛋放在一个篮子里,过度依赖NVIDIA,急于寻求合理的替代方案,尤其是希望能有更具性价比的算力方案。NVIDIA的CUDA生态虽强大,但封闭且昂贵;AMD的ROCm生态正在快速追赶,同时其GPU在性价比和开放标准上具有吸引力。这种竞争态势让云厂商有了议价空间,也推动了整个AI算力市场的健康发展。

微软Azure、亚马逊AWS、谷歌Cloud、Meta等巨头莫不如此,都十分青睐AMD Instinct,比如财报中就披露,Meta计划部署高达6GW的AMD GPU。这一规模相当于几个大型核电站的输出功率,足见Meta对AMD GPU的依赖程度。

除此之外,早在去年,OpenAI就已经与AMD达成了一项多年的战略合作协议,将采购总规模同样高达6GW的AMD GPU算力。OpenAI作为AI领域的标杆企业,选择AMD意味着其技术路线已获得行业顶级玩家的认可。

多年来,AMD在消费级领域是唯一能同时做好CPU处理器+GPU显卡的,AI时代在数据中心同样唯一同时握有CPU、GPU两大强劲产品线,再加上FPGA产品线更是构建了全栈能力。这种全栈整合优势在系统级优化中至关重要——例如,AMD能够通过Infinity Fabric总线实现CPU与GPU之间的高速直连,减少数据搬运延迟。

对AI基础设施而言,这个能力非常重要,因为客户采购的从来不只是一颗CPU或者一颗GPU,而是完整的平台、系统、机架级方案和服务。AMD近期推出的“Helios”机架级系统,正是这种整合能力的最佳体现。

苏姿丰在此前的分析师沟通中也曾强调,AI基础设施的建设“不仅仅关乎GPU”,因为AI智能体工作负载催生的整体计算需求,正在同时拉动GPU、CPU、网络和存储的需求,而AMD恰好在GPU和CPU两个赛道上都拥有具备竞争力的产品组合。这种双线作战的底气,源于AMD在架构设计上的前瞻性——从Zen架构到CDNA架构,每一代产品都注重能效比和可扩展性。

AMD还即将推出首款机架级系统“Helios”,充分整合自家下一代EPYC CPU与下一代Instinct GPU,以及配套的DPU、NIC模块,打造大型服务器机架,释放平台化优势,对标NVIDIA基于下一代Vera Rubin芯片的NVL72机架系统。 Helios系统的推出,意味着AMD不再满足于只做芯片供应商,而是向“系统集成商”转型,这将进一步加深客户粘性。

AMD将在7月份召开新一届AI大会,届时肯定会披露Helios系统的更多震撼细节,以及令人期待的未来路线图。业界普遍预期,Helios将展示AMD在液冷、互联和软件栈上的最新突破。

随着智能体AI重塑算力需求,CPU行业正迎来强势复苏,AMD也站在了新的风口上。从行业周期性看,CPU市场的复苏并非昙花一现,而是由AI应用场景的深度渗透驱动,至少将持续五到十年。

如今资本市场对于AI高度追捧,同时也越来越清醒地认识到了AMD的高价值,尤其是AMD CPU的高价值。这从AMD股价的持续攀升中可见一斑:过去一年涨幅超过两倍,2026年至今涨幅已近66%,投资者正大举涌入。

比如彭博社指出,放眼全局,AMD在AI风口到来前势头正盛,布局开始落地见效,如今已是实打实地兑现实力,尤其是机构目标股价直接翻倍,正从AI领域的顶级大客户手中拿下大量订单。彭博的分析还提到,AMD的估值仍远低于NVIDIA,考虑到其CPU业务的稳定性和GPU业务的增长潜力,存在明显的价值洼地。

路透社分析师认为,AMD最有希望从CPU的需求暴涨中获益,凭借的就是产品路线布局和市场份额增长。路透社特别指出,AMD在数据中心CPU领域的份额每年以3~5个百分点的速度提升,这种“蚕食效应”一旦形成惯性,将很难被逆转。

最近几年,AMD的股价一路狂飙,尤其是过去一年涨幅超过两倍,2026年至今涨幅已近66%,投资者正在大举涌入AMD股票。这种市场情绪的背后,是对AMD“双引擎”战略的长期看好。

亮眼数据的背后,是产品与技术路线的持续进化。AMD在数据中心领域发展的思路尤为清晰,尤其在产品路线图上所呈现出的“已确定性升级”。这得益于AMD的Chiplet架构和先进封装技术,使其能够在不牺牲良率的前提下快速迭代核心数量。

作为路线图上的核心亮点,未来AMD Turin和Venice系列处理器将成为AMD驱动AI算力持续升级的核心引擎,其中Venice采用2nm,核心数可达256核,高于Turin的192核。这种核心数量的跃升,将直接提升AI智能体场景下的并发处理能力,也是AMD敢于预测CPU市场规模翻倍的技术底气。

AMD EPYC CPU诞生短短不到9年时间,就实现了一路逆袭,在服务器和数据中心市场打破垄断,不断攻城略地,尤其是趁着AI的东风,更是扶云直上,始终作为计算的中流砥柱,终于一举加冕新王,并且与Instinct GPU强强联手,给AI行业带来了优秀的新选择。回顾AMD芯片的演进史:从2017年第一代EPYC(Zen架构)的8核心,到2026年第六代EPYC(Venice)的256核心,核心数翻了32倍,性能提升超过40倍,这种迭代速度在整个半导体历史上都极为罕见。

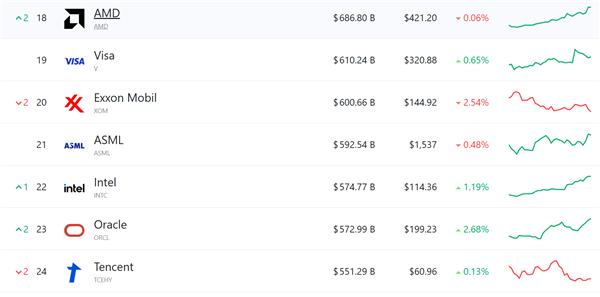

如今,AMD的市值已经超过6800亿美元,在全球攀升至第18位,而且相信这只是新的开始。随着AI智能体应用渗透到各行各业,CPU作为“智能体大脑”的地位将进一步巩固,而AMD凭借在CPU和GPU领域的双重优势,完全有能力在未来几年冲击万亿美元市值俱乐部。